Закрыть сайт от индексации ᐈ Способы запретить индексацию

Содержание:

Индексация и способы закрыть информацию сайта

Индексация. Закрыть домен (или поддомен)

Индексация. Закрыть информацию по частям

Индексация. Закрыть отдельные страницы ресурса

Индексация и использование URL

Индексация и сомнительные способы закрытия контента

Индексация. Итоги

Индексация очень полезная вещь, однако бывают случаи, когда владельцам сайтов или вебмастерам нужно закрыть часть информации от индексации поисковых систем. Или же запретить обращение к ней. Часть из таких ситуаций можно перечислить:

- Необходимость закрыть техническую информацию.

- Запрещение индексации неуникальной информации.

- Закрыть страницы, которые для поискового робота выглядят как дубль другой страницы. При этом такие адреса могут быть полезны рядовому пользователю.

- Часто сайт может использовать на разных страницах повторяющуюся информацию. Для лучшей оптимизации сайта ее нужно закрыть от постороннего взгляда.

Есть несколько способов закрыть сайт от взгляда поисковика.

Используем robots.txt

В этом файле нужно прописать такие ряды:

User-agent: *

Disallow: /

От этого закрывается отображение домена для абсолютно всех поисковиков. Но если есть желание исключить лишь одну систему, следует указать ее название. Пример:

User-agent: Yahoo

Disallow: /

Также существует возможность запретить доступ всем поисковикам, кроме одного. Тогда оставляем строки без изменений, как в первом примере и ниже добавляем еще два ряда:

User-agent: Yahoo

Allow: /

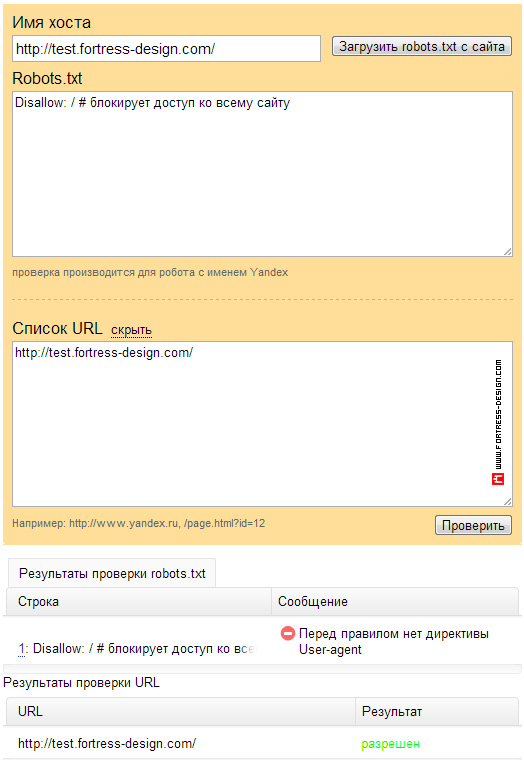

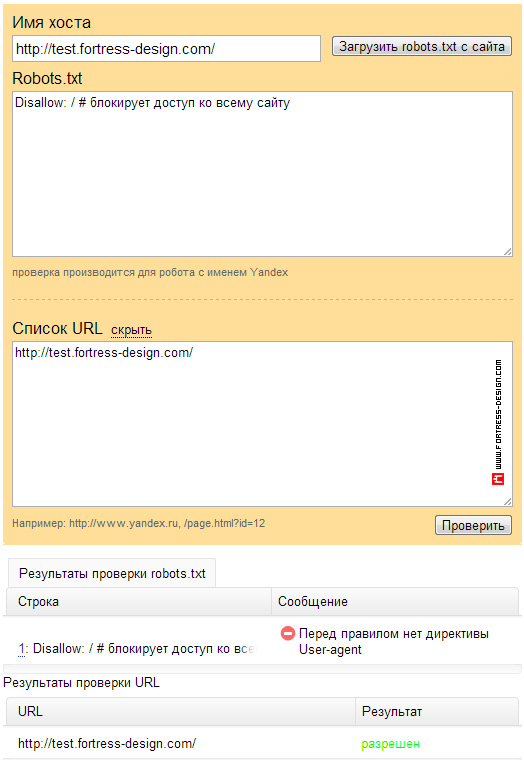

Минусом такого способа является не стопроцентная гарантия отсутствия индексации. Это маловероятно, но все же возможно. Для правильной корректировки роботс.txt используем онлайн-инструмент от Yandex. Держите ссылку http://webmaster.yandex.ru/robots.xml. Загружаем свой файл и сканируем его.

Использование мета-тега

Это очень легкий, но довольно затратный по времени метод. Особенно, если на вашем сайте существует большое количество страниц. Для его реализации необходимо в head нужных адресов указать ряды:

META NAME=»ROBOTS» CONTENT=»NOINDEX, NOFOLLOW»

Такой способ абсолютно защищает ваш сайт от взгляда поисковиков. Его плюсом является отсутствия необходимости лезть роботс.

Индексация. Изменение атрибутов файла .htaccess

Этот способ позволяет закрыть доступ к ресурсу за паролем. В htaccess указываем ряды:

Такой способ также полностью закрывает доступ поисковикам к контенту сайта. Однако из-за наличия пароля сайт становится очень тяжело просканировать на наличие ошибок. Поскольку не все сервисы имеют возможность вводить пароль.

Есть множество вещей, доступ к которым следует закрыть (код, отдельный текст, ссылку на другие сайты, элементы меню), не закрывая при этом сам адрес. Сейчас очень популярный ранее метод с помощью noindex уже не используется. Его суть состояла в том, что в отдельный тег существовала возможность скопировать всю информацию, которую нужно было закрыть. Теперь мегапопулярным стал другой способ.

Использование JavaScript

В этом способе снова нужно использовать файл роботс. Его суть предполагает, что вся нужная информация кодируется с помощью яваскрипт, а после копируется в роботс и скрывается от индексации с помощью нужных тегов. Этот метод уменьшает «вес» ресурса, при его использовании быстродействие сайта увеличивается. Поэтому возможно улучшение ранжирования. Но есть один существенный минус. Google не одобряет данный способ и регулярно отсылает владельцам сайтов письма с просьбой открыть для индексации сокрытую информацию. По его заверениям информация должна быть идентичной и для пользователя, и для поискового робота.

Но несмотря на все усилия корпорации, этот способ остается достаточно популярным из-за эффективности.

Есть два способа, которые используются, чтобы закрыть ссылку на страницу от индексации.

Robots.txt

Для реализации первого способа добавляем в файл robots.txt такие строки:

User-agent: ag

Disallow: http://example.com/main

Это простой способ, но он не отличается надежностью. Страницы могут продолжать индексироваться. Но чтобы запретить их отображение, можно использовать еще один способ:

Мета-тег noindex

Второй способ является лучшим вариантом, поскольку в нем исключается воздействие роботс. Для его реализации в head всеx адресов, которые нужно закрыть от взгляда поисковых систем, вставляем тег:

META NAME=»ROBOTS» CONTENT=»NOINDEX, NOFOLLOW»

Такой способ намного эффективнее использовать большим ресурсам, которым нужно закрывать больше сотни страниц. Однако, тогда у них отсутствует общий параметр.

Robots.txt

И снова вмешательство в этот файл поможет нам избежать индексации страниц. Добавляя в тег Disallow названия разделов и папок, мы можем исключать их из индексации. Примеры:

Disallow: /название папки/

Disallow: /название раздела/

Такой способ удобный, быстрый и простой в применении. Но он также полностью не гарантирует отсутствие индексирования нужных страниц. Поэтому мы рекомендуем использование мета-тега noidex в способе, описанном выше.

Редактирование файла robots.txt однозначно остается самым легким способом закрытия контента от индексации. Но в любом случае он больше нагружает файл, что скажется на быстродействии ресурса и его ранжировании. Тем более, чаще всего эти способы не гарантируют стопроцентную эффективность.

Есть возможность закрыть доступ для поисковых систем на уровне сервера.

Добавляем в бан отдельных User Agents

Такой способ позволяет заблокировать пользователя или робота, указав его нежелательным или опасным. Это позволяет запретить доступ к контенту своим конкурентам.

Способ используется для того, чтобы закрыть информацию от роботов онлайн-сервисов, которые анализируют источники трафика сайта, а также сео-оптимизации.

Это очень опасный метод, который часто приводит к нежелательным последствиям. Поэтому если вы не уверены в своих силах, следует обратиться к профессионалу.

Изменение HTTP-заголовка

Существует возможность прописать тег X-Robots как заголовок отдельной страницы. Такие методы идентичны тем, которые мы использовали при редактировании файла robots.txt. Нужно только указать имя пользователя (название поисковой системы).

Конкуренция в интернете с каждым днем вырастает все выше и напоминает промышленное шпионство больших корпораций. Поэтому владельцы сайтов и вебмастера вынуждены использовать любые способы, чтобы закрыть от посторонних глаз свою стратегию продвижения и способы сео-оптимизации.

Однако подобные методы используются и в банальных целях. Например, чтобы закрыть от индексации «мусор» на страницах ресурса. Как видим, индексация имеет две стороны.

Перечисленные выше методы не панацея, поэтому при недостаточных знаниях лучше обращаться к профессионалу.

infounion.com.ua

Как закрыть сайт от индексации в Яндексе и Google

Мэт Катс, будучи в свое время официальным представителем Гугл для вебмастеров, в одном из своих видео, рассказал, как закрыть сайт от индексации, способ предельно простой – нужно просто не ставить ссылки на свой сайт. Про этот, а также про другие способы закрытия сайта от индексации, читайте дальше.

Хотя, на самом деле, не ставить ссылки на свой сайт, это тоже вариант, но и сам Мэт Катс, в своем видео признает – такой способ действительно возможен — теоретически, но фактически, это не вариант. Любой посетитель, зайдя на ваш сайт, может затем оставить эту ссылку где угодно. И все, как только поисковик пройдет по ссылке, ваш сайт окажется проиндексирован поисковиком.

Но на самом деле, есть и другие способы закрытия своего сайта. Одни из них, менее эффективные, другие дают сто процентную гарантию запрета. Давайте пройдемся по этим способам.

Я предполагаю, что вы уже знаете, что такое индексация сайта и почему она важна. Окей, пару слов об этом. Поисковики, что Яндекс, что Гугл, да и другие тоже, постоянно рыскают по всему интернету, в поисках новой информации, и заносят всю важную информацию в свои базы. Если сайт проиндексирован, то он будет доступен в поиске.

Зачем нужно запрещать индексацию сайтов.

Есть несколько причин. Но главная, а по сути, единственно важная, это необходимость закрыть индексацию для новых сайтов, или же, для сайтов, которые проводят глобальную реорганизацию.

На молодых сайтах, еще слишком мало информации, и попадание в индекс поисковых систем, не принесет особых плюсов. Зато минусы принести может. На сайте могут быть множество ошибок, а значит, сайт получит пессимизацию. Или просто мало контента. Что в свою очередь, также не будет способствовать любви поисковых систем.

То же самое, касается и сайтов при реорганизации. В этот момент, на сайте идут масштабные работы, и поисковикам сами эти работы, лучше не видеть. Лучше впустить их затем на готовый сайт.

Бывает, что запрет индексации ставят и для того, чтобы чужие не зашли на сайт, и не смогли прочитать то, что на этом сайте. Но в этом случае, запрет индексации сайта, это не панацея, поскольку, с одной стороны, не дает сто процентной гарантии, с другой стороны, на сайт могут зайти и по ссылкам с других сайтов. О том, как сделать закрытые разделы на сайте, я поговорю в другой раз.

Способы закрытия сайта от индексации.

Есть четыре основных способа запрета сайта от индексации.

- Запрет индексации при помощи файла robots.txt

- Закрытие средствами WordPress (для сайтов на wordpress).

- Запрет с использованием мета тегов.

- Запрет индексации сайта при помощи файла .htaccess

В самом начале, вам нужно сделать другой обязательный шаг – добавить ваш сайт в Гугл вебмастерс, и в Яндекс вебмастерс.

Как закрыть сайт от индексации в robots.txt

Robots.txt, это текстовый файл, находящийся в корневой папке сайта. В нем прописывается, что запрещено делать поисковым роботам. И в нем же, можно указать запрет на индексацию всего сайта.

Если у вас еще нет этого файла, то вы можете создать его сами. Для этого, нужно просто создать обычный, текстовый файл, например, в программе блокнот. Только не нужно создавать файл в программе Word, или ему подобных, тяжелых офисных программах.

Также имейте в виду, что название файла должно быть robots.txt, и ничего другого. То есть, обязательна буква s на конце, обязательно маленькие буквы. Иначе, поисковые роботы, его проигнорируют. Я как то уже писать про составление robots.txt для wordpress.

Закрытие сайта от индексации в Яндекс.

После этого, нужно закрыть сайт от индексации в Яндекс. Для этого, можно воспользоваться директивой «Disallow», после чего, сохраните файл в корневой папке вашего сайта.

Теперь, для поискового робота Яндекс, будет стоять запрет. Чтобы проверить, сработал ли запрет, нужно зайти в Яндекс Вебмастер, и проверить любую из страниц сайта инструментом «анализ robots.txt».

Закрытие сайта от индексации в Google.

Аналогично запрету в Яндекс, точно также можно сделать запрет на индексацию в Гугл. Только в этом случае, нужно закрыть Гугл робота.

Ну и точно также, можно закрыть вообще от всех роботов, для этого, можно просто прописать две строчки.

User-agent: *

Disallow: /

Запрет индексации сайта при помощи файла robots.txt, простой метод. Но у него есть один недостаток, он не ненадежен. Особенно это касается Гугл. Для него, да и для Яндекса тоже, директивы, прописанные в файле robots.txt, скорее носят рекомендательный характер, но в случае, если роботы поисковиков посчитают нужным проиндексировать сайт, то они это сделают.

Закрытие сайта от индексации в WordPress

Популярная CMS WordPress, имеет свое решение. Таким образом, вебмастер может запретить индексацию, прямо из панели управления сайтом. Перейти в «Настройки» — «Чтение».

Но, как и в случае с файлом robots.txt, запрет к индексации сайта через панель WordPress, не дает сто процентной гарантии.

Запрет с использованием мета тегов.

Для запрета индексации сайта, можно применить специальный html тег:

meta name=»robots» content=»noindex,nofollow»

Разместив этот тег на странице сайта, вы сообщаете поисковикам (этот тег понимают и Яндекс и Гугл), что эту страницу индексировать не надо. А также, ненужно индексировать ссылки на этой странице.

В отличии от использования файла robots.txt, тег robots, является обязательным для исполнения. Но минус этого метода в том, что проставлять придется его на каждой из страниц сайта. Именно этот тег используют различные SEO плагины в WordPress, но с небольшой разницей.

meta name=»robots» content=»noindex,follow»

Здесь вы говорите поисковикам, что страницу индексировать не нужно, но ссылки индексировать нужно.

Если у вас WordPress, то вы просто можете поставить другой плагин, который будет проставлять именно первый тег, то есть, будет ставить запрет и на индексацию страницы в целом, и запрет на индексацию ссылок, расположенных на этой странице. Для этого можно воспользоваться плагином – Robots Meta. Его вы сможете найти на странице поиска плагинов.

Robots Meta имеет простейшие настройки. Для того, чтобы изменить настройки, нужно зайти в пункт «Настройки», и выбрать «Robots Meta»

После чего, снять галочки с первых двух пунктов

Теперь во все страницы сайта, будет включен мета тег, запрещающий индексацию.

Закрыть весь сайт от индексации в файле .htaccess

Ну и последний пункт, это использование файла .htaccess. Это один из файлов настройки, который находится в корневой папке хостинга, то есть, там же, где находится и файл robots.txt. Однако, на некоторых хостингах, этот файл может быть недоступным (обычно на бесплатных хостингах, он недоступен).

Для того, чтобы закрыть файл, достаточно прописать в этом файле всего одну строчку:

deny from all

Но не торопитесь этого делать. Дело в том, что данная команда, закрывает вообще весь сайт, и не только от поисковых роботов, но и от людей тоже. И если ваш сайт использует доступ через админскую панель, то и она (админская панель), будет закрыта. Доступ к сайту будет только через FTP.

Но кроме полного закрытия сайта, можно просто поставить пароль на сайт. И это абсолютный метод, благодаря которому, вы сможете закрыть свой сайт от поисковых систем. Ну а как поставить пароль на сайт через файл .htaccess, смотрите в видео.

life-crazy.ru

Как закрыть сайт от индексации в Robots.txt на время разработки?

Прячем в роботс.тхт всё, кроме главной

Нередко возникает необходимость скрыть в файле Robots.txt разделы или отдельные страницы сайта от «глаз» поисковых роботов. Это дело известное и причины для него могут быть разные: удаление дублей контента из индекса, выкидывание «застрявших» в индексе несуществующих страниц и т.д.

Однако при создании нового сайта бывает полезным закрыть от индексации всё, кроме главной страницы.

Например, вы создаёте интернет-магазин и дальше главной роботу лучше не ходить — чтобы не индексировать пока ещё «кривые» страницы (иначе в дальнейшем могут быть торможения при продвижении..).

Почему лучше оставить главную? В этом случае ПС узнает о существовании нового сайта и начнётся т.н. увеличение траста вашего ресурса (а иначе бы поисковик узнал о вашем проекте только при его полном запуске).

Так что если вам нужно оставить сайт открытым для пользователей, но закрыть всё «нутро» от поисковых систем и в то же время — заявить о себе поисковикам, то можно применить файл Robots.txt для этих целей. Как это делается — написано дальше.

Как закрыть сайт от индексации в Robots.txt, оставив поисковикам главную страницу?

Недавно у меня возникла такая задача, пришлось немного подумать. Как оказалось, всё очень просто — составляем такой Robots.txt:

User-agent: *

Disallow: /

Allow: /$

Вот и всё. Эффект от этого можно проверить инструментом Яндекса для анализа robots.txt.

Как закрыть сайт от индексации с помощью Robots.txt полностью:

Если вообще весь ресурс нужно спрятать от поисковиков, то это совсем просто:

User-agent: *

Disallow: /

Таким образом, если на период разработки сайта вы не желаете «отдавать» ПС внутренние недоделанные страницы, но хотите уже пустить туда пользователей — закрывайте в robots.txt от индексации всё, кроме главной. И не забудьте отредактировать данный файл, когда решите пустить и роботов ![]()

Loading…

Loading…

web-ru.net

Руководство по использованию robots.txt — Robots.Txt по-русски

Цель этого руководства – помочь веб-мастерам и администраторам в использовании robots.txt.

Зто не спецификация – подробное описание и синтаксис можно посмотреть в стандарте исключений для роботов.

Введение

Стандарт исключений для роботов по сути своей очень прост. Вкратце, это работает следующим образом:

Когда робот, соблюдающий стандарт заходит на сайт, он прежде всего запрашивает файл с названием «/robots.txt». Если такой файл найден, Робот ищет в нем инструкции, запрещающие индексировать некоторые части сайта.

Где размещать файл robots.txt

Робот просто запрашивает на вашем сайте URL «/robots.txt», сайт в данном случае – это определенный хост на определенном порту.

На сайте может быть только один файл «/robots.txt». Например, не следует помещать файл robots.txt в пользовательские поддиректории – все равно роботы не будут их там искать. Если вы хотите иметь возможность создавать файлы robots.txt в поддиректориях, то вам нужен способ программно собирать их в один файл robots.txt, расположенный в корне сайта. Вместо этого можно использовать Мета-тег Robots.

Не забывайте, что URL-ы чувствительны к регистру, и название файла «/robots.txt» должно быть написано полностью в нижнем регистре.

Как видите, файл robots.txt нужно класть исключительно в корень сайта.

Что писать в файл robots.txt

В файл robots.txt обычно пишут нечто вроде:

User-agent: *

Disallow: /cgi-bin/

Disallow: /tmp/

Disallow: /~joe/

В этом примере запрещена индексация трех директорий.

Затметьте, что каждая директория указана на отдельной строке – нельзя написать «Disallow: /cgi-bin/ /tmp/». Нельзя также разбивать одну инструкцию Disallow или User-agent на несколько строк, т.к. перенос строки используется для отделения инструкций друг от друга.

Регулярные выражения и символы подстановки так же нельзя использовать. «Звездочка» (*) в инструкции User-agent означает «любой робот». Инструкции вида «Disallow: *.gif» или «User-agent: Ya*» не поддерживаются.

Конкретные инструкции в robots.txt зависят от вашего сайта и того, что вы захотите закрыть от индексации. Вот несколько примеров:

Запретить весь сайт для индексации всеми роботами

User-agent: *

Disallow: /

Разрешить всем роботам индексировать весь сайт

User-agent: *

Disallow:

Или можете просто создать пустой файл «/robots.txt».

Закрыть от индексации только несколько каталогов

User-agent: *

Disallow: /cgi-bin/

Disallow: /tmp/

Disallow: /private/

Запретить индексацию сайта только для одного робота

User-agent: BadBot

Disallow: /

Разрешить индексацию сайта одному роботу и запретить всем остальным

User-agent: Yandex

Disallow:

User-agent: *

Disallow: /

Запретить к индексации все файлы кроме одного

Это довольно непросто, т.к. не существует инструкции “Allow”. Вместо этого можно переместить все файлы кроме того, который вы хотите разрешить к индексации в поддиректорию и запретить ее индексацию:

User-agent: *

Disallow: /docs/

Либо вы можете запретить все запрещенные к индексации файлы:

User-agent: *

Disallow: /private.html

Disallow: /foo.html

Disallow: /bar.html

robotstxt.org.ru

Как закрыть контент от индексации — пошаговое руководство

Иногда возникают такие ситуации, когда нужно Закрыть от индексации часть контента. Пример такой ситуации мы рассматривали здесь.

Также, иногда нужно:

- Скрыть от поиска техническую информацию

- Закрыть от индекса не уникальный контент

- Скрыть сквозной,повторяющийся внутри сайта, контент

- Закрыть мусорные страницы, которые нужны пользователям, но для робота выглядят как дубль

Постараемся в данной статье максимально подробно расписать инструменты при помощи которых можно закрывать контент от индексации.

Закрываем от индексации домен/поддомен:

Для того, чтобы закрыть от индексации домен, можно использовать:

1. Robots.txt

В котором прописываем такие строки.

User-agent: *

Disallow: /

При помощи данной манипуляции мы закрываем сайт от индексации всеми поисковыми системами.

При необходимости Закрыть от индексации конкретной поисковой системой, можно добавить аналогичный код, но с указанием Юзерагента.

User-agent: yandex

Disallow: /

Иногда, же бывает нужно наоборот открыть для индексации только какой-то конкретной ПС. В таком случае нужно составить файл Robots.txt в таком виде:

User-agent: *

Disallow: /

User-agent: Yandex

Allow: /

Таким образом мы позволяем индексировать сайт только однайо ПС. Однако минусом есть то, что при использовании такого метода, все-таки 100% гарантии не индексации нет. Однако, попадание закрытого таким образом сайта в индекс, носит скорее характер исключения.

Для того, чтобы проверить корректность вашего файла Robots.txt можно воспользоваться данным инструментом просто перейдите по этой ссылке http://webmaster.yandex.ru/robots.xml.

Статья в тему: Robots.txt — инструкция для SEO

2. Добавление Мета-тега Robots

Также можно закрыть домен от индексации при помощи Добавления к Код каждой страницы Тега:

META NAME=»ROBOTS» CONTENT=»NOINDEX, NOFOLLOW»

Куда писать META-тег “Robots”

Как и любой META-тег он должен быть помещен в область HEAD HTML страницы:

Данный метод работает лучше чем Предыдущий, темболее его легче использовать точечно нежели Вариант с Роботсом. Хотя применение его ко всему сайту также не составит особого труда.

3. Закрытие сайта при помощи .htaccess

Для Того, чтобы открыть доступ к сайту только по паролю, нужно добавить в файл .htaccess, добавляем такой код:

После этого доступ к сайту будет возможен только после ввода пароля.

Защита от Индексации при таком методе является стопроцентной, однако есть нюанс, со сложностью просканить сайт на наличие ошибок. Не все парсеры могут проходить через процедуру Логина.

Закрываем от индексации часть текста

Очень часто случается такая ситуация, что необходимо закрыть от индексации Определенные части контента:

- меню

- текст

- часть кода.

- ссылку

Скажу сразу, что распространенный в свое время метод при помощи тега <noindex> не работает.

<noindex>Тут мог находится любой контент, который нужно было закрыть</noindex>

Однако существует альтернативный метод закрытия от индексации, который очень похож по своему принципу, а именно метод закрытия от индексации при помощи Javascript.

Закрытие контента от индексации при помощи Javacascript

При использовании данного метода текст, блок, код, ссылка или любой другой контент кодируется в Javascript, а далее Данный скрипт закрывается от индексации при помощи Robots.txt

Такой Метод можно использовать для того, чтобы скрыть например Меню от индексации, для лучшего контроля над распределением ссылочного веса. К примеру есть вот такое меню, в котором множество ссылок на разные категории. В данном примере это — порядка 700 ссылок, если не закрыть которые можно получить большую кашу при распределении веса.

Данный метод гугл не очень то одобряет, так-как он всегда говорил, что нужно отдавать одинаковый контент роботам и пользователям. И даже рассылал письма в средине прошлого года о том, что нужно открыть для индексации CSS и JS файлы.

Подробнее об этом можно почитать тут.

Однако в данный момент это один из самых действенных методов по борьбе с индексацией нежелательного контента.

Точно также можно скрывать обычный текст, исходящие ссылки, картинки, видео материалы, счетчики, коды. И все то, что вы не хотите показывать Роботам, или что является не уникальным.

Как закрыть от индексации конкретную страницу:

Для того, чтобы закрыть от индекса конкретную страницу чаще всего используются такие методы:

- Роботс txt

- Мета robots noindex

В случае первого варианта закрытия страницы в данный файл нужно добавить такой текст:

User-agent: ag

Disallow: http://site.com/page

Таким образом данная страница не будет индексироваться с большой долей вероятности. Однако использование данного метода для точечной борьбы со страницами, которые мы не хотим отдавать на индексацию не есть оптимальным.

Так, для закрытия одной страницы от индекса лучше воспользоваться тегом

META NAME=»ROBOTS» CONTENT=»NOINDEX, NOFOLLOW»

Для этого просто нужно добавить в область HEAD HTML страницы. Данный метод позволяет не перегружать файл robots.txt лишними строчками.

Ведь если Вам нужно будет закрыть от индекса не 1 страницу, а к примеру 100 или 200 , то нужно будет добавить 200 строк в этот файл. Но это в том случае, если все эти страницы не имеют общего параметра по которому их можно идентифицировать. Если же такой параметр есть, то их можно закрыть следующим образом.

Закрытие от индексации Раздела по параметру в URL

Для этого можно использовать 2 метода:

Рассмотрим 1 вариант

К примеру, у нас на сайте есть раздел, в котором находится неуникальная информация или Та информация, которую мы не хотим отдавать на индексацию и вся эта информация находится в 1 папке или 1 разделе сайта.

Тогда для закрытия данной ветки достаточно добавить в Robots.txt такие строки:

Если закрываем папку, то:

Disallow: /папка/

Если закрываем раздел, то:

Disallow: /Раздел/*

Также можно закрыть определенное расшерение файла:

User-agent: *

Disallow: /*.js

Данный метод достаточно прост в использовании, однако как всегда не гарантирует 100% неиндексации.

Потому лучше в добавок делать еще закрытие при помощи

META NAME=»ROBOTS» CONTENT=»NOINDEX”

Который должен быть добавлен в секцию Хед на каждой странице, которую нужно закрыть от индекса.

Точно также можно закрывать от индекса любые параметры Ваших УРЛ, например:

?sort

?price

?”любой повторяющийся параметр”

Однозначно самым простым вариантом является закрытие от индексации при помощи Роботс.тхт, однако, как показывает практика — это не всегда действенный метод.

Методы, с которыми нужно работать осторожно:

Также существует достаточно грубый метод Закрытия чего — либо от роботов, а именно запрет на уровне сервера на доступ робота к конкретному контенту.

1. Блокируем все запросы от нежелательных User Agents

Это правило позволяет заблокировать нежелательные User Agent, которые могут быть потенциально опасными или просто перегружать сервер ненужными запросами.

В данному случае плохим ботом можно указать Любую поисковую машину, парсер либо что либо еще.

Подобные техники используются например для скрытия от робота Ахрефса ссылки с сайта, который был создан/сломан, чтобы конкуренты сеошники не увидели истинных источников ссылочной массы сайта.

Однако это метод стоит использовать если вы точно знаете, что хотите сделать и здраво оцениваете последствия от этих действий.

Использование HTTP-заголовка X-Robots-Tag

Заголовок X-Robots-Tag, выступает в роли элемента HTTP-заголовка для определенного URL. Любая директива, которая может использоваться в метатеге robots, применима также и к X-Robots-Tag.

В X-Robots-Tag перед директивами можно указать название агента пользователя. Пример HTTP-заголовка X-Robots-Tag, который запрещает показ страницы в результатах поиска различных систем:

В заключение

Ситуации, когда необходимо закрыть контент от индексации случаются довольно часто, иногда нужно почистить индекс, иногда нужно скрыть какой-то нежелательный материал, иногда нужно взломать чужой сайт и в роботсе указать disalow all, чтобы выбросить сайт зеркало из индекса.

Основные и самые действенные методы мы рассмотрели, как же их применять — дело вашей фантазии и целей, которые вы преследуете.

Хорошие статьи в продолжение:

— Стоит ли открывать рубрики для индексации, если в разных рубриках выводятся одни и те же посты?

— Как открывать страницы поиска в интернет магазине — руководство

А что вы думаете по этому поводу? Давайте обсудим в комментариях!)

Оцените статью

Загрузка…

Загрузка…seoprofy.ua

Как закрыть сайт от индексации

Задача

Нужно закрыть сайт от индексации. В robots.txt написано:

User-agent: * Disallow: /

— Этого достаточно или же нужно что-то еще?

— Этого вполне достаточно.

А теперь с разъяснениями

Robots.txt — текстовый файл, расположенный на сайте, который предназначен для роботов поисковых систем. В этом файле вебмастер может указать параметры индексирования своего сайта как для всех роботов сразу, так и для каждой поисковой системы по отдельности.

Konstantin Chagin / Shutterstock.com

Konstantin Chagin / Shutterstock.comЗапрещающая директива

Если вы хотите, чтобы поисковики не индексировали сайт, который находится на этапе разработки, то нужно использовать соответствующую директиву в robots.txt.

<code>Disallow: / # блокирует доступ ко всему сайту</code>

Но это ещё не всё!

Важно! Сама по себе эта директива 'Disallow: /' не способна запретит сканирование вашего сайта. Нужно грамотно оформить весь файл robots.txt.

В самом robots.txt проверяется наличие записей, начинающихся с 'User-agent:', в них ищутся подстроки 'Yandex', либо '*'. В этих инструкциях регистр значения не имеет.

Если обнаружено 'User-agent: Yandex', директивы для 'User-agent: *' не учитываются (потому что есть персональная директива для Яндекса).

Когда доступ к сайту неограничен

Если записи 'User-agent: Yandex' и 'User-agent: *' отсутствуют, считается, что доступ роботу не ограничен.

Запрет есть, а доступ разрешен

Запрет есть, а доступ разрешенТакже действует правило: если обнаружены директивы для конкретного робота, директивы 'User-agent: Yandex' и 'User-agent: *' не используются.

Правильный robots.txt, который блокирует доступ ко всему сайту

Важно! Чтобы запретить доступ робота ко всему сайту, используйте две директивы.

Вот так выглядит правильный robots.txt, запрещающий доступ к сайту для всех роботов сразу:

<code>User-agent: * # директива для всех роботов</code> <code>Disallow: / # блокирует доступ ко всему сайту</code>

Чтобы проверить правильность обработки вашего файла robots.txt, воспользуйтесь анализатором файла robots.txt.

Теперь все правильно — доступ к сайту запрещен

Теперь все правильно — доступ к сайту запрещенИсточник: Яндекс.Вебмастер «Использование директив Disallow и Allow»

Кроме того, чтобы не показывать посетителям незавершенный проект, можно просто закрыть сайт паролем.

Будьте внимательны!

Только не забудьте открыть страницы сайта для индексации по окончании всех работ. Такое часто бывает. Даже у меня был один случай. Спустя год, мне стало интересно как поживает сайт который я сделал одному клиенту. Решил проверить сколько у них страниц в индексе и, о ужас, в индексе ничего. Я стал выяснять причину и обнаружил, что robots.txt стоит запрет на индексирование. Но клиент этого даже не заметил, так как он весьма скептически относился к продвижению. Ему нужен был сайт в качестве онлайн-каталога.

А вообще, случается такое, что вебмастера продвигают контент, который закрыт в Robots.txt. Обязательно проверьте наличие продвигаемых страниц в индексе ПС. Постранично это можно сделать в вебмастере Яндекса. А если используете системы автоматизации, например PromoPult, то массовую проверку SEO-параметров продвигаемых URL-ов проводите на втором шаге проекта «Страницы».

fortress-design.com

Запрет индексации сайта поисковыми системами. Самостоятельно проверяем и меняем файл robots.txt. Зачем закрывать сайт от индексации?

Зачем закрывать сайт от индексации? Проверяем и меняем файл robots.txt самостоятельно.

Ответ

Для закрытия всего сайта от индексации во всех поисковых системах необходимо в файле robots.txt прописать следующую директиву:

Disallow: /

Далее, подробнее разберемся в вопросе подробнее и ответим на другие вопросы:

- Процесс индексации что это?

- Зачем закрывать сайт от индексации?

- Инструкции по изменению файла robots.txt

- Проверка корректности закрытия сайта от индексации

- Альтернативные способы закрыть сайт от поисковых систем

Оглавление

Процесс индексации

Индексация сайта — это процесс добавления данных вашего ресурса в индексную базу поисковых систем. Ранее мы подробно разбирали вопрос индексации сайта в Яндекс и Google.

Именно в этой базе и происходит поиск информации в тот момент, когда вы вводите любой запрос в строку поиска:

Именно из индексной базы поисковая система в момент ввода запроса производит поиск информации.

Именно из индексной базы поисковая система в момент ввода запроса производит поиск информации.Если сайта нет в индексной базе поисковой системе = тогда сайте нет и в поисковой выдаче. Его невозможно будет найти по поисковым запросам.

В каких случаях может потребоваться исключать сайт из баз поисковых систем?

Зачем закрывать сайт от индексации

Причин, по которым необходимо скрыть сайт от поисковых систем может быть множество. Мы не можем знать личных мотивов всех вебмастеров. Давайте выделим самые основные объективные причины, когда закрытие сайта от индексации оправданно.

Сайт еще не готов

Ваш сайт пока не готов для просмотра целевой аудиторией. Вы находитесь в стадии разработки (или доработки) ресурса. В таком случае его лучше закрыть от индексации. Тогда сырой и недоработанный ресурс не попадет в индексную базу и не испортит «карму» вашему сайту. Открывать сайт лучше после его полной готовности и наполненности контентом.

Сайт узкого содержания

Ресурс предназначен для личного пользования или для узкого круга посетителей. Он не должен быть проиндексирован поисковыми системами. Конечно, данные такого ресурса можно скрыть под паролем, но это не всегда необходимо. Часто, достаточно закрыть его от индексации и избавить от переходов из поисковых систем случайных пользователей.

Переезд сайта или аффилированный ресурс

Вы решили изменить главное зеркало сайта. Мы закрываем от индексации старый домен и открываем новый. При этом меняем главное зеркало сайта. Возможно у Вас несколько сайтов по одной теме, а продвигаете вы один, главный ресурс.

Стратегия продвижения

Возможно, Ваша стратегия предусматривает продвижение ряда доменов, например, в разных регионах или поисковых системах. В этом случае, может потребоваться закрытие какого-либо домена в какой-либо поисковой системе.

Другие мотивы

Может быть целый ряд других личных причин закрытия сайта от индексации поисковыми системами. Можете написать в комментариях Вашу причину закрытия сайта от индексации.

Закрываем сайт от индексации в robots.txt

Обращение к Вашему сайту поисковой системой начинается с прочтения содержимого файла robots.txt. Это служебный файл со специальными правилами для поисковых роботов.

Подробнее о директивах robots.txt:

Самый простой и быстрый способ это при первом обращении к вашему ресурсу со стороны поисковых систем (к файлу robots.txt) сообщить поисковой системе о том, что этот сайт закрыт от индексации. В зависимости от задач, сайт можно закрыть в одной или нескольких поисковых системах. Вот так:

| Закрыть во всех системах | Закрыть только в Яндекс | Закрыть только в Google |

| User-agent: * Disallow: / | User-agent: Yandex Disallow: / | User-agent: Googlebot Disallow: / |

Инструкция по изменению файла robots.txt

Мы не ставим целью дать подробную инструкцию по всем способам подключения к хостингу или серверу, укажем самый простой способ на наш взгляд.

Файл robots.txt всегда находится в корне Вашего сайта. Например, robots.txt сайта iqad.ru будет находится по адресу:

https://iqad.ru/robots.txt

Для подключения к сайту, мы должны в административной панели нашего хостинг провайдера получить FTP (специальный протокол передачи файлов по сети) доступ: <ЛОГИН> И <ПАРОЛЬ>.

Авторизуемся в панели управления вашим хостингом и\или сервером, находим раздел FTP и создаем ( получаем ) уникальную пару логин \ пароль.

Авторизуемся в панели управления вашим хостингом и\или сервером, находим раздел FTP и создаем ( получаем ) уникальную пару логин \ пароль.В описании раздела или в разделе помощь, необходимо найти и сохранить необходимую информацию для подключения по FTP к серверу, на котором размещены файлы Вашего сайта. Данные отражают информацию, которую нужно указать в FTP-клиенте:

- Сервер (Hostname) – IP-адрес сервера, на котором размещен Ваш аккаунт

- Логин (Username) – логин от FTP-аккаунта

- Пароль (Password) – пароль от FTP-аккаунта

- Порт (Port) – числовое значение, обычно 21

Далее, нам потребуется любой FTP-клиент, можно воспользоваться бесплатной программой filezilla (https://filezilla.ru/). Вводим данные в соответствующие поля и нажимаем подключиться.

FTP-клиент filezilla интуитивно прост и понятен: вводим cервер (host) + логин (имя пользователя) + пароль + порт и кнопка {быстрое соединение}. В поле справа находим файл robots.txt и изменяем его. Не забудьте сохранить изменения.

FTP-клиент filezilla интуитивно прост и понятен: вводим cервер (host) + логин (имя пользователя) + пароль + порт и кнопка {быстрое соединение}. В поле справа находим файл robots.txt и изменяем его. Не забудьте сохранить изменения.После подключения прописываем необходимые директивы. См.

раздел:

Закрываем сайт от индексации в robots.txt

Проверка корректности закрытия сайта от индексации

После того, как вы внесли все необходимые коррективы в файл robots.txt необходимо убедится в том, что все сделано верно. Для этого открываем файл robots.txt на вашем сайте.

Инструменты iqad

В арсенале команды IQAD есть набор бесплатных инструментов для SEO-оптимизаторов. Вы можете воспользоваться бесплатным сервисом просмотра файла robots.txt:

Проверить индексацию

Самостоятельно

Открыть самостоятельно, файл находится корне Вашего сайта, по адресу:

www.site.ru/robots.txt

Где www.site.ru – адрес Вашего сайта.

Сервис Я.ВЕБМАСТЕР

Бесплатный сервис Я.ВЕБМАСТЕР — анализ robots.txt.

Бесплатный сервис ЯНДЕКС.ВЕБМАСТЕР проверит ваш robots.txt, покажет какими секциями Вашего файла пользуется поисковая система Яндекс:

Так же, в сервисе можно проверить запрещена ли та или иная страница вашего сайта к индексации:

Достаточно в специальное поле внести интересующие Вас страницы и ниже отобразится результат.

Достаточно в специальное поле внести интересующие Вас страницы и ниже отобразится результат.Альтернативные способы закрыть сайт от поисковых систем

Помимо классического способа с использованием файла robots.txt можно прибегнуть и к другим, не стандартным, подходам. Однако у них есть ряд недостатков.

- Вы можете отдавать поисковым роботам отличный от 200 код ответа сервера. Но это не гарантирует 100% исключения сайта из индекса. Какое-то время робот может хранить копию Ваших страниц и отдавать именно их.

- С помощью специального meta тега: <meta name=»robots»>

<meta name=»robots» content=»noindex, nofollow»>

Но так как метатег размещается и его действие относиться только к 1 странице, то для полного закрытия сайта от индексации Вам придется разместить такой тег на каждой странице Вашего сайта.

Недостатком этого может быть несовершенство поисковых систем и проблемы с индексацией ресурса. Пока робот не переиндексирует весь сайт, а на это может потребоваться много времени, иногда несколько месяцев, часть страниц будет присутствовать в поиске.

- Использование технологий, усложняющих индексацию Вашего сайта. Вы можете спрятать контент Вашего сайта под AJAX или скриптами. Таким образом поисковая система не сможет увидеть контент сайта. При этом по названию сайта или по открытой части в индексе поисковиков может что-то хранится. Более того, уже завра новое обновление поисковых роботов может научится индексировать такой контент.

- Скрыть все данные Вашего сайта за регистрационной формой. При этом стартовая страница в любом случае будет доступна поисковым роботам.

Заключение

Самым простым способом закрыть сайт от индексации, во всех поисковых системах, необходимо в файле robots.txt прописать следующую директиву:

Disallow: /

«robots.txt» это служебный файл со специальными правилами для поисковых роботов.

Файл robots.txt всегда находится в корне Вашего сайта. Для изменения директив файла Вам потребуется любой FTP-клиент.

Помимо классического способа с использованием файла robots.txt можно прибегнуть и к другим, не стандартным, подходам. Однако у них есть ряд недостатков. Для проверки текущих директив Вашего сайта предлагаем воспользоваться бесплатным сервисом просмотра файла robots.txt:

Проверить индексацию

iqad.ru