Robots.txt — инструкция для SEO

24173 222

| SEO | – Читать 12 минут |

Прочитать позже

ЧЕК-ЛИСТ: ТЕХНИЧЕСКАЯ ЧАСТЬ — ROBOTS.TXT

Ильхом Чакканбаев

Автор блога Seopulses.ru

Файл robots.txt — это текстовый файл, в котором содержаться инструкции для поисковых роботов, в частности каким роботам и какие страницы допускается сканировать, а какие нет. В данной статье рассмотрим, где можно найти robots.txt, как его редактировать и какие правила по его использовать в SEO-продвижении.

Содержание

1. Зачем robots.txt нужен на сайте

2. Где можно найти файл robots.txt и как его создать или редактировать

3. Как создать и редактировать robots.txt

4. Инструкция по работе с robots.txt

5. Синтаксис в robots.txt

6. Директивы в Robots.txt

— Disallow

— Allow

— Sitemap

— Clean-param

— Crawl-delay

7. Как проверить работу файла robots. txt

txt

— В Яндекс.Вебмастер

— В Google Search Console

Заключение

Зачем robots.txt нужен на сайте

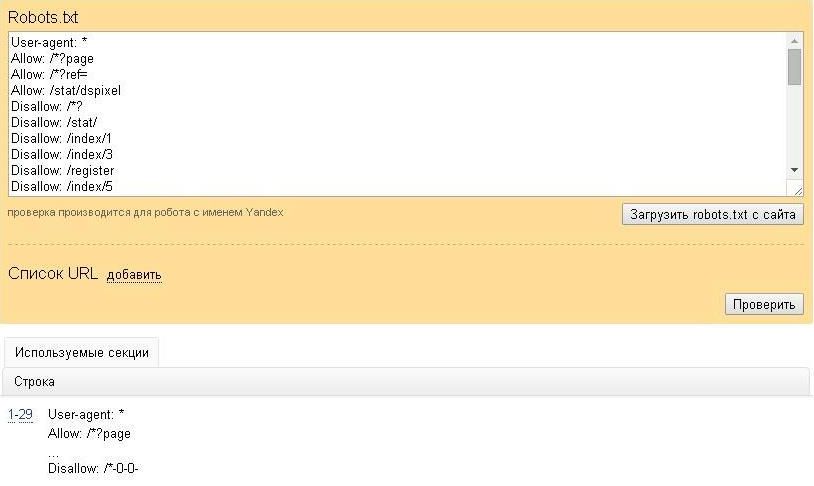

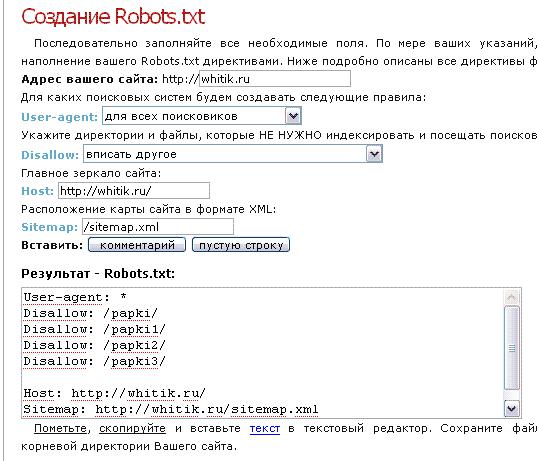

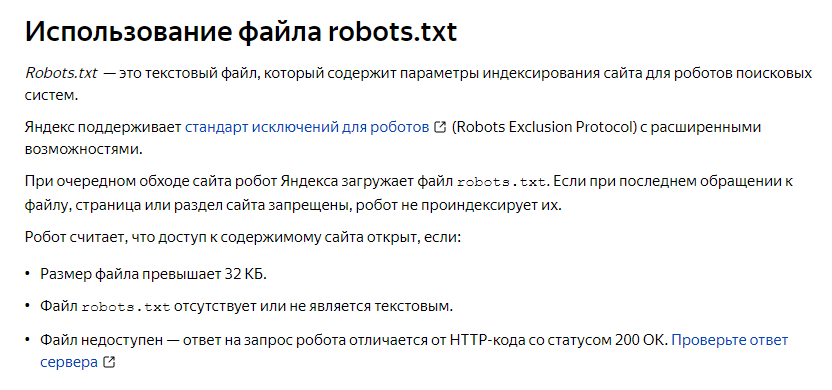

Командами robots.txt называются директивы, которые разрешают либо запрещают сканировать отдельные участки веб-ресурса. С помощью файла вы можете разрешать или ограничивать сканирование поисковыми роботами вашего веб-ресурса или его отдельных страниц, чем можете повлиять на позиции сайта. Пример того, как именно директивы будут работать для сайта:

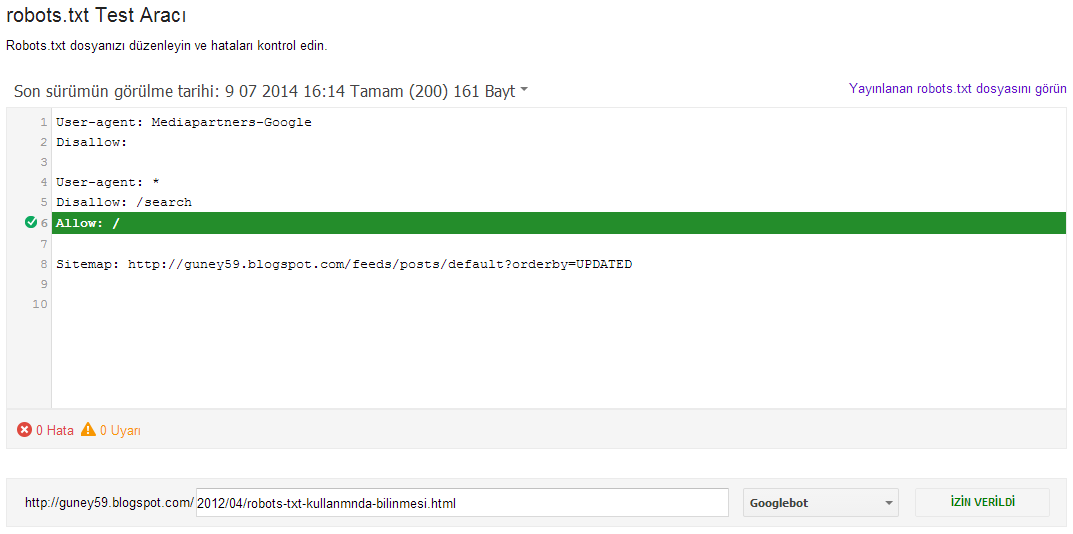

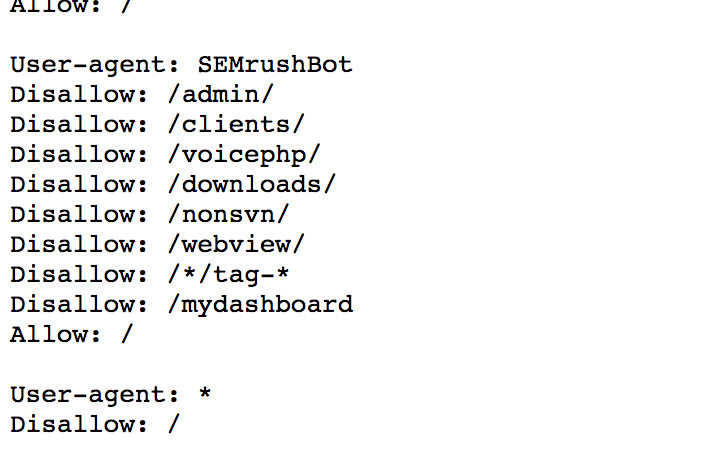

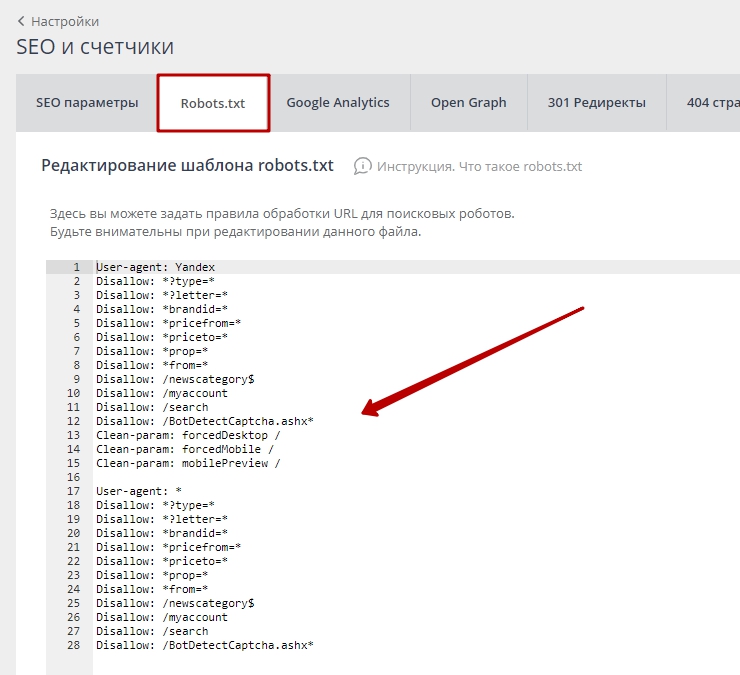

На картинке видно, что доступ к определенным папкам, а иногда и отдельным файлам, не допускает к сканированию поисковыми роботами. Директивы в файле носят рекомендательный характер и могут быть проигнорированы поисковым роботом, но как правило, они учитывают данное указание. Техническая поддержка также предупреждает вебмастеров, что иногда требуются альтернативные методы для запрета индексирования:

Какие страницы нужно закрыть от индексации

| Читать |

Где можно найти файл robots. txt и как его создать или редактировать

txt и как его создать или редактировать

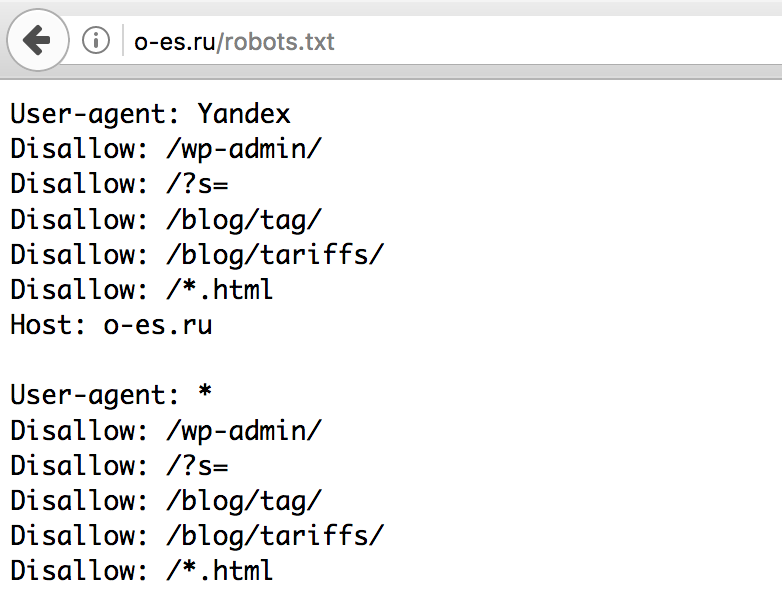

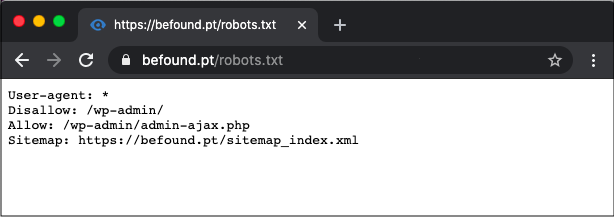

Чтобы проверить файл robots.txt сайта, следует добавить к домену «/robots.txt», примеры:

https://seopulses.ru/robots.txt

https://serpstat.com/robots.txt

https://netpeak.net/robots.txt

Как провести анализ индексации сайта

| Читать |

Как создать и редактировать robots.txt

Вручную

Данный файл всегда можно найти, подключившись к FTP сайта или в файлом редакторе хостинг-провайдера в корневой папке сайта (как правило, public_html):

Далее открываем сам файл и можно его редактировать.

Если его нет, то достаточно создать новый файл.

После вводим название документа и сохраняем.

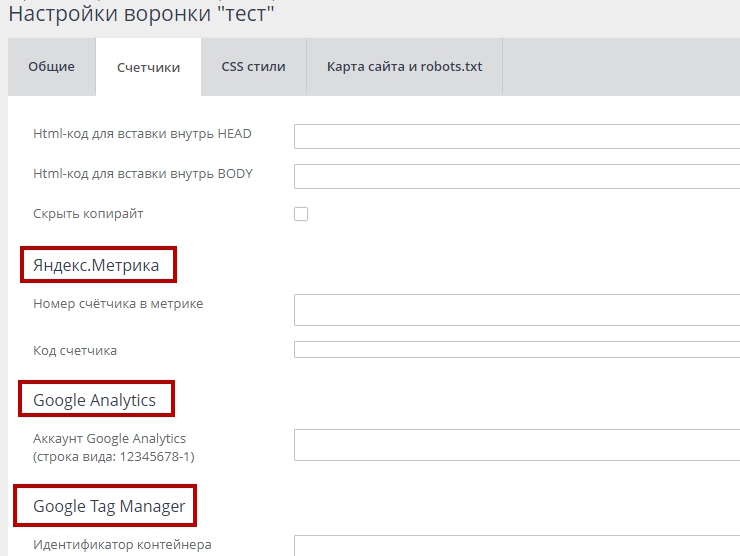

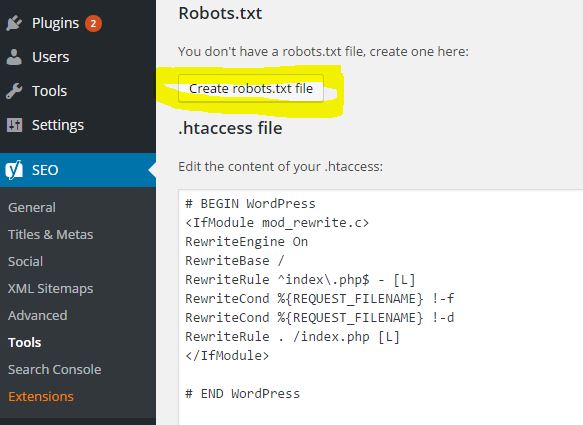

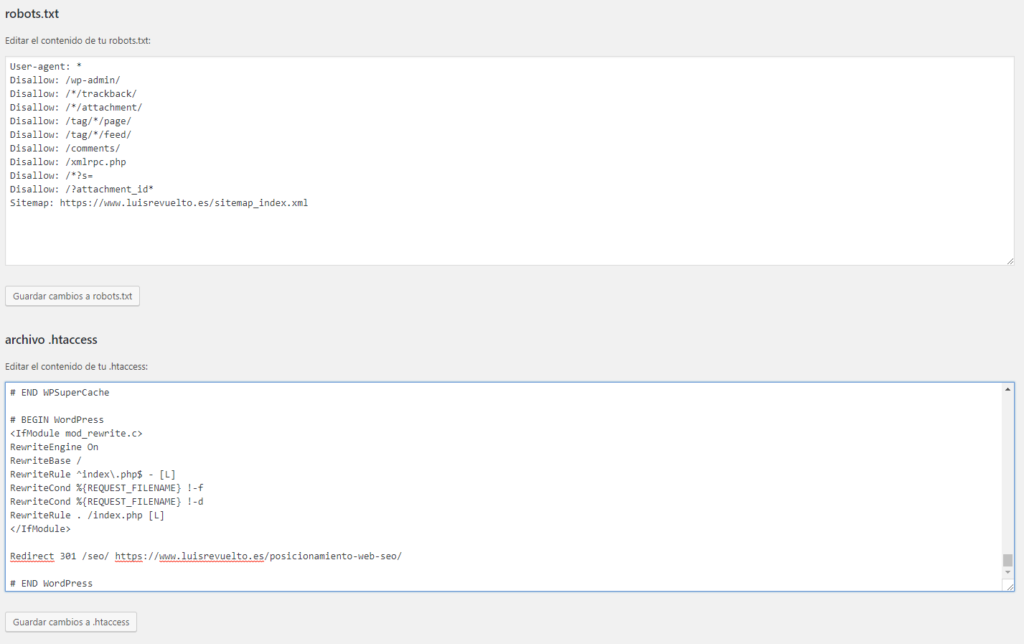

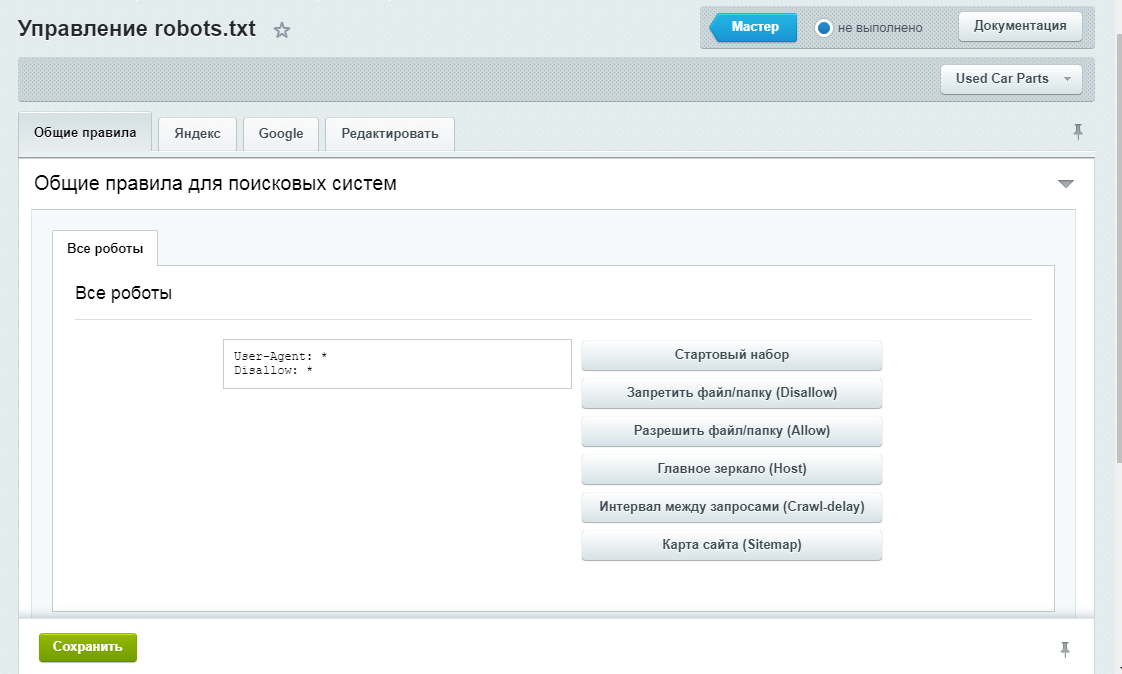

Через модули/дополнения/плагины

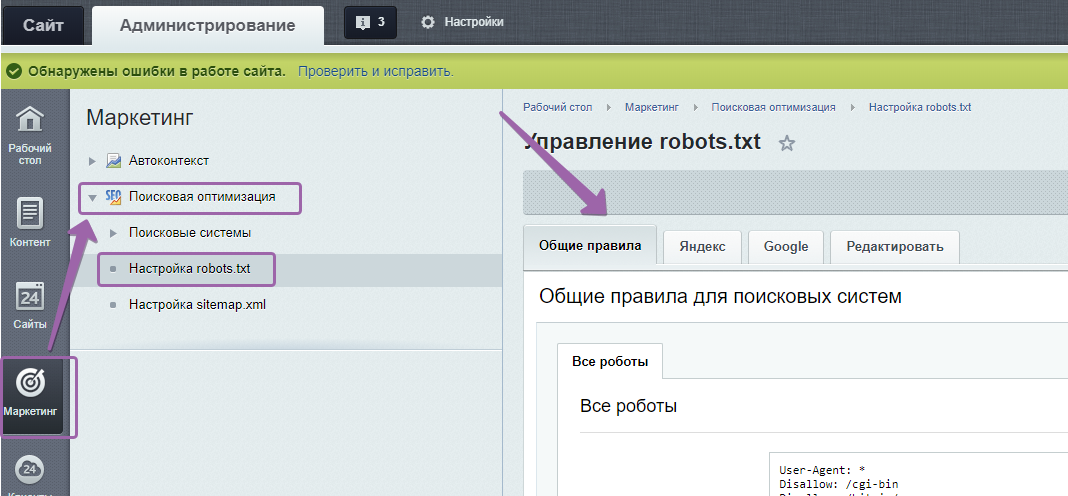

Чтобы управлять данный файлом прямо в административной панели сайта следует установить дополнительный модуль:

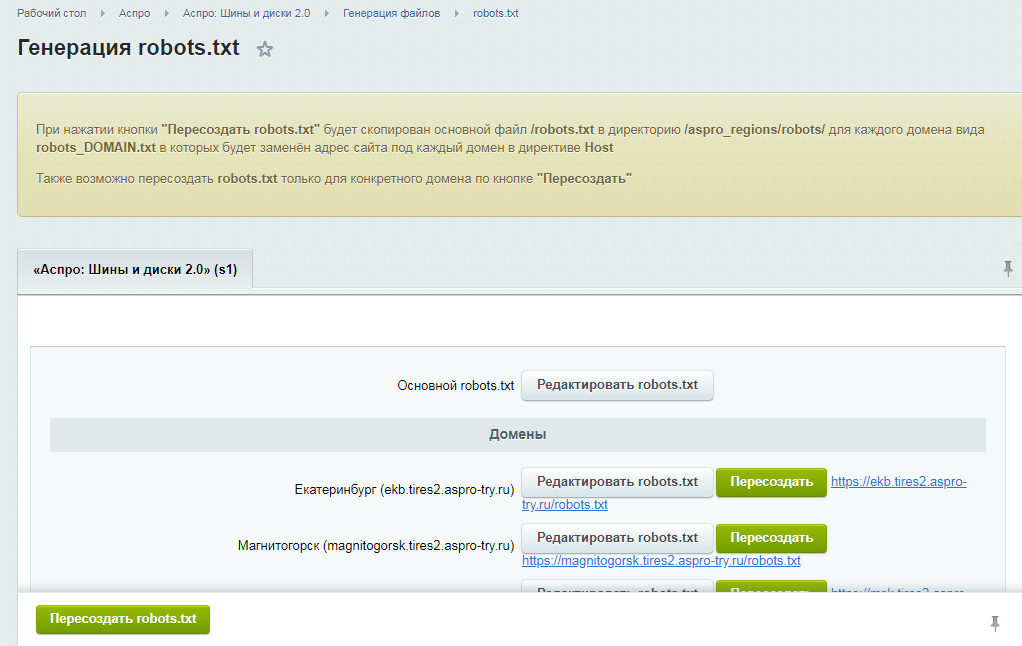

Для 1С-Битрикс;

WordPress;

Для Opencart;

Webasyst.

Самые распространенные SEO-ошибки на сайте: инфографика

| Читать |

Инструкция по работе с robots.txt

В первую очередь записывается User-Agent, указывая на то, к какому роботу идет обращение, например:

User-agent: Yandex — для обращения к поисковому роботу Яндекса;

User-agent: Googlebot — в случае с краулером Google;

User-agent: YandexImages — при работе с ботом Яндекс.Картинок.

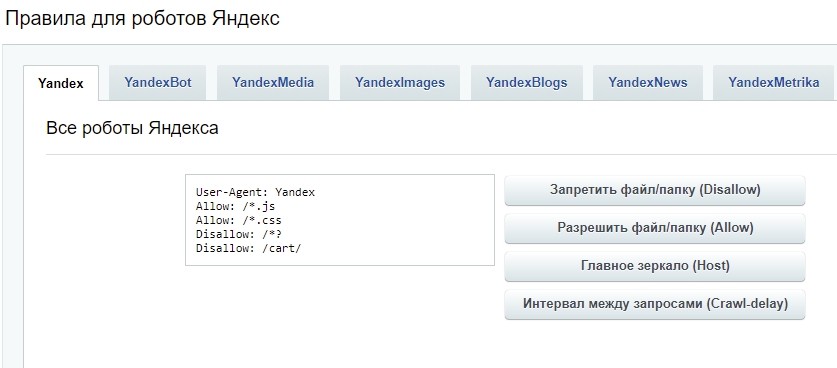

Обращения в robots.txt для Яндекса:

Чтобы обозначить обращение для поисковых роботов данной системы применяют такие значения:

Yandex Bot — основной робот, который будет индексировать ваш ресурс;

Yandex Media — робот, который специализируется на сканировании мультимедийной информации;

Yandex Images — индексатор для Яндекс.Картинок;

Yandex Direct — робот, который сканирует страницы веб-площадок, имеющих отношение к рекламе в Яндексе;

Yandex Blogs — робот для поиска в блогах и форумах, который индексирует комментарии в постах;

Yandex News — бот собирающий данные по Яндекс Новостям;

Yandex Pagechecker — робот, который обращается к странице с целью валидировать микроразметку.

Обращения в robots.txt для Google:

Имена используемые для краулеров от Google:

Googlebot — краулер, индексирующий страницы веб-сайта;

Googlebot Image — сканирует изображения и картинки;

Googlebot Video — сканирует всю видео информацию;

AdsBot Google — анализирует качество размещенной рекламы на страницах для компьютеров;

AdsBot Google Mobile — анализирует качество рекламы мобильных версий сайта;

Googlebot News — оценивает страницы для использования в Google Новости;

AdsBot Google Mobile Apps — расценивает качество рекламы для приложений на андроиде, аналогично AdsBot.

Полный список роботов Яндекс и Google.

Синтаксис в robots.txt

В первую очередь записывается User-Agent, указывая на то, к какому роботу идет обращение, например:

# — отвечает за комментирование;

* — указывает на любую последовательность символов после этого знака. По умолчанию указывается при любого правила в файле;

По умолчанию указывается при любого правила в файле;

$ — отменяет действие *, указывая на то что на этом элементе необходимо остановиться.

Почему сайт не индексируется или

как проверить индексацию сайта в Google и Яндекс

| Читать |

Директивы в Robots.txt

Disallow

Disallow запрещает индексацию отдельной страницы или группы (в том числе всего сайта). Чаще всего используется для того, чтобы скрыть технические страницы, динамические или временные страницы.

Пример #1

# Полностью закрывает весь сайт от индексации

User-agent: *

Disallow: /

Пример #2

# Блокирует для скачивания все страницы раздела /category1/, например, /category1/page1/ или caterogy1/page2/

Disallow: /category1/

Пример #3

# Блокирует для скачивания страницу раздела /category2/

User-agent: *

Disallow: /category2/$

Пример #4

# Дает возможность сканировать весь сайт просто оставив поле пустым

User-agent: *

Disallow:

Важно! Следует понимать, что регистр при использовании правил имеет значение, например, Disallow: /Category1/ не запрещает посещение страницы /category1/.

Директива Allow указывает на то, что роботу можно сканировать содержимое страницы/раздела, как правило, используется, когда в полностью закрытом разделе, нужно дать доступ к определенному документу.

Пример #1

# Дает возможность роботу скачать файл site.ru//feed/turbo/ несмотря на то, что скрыт раздел site.ru/feed/.

Disallow: */feed/*

Allow: /feed/turbo/

Пример #2

# разрешает скачивание файла doc.xml

Allow: /doc.xml

Sitemap

Директива Sitemap указывает на карту сайта, которая используется в SEO для вывода списка URL, которые нужно проиндексировать в первую очередь.

Важно понимать, что в отличие от стандартных директив у нее есть особенности в записи:

Следует указывать полный URL, когда относительный адрес использовать запрещено;

На нее не распространяются остальные правила в файле robots. txt;

txt;

XML-карта сайта должна иметь в URL-адресе домен сайта.

Пример

Sitemap.xml или карта сайта: как создать и настроить для Google и Яндекс

| Читать |

Clean-param

Используется когда нужно указать Яндексу (в Google она не работает), что страница с GET-параметрами (например, site.ru?param1=2¶m2=3) и метками (в том числе utm) не влияющие на содержимое сайта, не должна быть проиндексирована.

Пример #1

#для адресов вида:

www.example1.com/forum/showthread.php?s=681498b9648949605&t=8243

www.example1.com/forum/showthread.php?s=1e71c4427317a117a&t=8243

#robots.txt будет содержать:

User-agent: Yandex

Disallow:

Clean-param: s /forum/showthread.php

Пример #2

#для адресов вида:

www.example2.com/index.php?page=1&sid=2564126ebdec301c607e5df

www. example2.com/index.php?page=1&sid=974017dcd170d6c4a5d76ae

example2.com/index.php?page=1&sid=974017dcd170d6c4a5d76ae

#robots.txt будет содержать:

User-agent: Yandex

Disallow:

Clean-param: sid /index.php

Подробнее о данной директиве можно прочитать здесь.

Crawl-delay

Важно! Данная директива не поддерживается в Яндексе с 22 февраля 2019 года и в Google 1 сентября 2019 года, но работает с другими роботами. Настройки скорости скачивания можно найти в Яндекс.Вебмастер и Google Search Console.

Crawl-delay указывает временной интервал в секундах, в течение которого роботу разрешается делать только 1 сканирование. Как правило, необходима лишь в случаях, когда у сайта наблюдается большая нагрузка из-за сканирования.

Пример

# Допускает скачивание страницы лишь раз в 3 секунды

Crawl-delay: 3

Хотите узнать, как использовать Serpstat для поиска ошибок на сайте?

Заказывайте бесплатную персональную демонстрацию сервиса, и наши специалисты вам все расскажут! 😉

| Оставить заявку! |

| Узнать подробнее! |

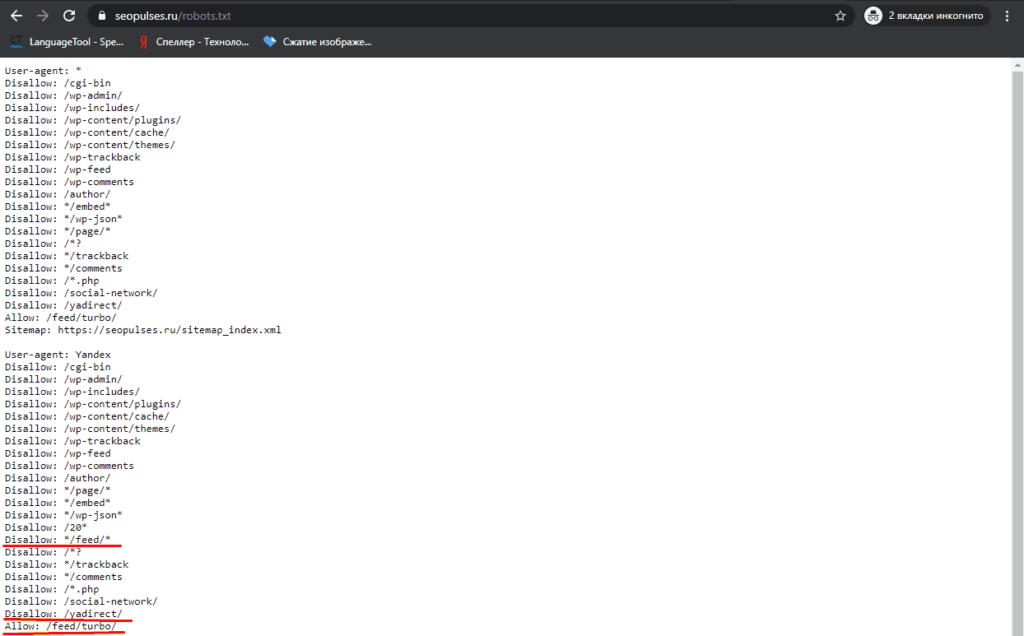

Как проверить работу файла robots. txt

txt

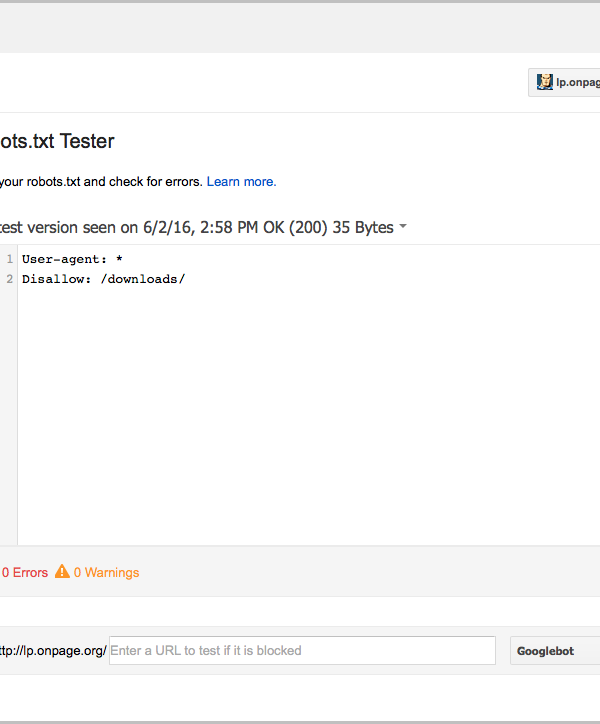

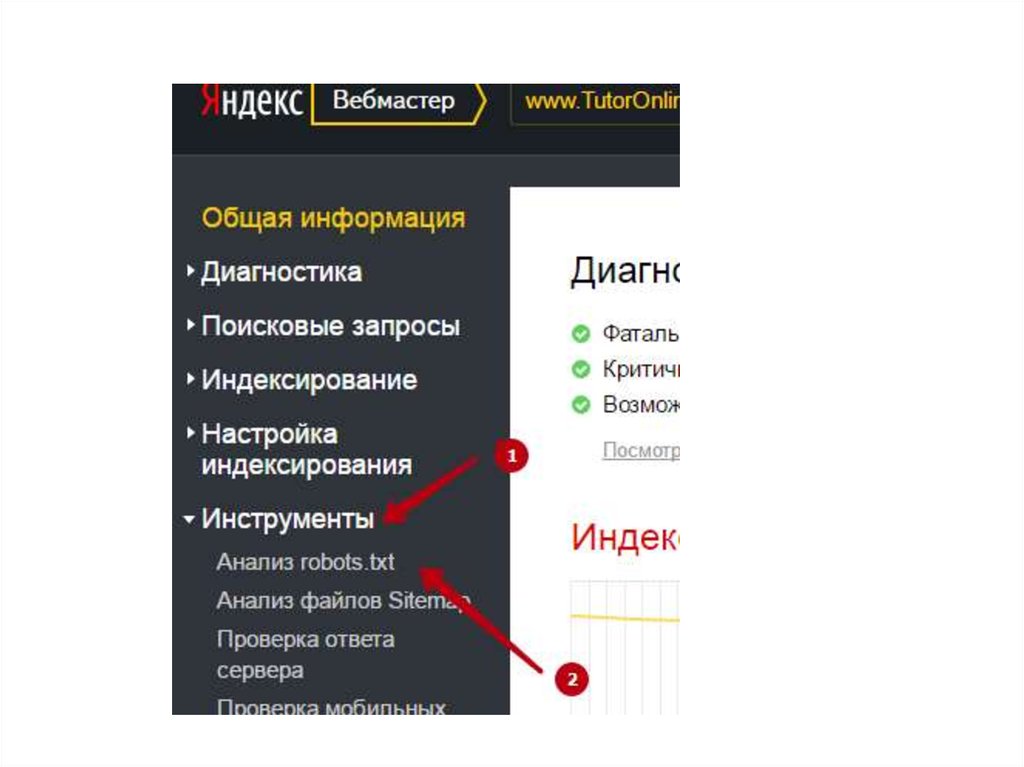

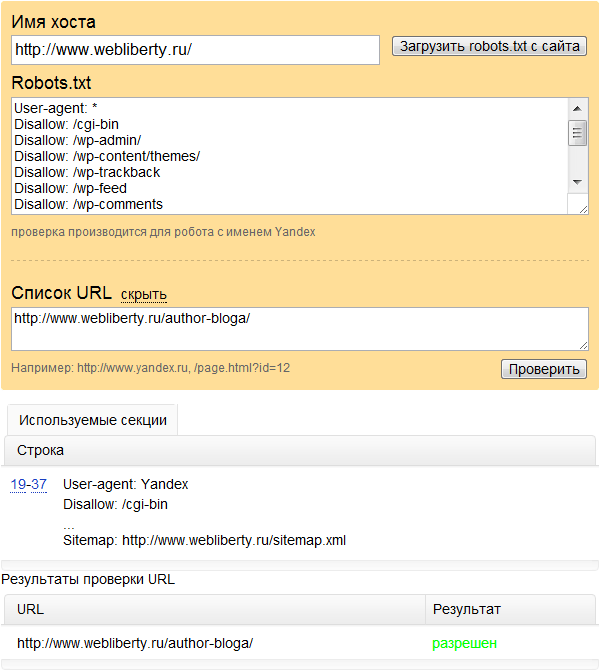

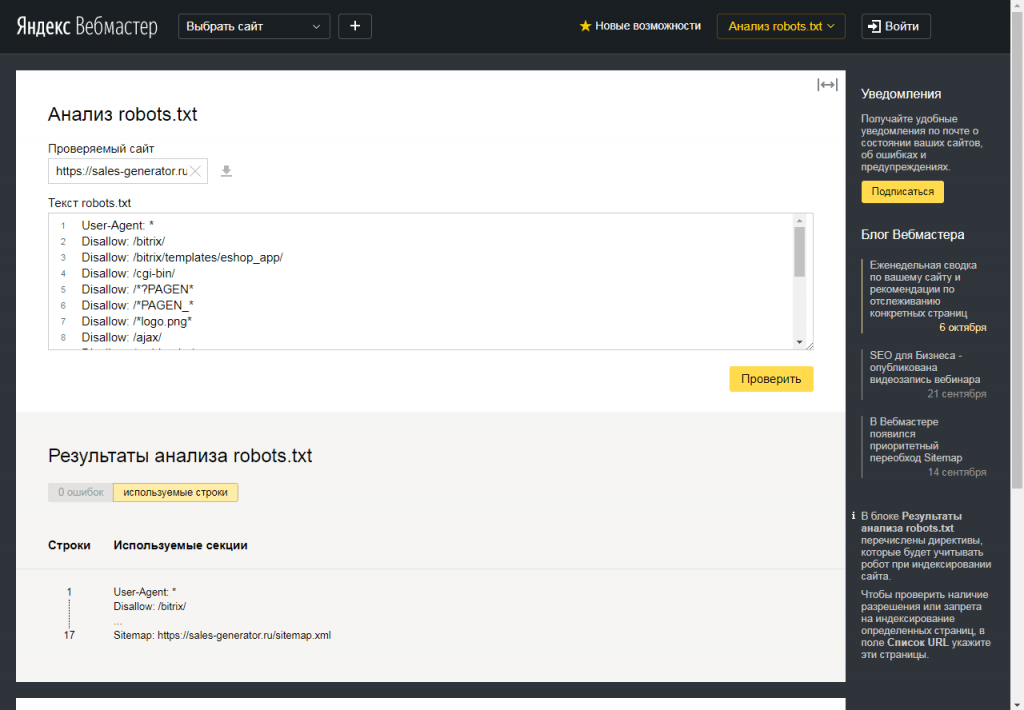

В Яндекс.Вебмастер

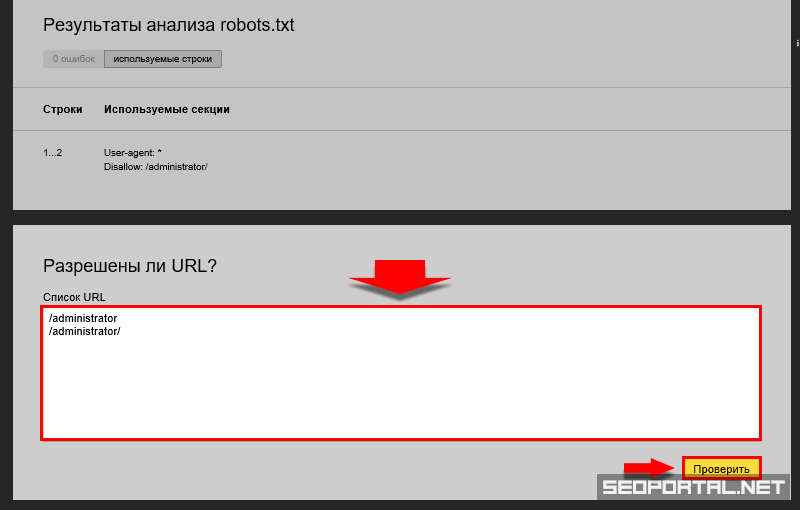

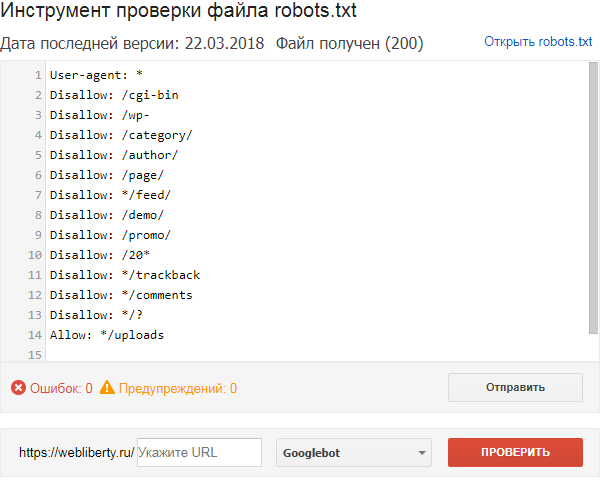

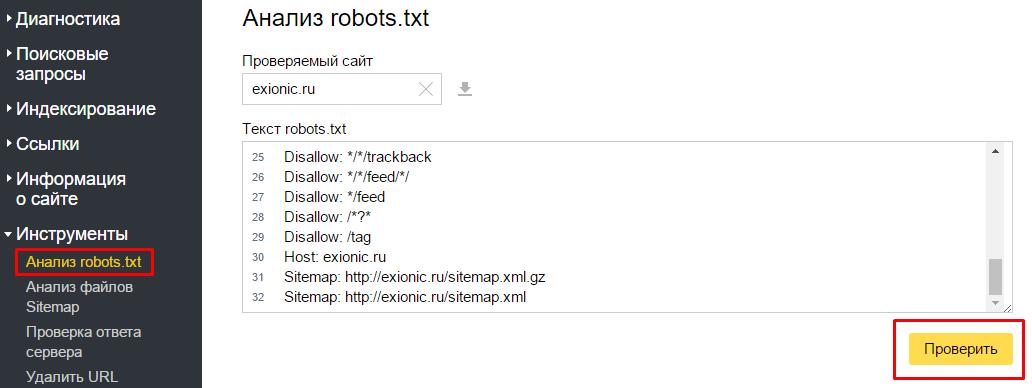

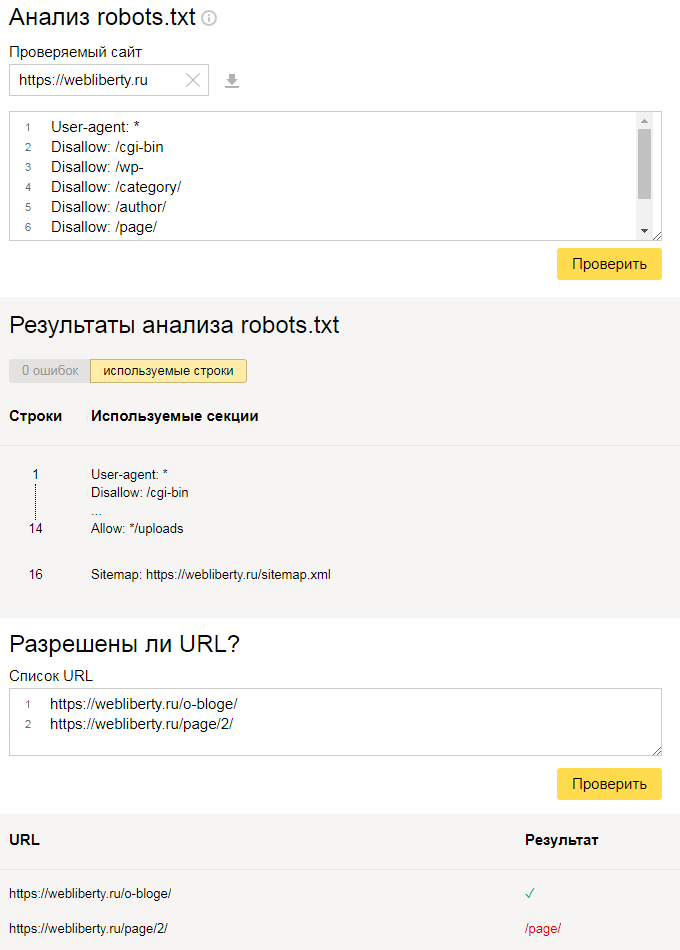

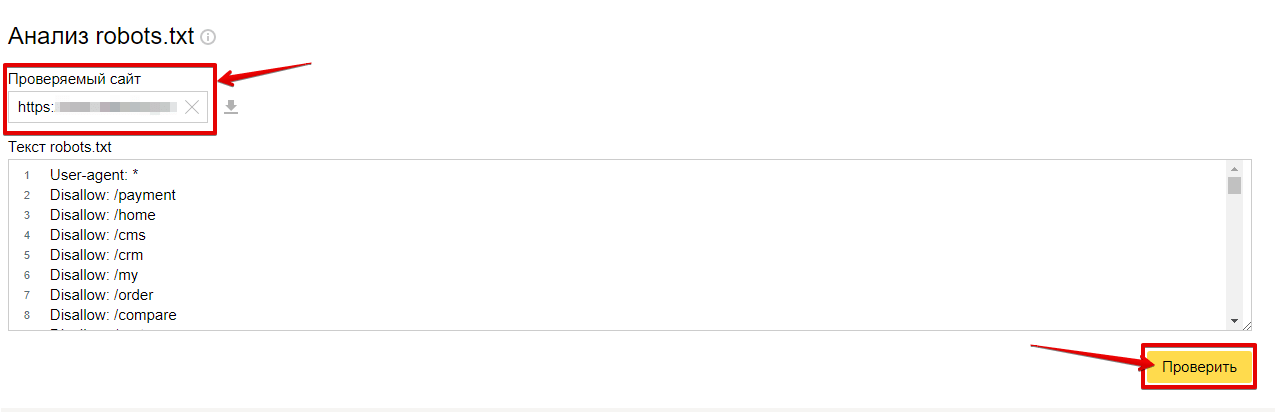

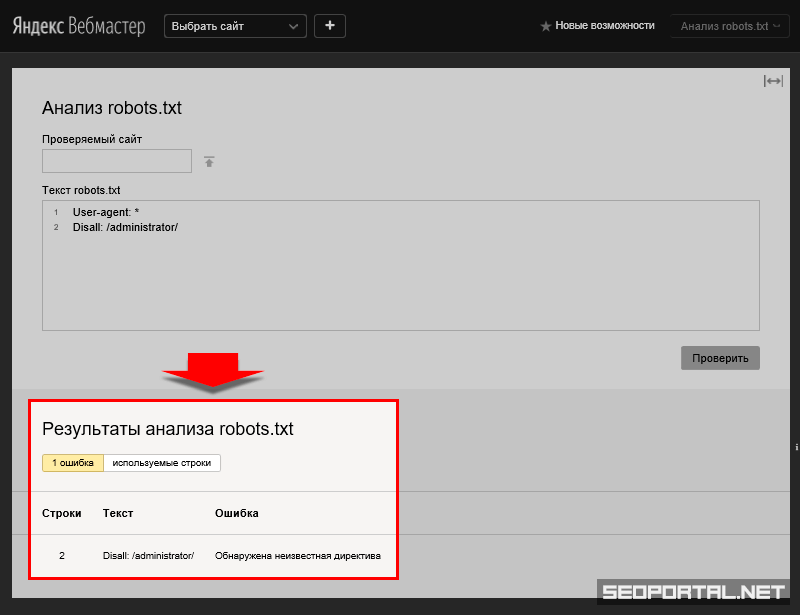

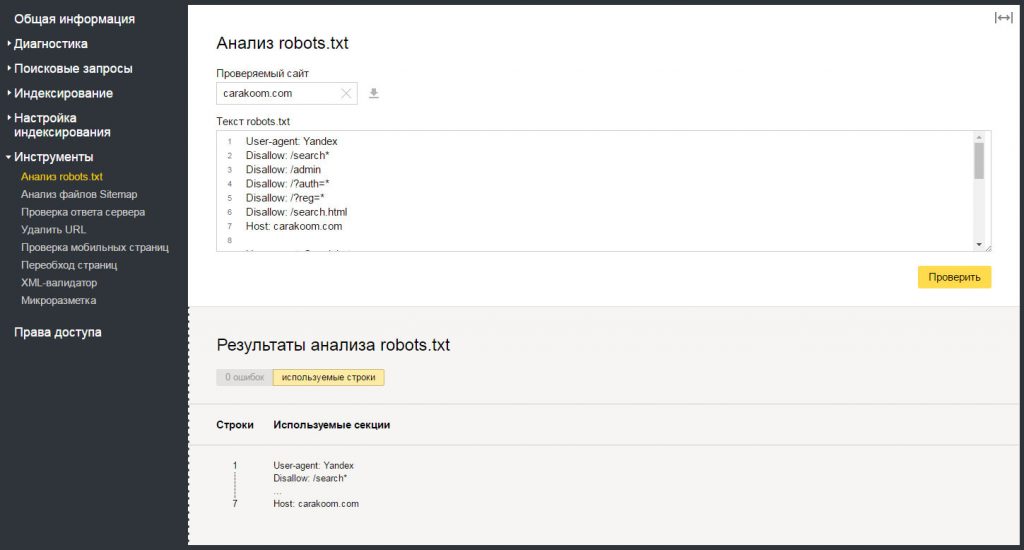

В Яндекс.Вебмастер в разделе «Инструменты→ Анализ robots.txt» можно увидеть используемый поисковиком свод правил и наличие ошибок в нем.

Также можно скачать другие версии файла или просто ознакомиться с ними.

Чуть ниже имеется инструмент, который дает возможно проверить сразу до 100 URL на возможность сканирования.

В нашем случае мы проверяем эти правила.

Как видим из примера все работает нормально.

Также если воспользоваться сервисом «Проверка ответа сервера» от Яндекса также будет указано, запрещен ли для сканирования документ при попытке обратиться к нему.

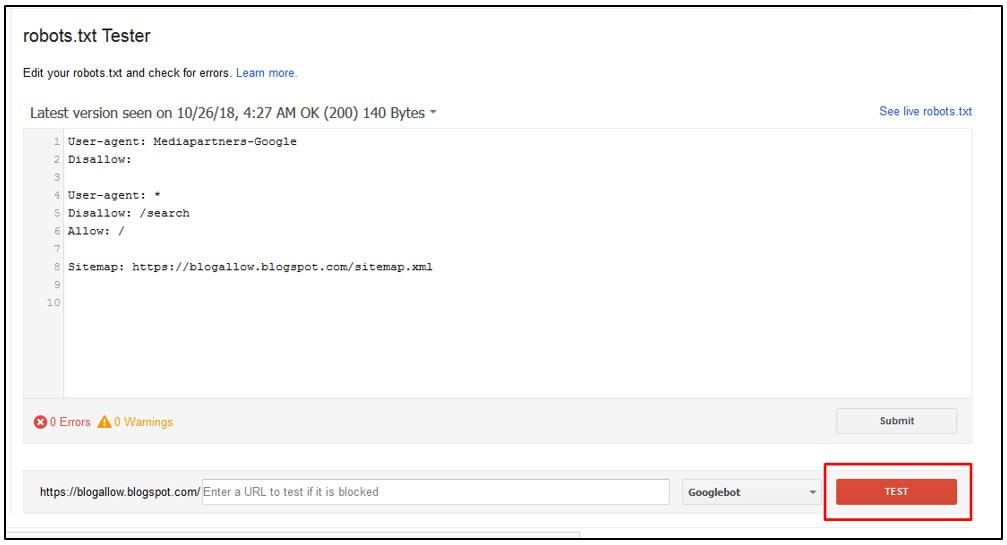

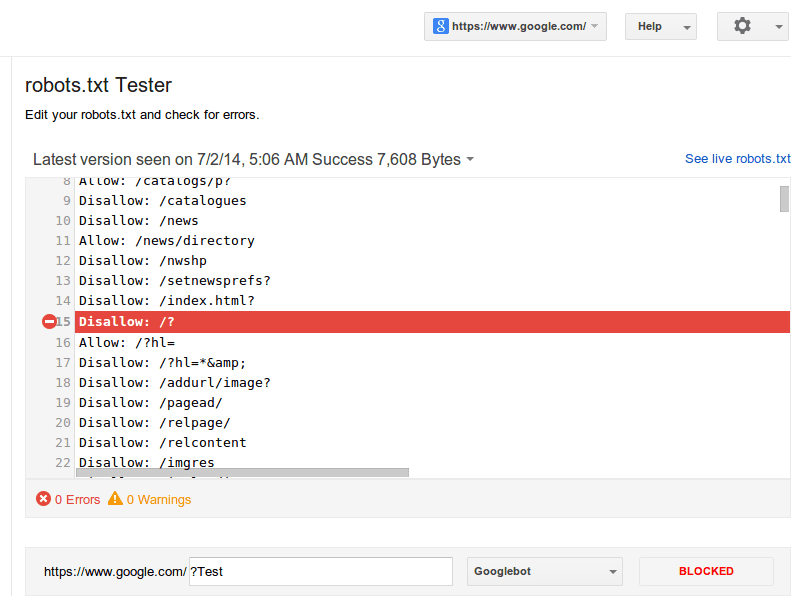

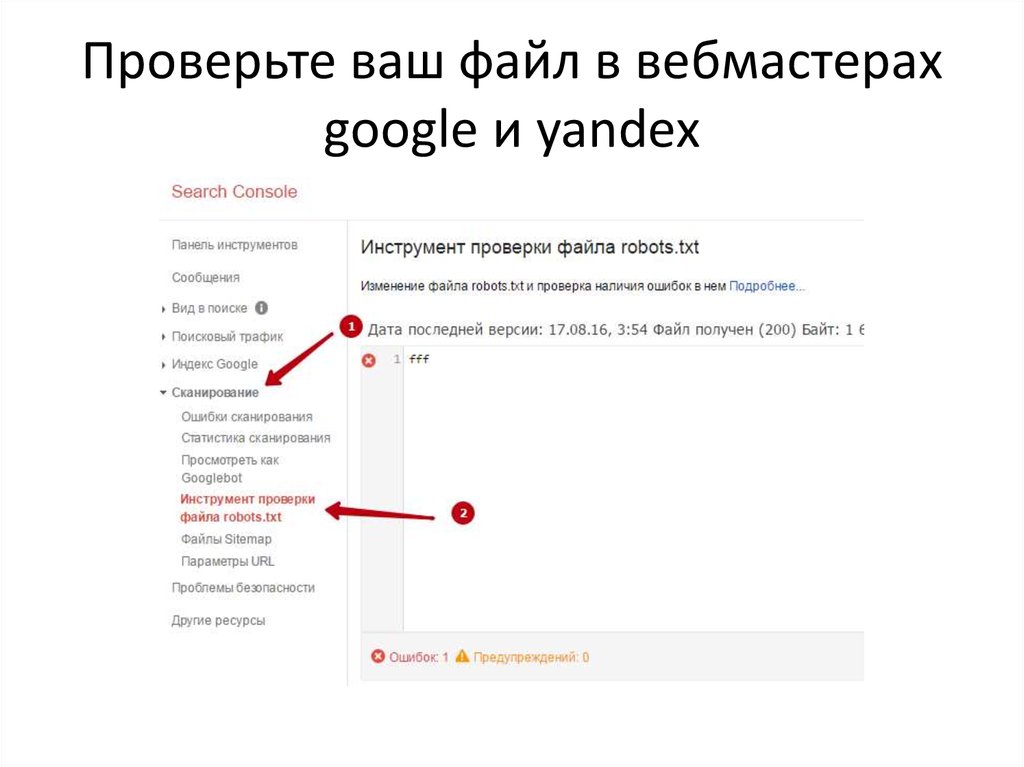

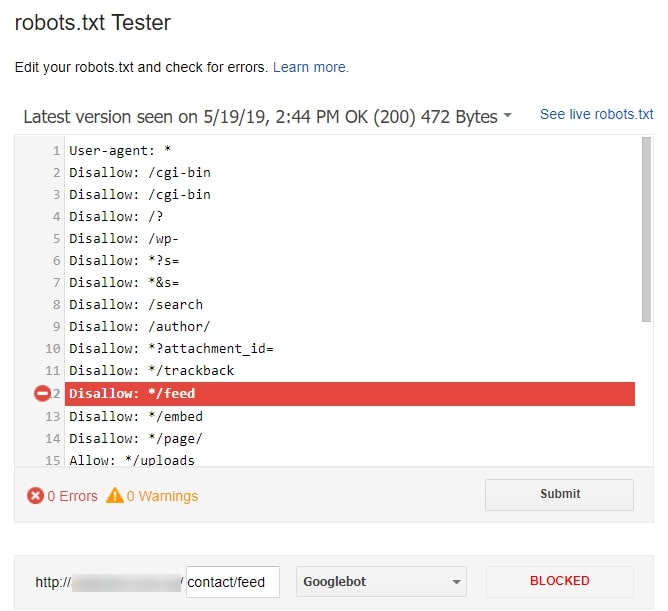

В Google Search Console

В случае с Google можно воспользоваться инструментом проверки Robots.txt, где потребуется в первую очередь выбрать нужный сайт.

Важно! Ресурсы-домены в этом случае выбирать нельзя.

Теперь мы видим:

Сам файл;

Кнопку, открывающую его;

Симулятор для проверки сканирования.

Если в симуляторе ввести заблокированный URL, то можно увидеть правило, запрещающее сделать это и уведомление «Недоступен».

Однако, если ввести заблокированный URL в страницу поиска в новой Google Search Console (или запросить ее индексирование), то можно увидеть, что страница заблокирована в файле robots.txt.

Заключение

Robots.txt необходим для ограничения сканирования определенных страниц вашего сайта, которые не нужно включать в индекс, так как они носят технический характер. Для создания такого документа можно воспользоваться Блокнотом или Notepad++.

Пропишите к каким поисковым роботам вы обращаетесь и дайте им команду, как описано выше.

Далее, проверьте его правильность через встроенные инструменты Google и Яндекс. Если не возникает ошибок, сохраните файл в корневую папку и еще раз проверьте его доступность, перейдя по ссылке http://yoursiteadress.com/robots.txt. Активная ссылка говорит о том, что все сделано правильно.

Помните, что директивы носят рекомендательный характер, а для того чтобы полностью запретить индексирование страницы нужно воспользоваться другими методами.

«Список задач» — готовый to-do лист, который поможет вести учет

о выполнении работ по конкретному проекту. Инструмент содержит готовые шаблоны с обширным списком параметров по развитию проекта, к которым также можно добавлять собственные пункты.

| Начать работу со «Списком задач» |

Сэкономьте время на изучении Serpstat

Хотите получить персональную демонстрацию сервиса, тестовый период или эффективные кейсы использования Serpstat?

Оставьте заявку и мы свяжемся с вами 😉

Оцените статью по 5-бальной шкале

4.71 из 5 на основе 13 оценок

Нашли ошибку? Выделите её и нажмите Ctrl + Enter, чтобы сообщить нам.

Рекомендуемые статьи

SEO

Анатолий Бондаренко

Основные ошибки в оптимизации сайта и как их выявить

SEO

Ilkhom Chakkanbaev

Идеальная оптимизация страницы сайта: наглядное руководство [Инфографика]

SEO

Анастасия Кочеткова

Краулинговый или рендеринговый бюджет: не вместо, а вместе

Кейсы, лайфхаки, исследования и полезные статьи

Не успеваешь следить за новостями? Не беда! Наш любимый редактор подберет материалы, которые точно помогут в работе. Только полезные статьи, реальные кейсы и новости Serpstat раз в неделю. Присоединяйся к уютному комьюнити 🙂

Только полезные статьи, реальные кейсы и новости Serpstat раз в неделю. Присоединяйся к уютному комьюнити 🙂

Нажимая кнопку, ты соглашаешься с нашей политикой конфиденциальности.

Поделитесь статьей с вашими друзьями

Вы уверены?

Спасибо, мы сохранили ваши новые настройки рассылок.

Сообщить об ошибке

Отменить

правильный пример на WordPress для Яндекса и Google

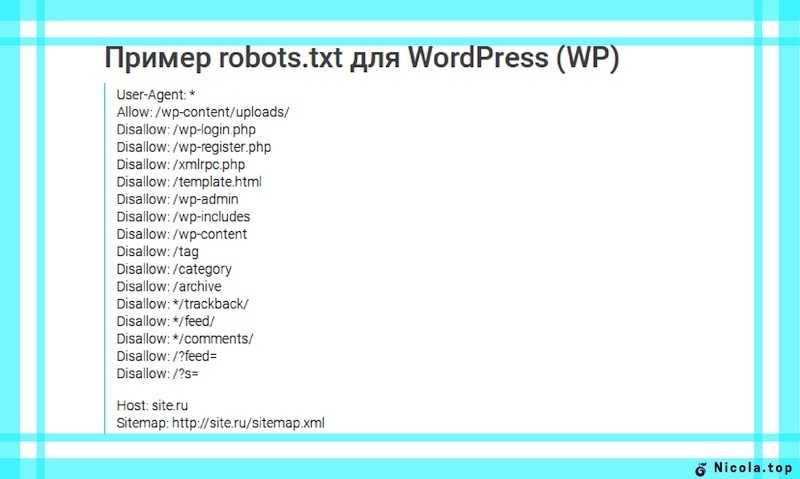

Всем привет! Сегодня я бы хотел Вам рассказать про файл robots.txt. Да, про него очень много чего написано в интернете, но, если честно, я сам очень долгое время не мог понять, как же создать правильный robots.txt. В итоге я сделал один и он стоит на всех моих блогах. Проблем с индексацией сайта я не замечаю, robots.txt работает просто великолепно.

Robots.txt для WordPress

А зачем, собственно говоря, нужен robots.txt? Ответ все тот же – продвижение сайта в поисковых системах. То есть составление robots.txt – это одно из частей поисковой оптимизации сайта (кстати, очень скоро будет урок, который будет посвящен всей внутренней оптимизации сайта на WordPress. Поэтому не забудьте подписаться на RSS, чтобы не пропустить интересные материалы.).

Поэтому не забудьте подписаться на RSS, чтобы не пропустить интересные материалы.).

Одна из функций данного файла – запрет индексации ненужных страниц сайта. Также в нем задается адрес карты сайта sitemap.xml и прописывается главное зеркало сайта (сайт с www или без www).

Примечание: для поисковых систем один и тот же сайт с www и без www совсем абсолютно разные сайты. Но, поняв, что содержимое этих сайтов одинаковое, поисковики “склеивают” их. Поэтому важно прописать главное зеркало сайта в robots.txt. Чтобы узнать, какое главное (с www или без www), просто наберите адрес своего сайта в браузере, к примеру, с www, если Вас автоматически перебросит на тот же сайт без www, значит главное зеркало Вашего сайта без www. Надеюсь правильно объяснил.

Было:

Стало (после перехода на сайт, www автоматически удалились, и сайт стал без www):

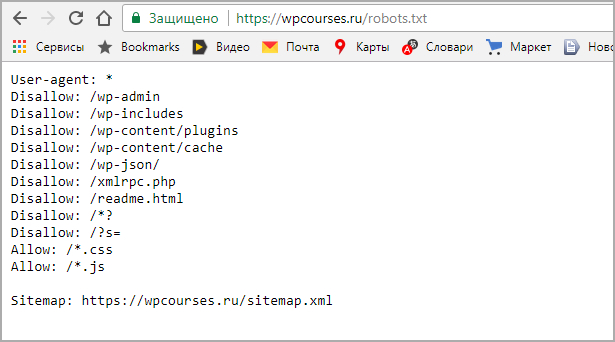

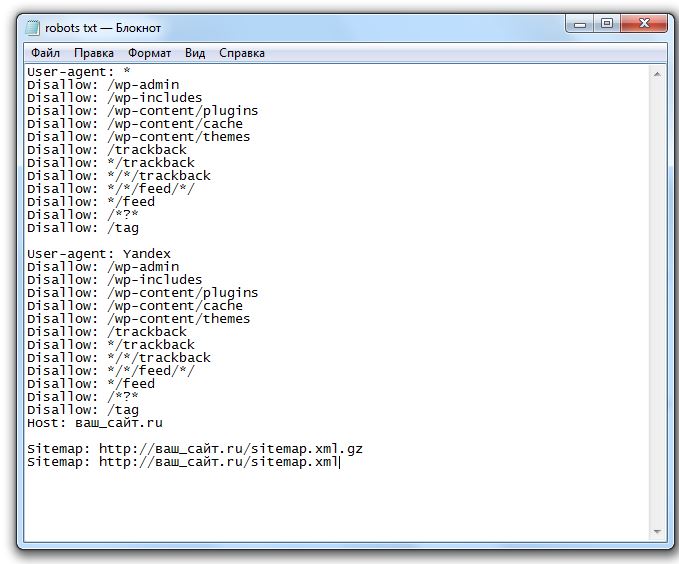

Так вот, этот заветный, по-моему, правильный robots.txt для WordPress Вы можете увидеть ниже.

Правильный Robots.txt для WordPress

User-agent: *

Disallow: /cgi-bin

Disallow: /wp-admin

Disallow: /wp-includes

Disallow: /wp-content/plugins

Disallow: /wp-content/cache

Disallow: /wp-content/themes

Disallow: /trackback

Disallow: */trackback

Disallow: */*/trackback

Disallow: */*/feed/*/

Disallow: */feed

Disallow: /*?*

Disallow: /tag

User-agent: Yandex

Disallow: /cgi-bin

Disallow: /wp-admin

Disallow: /wp-includes

Disallow: /wp-content/plugins

Disallow: /wp-content/cache

Disallow: /wp-content/themes

Disallow: /trackback

Disallow: */trackback

Disallow: */*/trackback

Disallow: */*/feed/*/

Disallow: */feed

Disallow: /*?*

Disallow: /tag

Host: wpnew.ru

Sitemap: https://wpnew.ru/sitemap.xml.gz

Sitemap: https://wpnew.ru/sitemap.xml

Все что дано выше, Вам нужно скопировать в текстовой документ с расширением .txt, то есть, чтобы название файла было robots.txt. Данный текстовой документ Вы можете создать, к примеру, с помощью программы Notepad++. Только, не забудьте, пожалуйста, изменить в последних трех строчках адрес wpnew.ru на адрес своего сайта. Файл robots.txt должен располагаться в корне блога, то есть в той же папке, где находятся папки wp-content, wp-admin и др. .

Данный текстовой документ Вы можете создать, к примеру, с помощью программы Notepad++. Только, не забудьте, пожалуйста, изменить в последних трех строчках адрес wpnew.ru на адрес своего сайта. Файл robots.txt должен располагаться в корне блога, то есть в той же папке, где находятся папки wp-content, wp-admin и др. .

Те, кому же лень создавать данный текстовой файл, можете просто скачать robots.txt и также там подкорректировать 3 строчки.

Хочу отметить, что в техническими частями, о которых речь пойдет ниже, себя сильно загружать не нужно. Привожу их для “знаний”, так сказать общего кругозора, чтобы знали, что и зачем нужно.

Итак, строка:

User-agent

задает правила для какого-то поисковика: к примеру “*” (звездочкой) отмечено, что правила для всех поисковиков, а то, что ниже

User-agent: Yandex

означает, что данные правила только для Яндекса.

Disallow

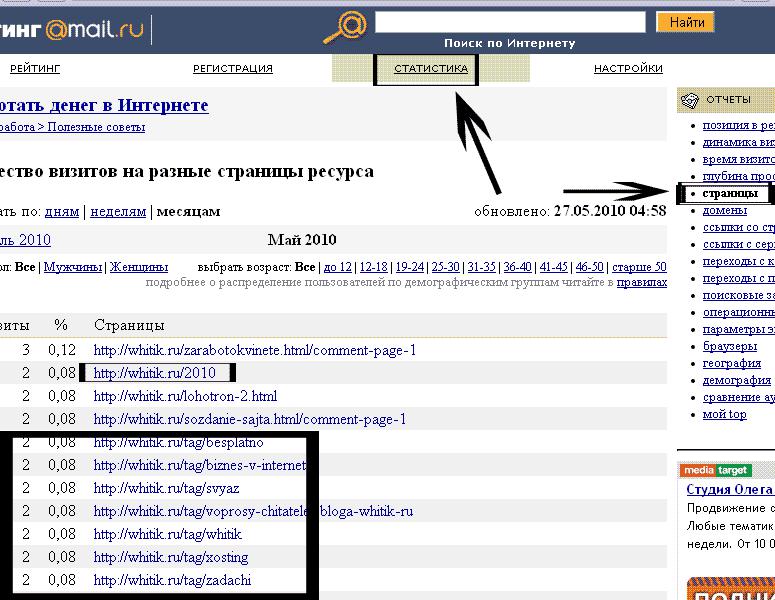

Здесь же Вы “засовываете” разделы, которые НЕ нужно индексировать поисковикам. К примеру, на странице https://wpnew.ru/tag/seo у меня идет дубль статей (повторение) с обычными статьями, а дублирование страниц отрицательно сказывается на поисковом продвижении, поэтому, крайне желательно, данные секторы нужно закрыть от индексации, что мы и делаем с помощью этого правила:

К примеру, на странице https://wpnew.ru/tag/seo у меня идет дубль статей (повторение) с обычными статьями, а дублирование страниц отрицательно сказывается на поисковом продвижении, поэтому, крайне желательно, данные секторы нужно закрыть от индексации, что мы и делаем с помощью этого правила:

Disallow: /tag

Так вот, в том robots.txt, который дан выше, от индексации закрыты почти все ненужные разделы сайта на WordPress, то есть просто оставьте все как есть.

Host

Здесь мы задаем главное зеркало сайта, о котором я рассказывал чуть выше.

Sitemap

В последних двух строчках мы задаем адрес до двух карт сайта, созданные с помощью плагина Google XML Sitemaps.

Возможные проблемы

Если у Вас на блоге не стоит ЧПУ (именно так у меня происходит с тем сайтом, которого я занимаюсь продвижением), то с тем robots.txt, который дан выше, могут быть проблемы. Напомню, что без ЧПУ ссылки на сайте на посты выглядят примерно следующим образом:

А вот из-за этой строчки в robots. txt, у меня перестали индексироваться посты сайта:

txt, у меня перестали индексироваться посты сайта:

Disallow: /*?*

Как видите, эта самая строка в robots.txt запрещает индексирование статей, что естественно нам нисколько не нужно. Чтобы исправить это, просто нужно удалить эти 2 строчки (в правилах для всех поисковиков и для Яндекса) и окончательный правильный robots.txt для WordPress сайта без ЧПУ будет выглядеть следующим образом:

User-agent: *

Disallow: /cgi-bin

Disallow: /wp-admin

Disallow: /wp-includes

Disallow: /wp-content/plugins

Disallow: /wp-content/cache

Disallow: /wp-content/themes

Disallow: /trackback

Disallow: */trackback

Disallow: */*/trackback

Disallow: */*/feed/*/

Disallow: */feed

Disallow: /tag

User-agent: Yandex

Disallow: /cgi-bin

Disallow: /wp-admin

Disallow: /wp-includes

Disallow: /wp-content/plugins

Disallow: /wp-content/cache

Disallow: /wp-content/themes

Disallow: /trackback

Disallow: */trackback

Disallow: */*/trackback

Disallow: */*/feed/*/

Disallow: */feed

Disallow: /tag

Host: wpnew. ru

ru

Sitemap: https://wpnew.ru/sitemap.xml.gz

Sitemap: https://wpnew.ru/sitemap.xml

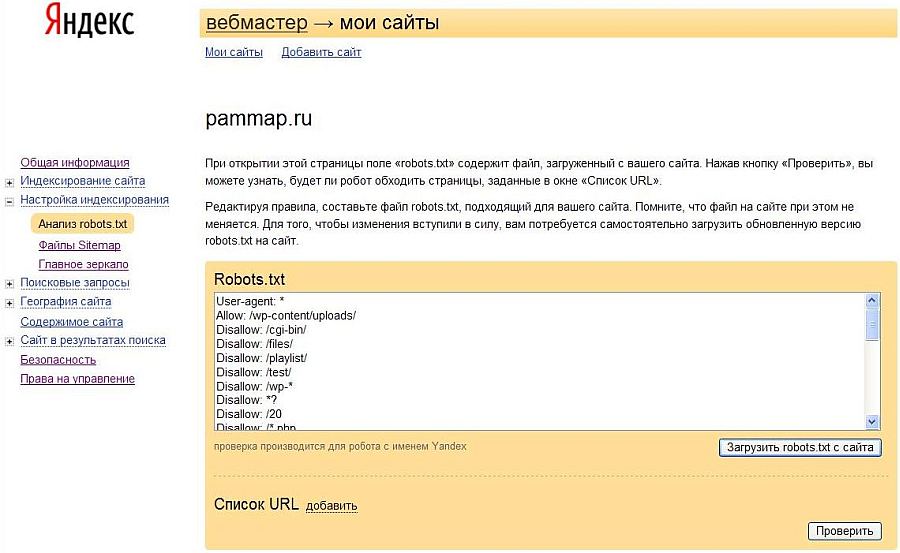

Анализ robots.txt

Чтобы проверить, правильно ли мы составили файл robots.txt я рекомендую Вам воспользоваться сервисом Яндекс Вебмастер (как регистрироваться в данном сервисе я рассказывал тут).

Заходим в раздел Настройки индексирования –> Анализ robots.txt:

Уже там нажимаете на кнопку “Загрузить robots.txt с сайта”, а затем нажимаете на кнопку “Проверить”:

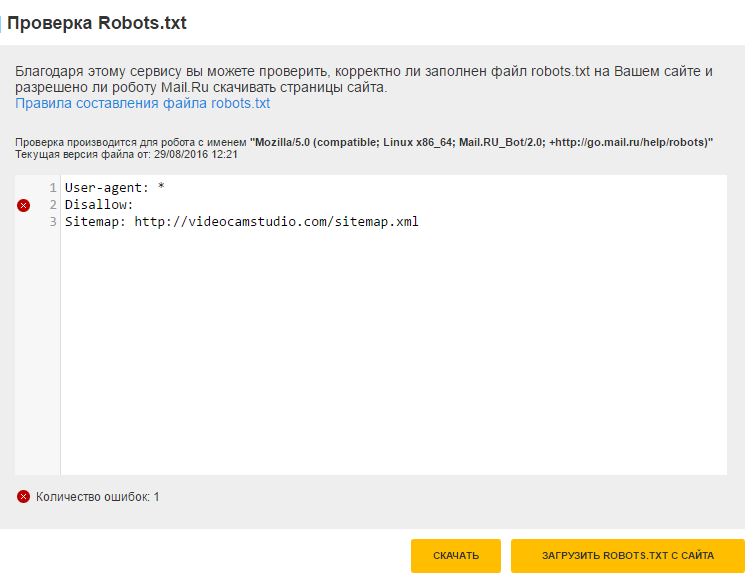

Если Вы увидите примерно следующее сообщение, значит у Вас правильный robots.txt для Яндекса:

Также Вы можете в “Список URL” добавить адрес любой статьи сайта, чтобы проверить не запрещает ли robots.txt индексирование данной страницы:

Как видите, никакого запрета на индексирование страницы со стороны robots.txt мы не видим, значит все в порядке :).

Надеюсь больше вопросов, типа: как составить robots.txt или как сделать правильным данный файл у Вас не возникнет. В этом уроке я постарался показать Вам правильный пример robots.txt:

В этом уроке я постарался показать Вам правильный пример robots.txt:

Вы можете посмотреть другие варианты, как еще можно составлять robots.txt.

До скорой встречи!

P.s. Совсем недавно я добавил блог в Яндекс Каталог, что же интересного произошло? 🙂

Что такое файл robots.txt? – iSEO

Файл robots.txt («роботс тэ-экс-тэ») – текстовый файл, который представляет собой основной способ управления сканированием и индексацией сайта поисковыми системами. Размещается строго в корневой папке сайта. Имя файла должно быть прописано в нижнем регистре.

Зачем нужен robots.txt?

Поисковый робот, попадая на сайт обращается к файлу robots.txt, чтобы получить информацию о том, какие разделы и страницы сайта нужно игнорировать, а также информацию о расположении XML-карты сайта и другие параметры.

Данный файл позволяет убрать из поиска дубли страниц и служебные страницы, на которые не должны попадать посетители из поисковых систем. Помогает улучшить позиции сайта в поиске и комфортность для посетителей в использовании сайта.

Помогает улучшить позиции сайта в поиске и комфортность для посетителей в использовании сайта.

Для создания robots.txt достаточно воспользоваться любым текстовым редактором. Его необходимо заполнить в соответствии с определенными правилами (о них расскажем далее) и загрузить в корневой каталог сайта.

Если файла robots.txt на сайте нет или он пустой – поисковые системы могут пытаться сканировать и индексировать весь сайт.

Основные директивы в robots.txt

Комментарии

В файле robots.txt можно оставлять комментарии – они будут игнорироваться поисковыми системами. Комментарии помогают структурировать файл, указывать какие-то важные пометки и т. п. Строка с комментарием должна начинаться с символа решетки – #.

Пример:

# Это комментарий

User-agent

Указывает для какого робота предназначены следующие за ней инструкции. Файл robots.txt может состоять из нескольких блоков инструкций, каждая из которых предназначена для определенной поисковой системы.

Наименования роботов для User-agent можно найти, например, в справке поисковых систем. В Рунете чаще всего используются три:

- * – указывает, что следующие инструкции предназначены для всех роботов. Если робот не найдет в файле robots.txt секции конкретно для него, то будет учитывать эту секцию.

- Yandex – робот Яндекса.

- Googlebot – робот Google.

Примеры:

# Секция для всех роботов, которая разрешает индексировать весь сайт User-agent: * Disallow: # Секция для Google, которая запрещает индексировать папку /secret/ User-agent: Googlebot Disallow: /secret/

Disallow и Allow

Основные директивы, которые указывают, что можно и что нельзя индексировать:

- Disallow – запрещает индексацию

- Allow – разрешает

Поскольку, изначальная стандартная функция robots. txt это именно запрещать индексацию, то чаще используются директивы Disallow. Директива Allow появилась позднее и её могут поддерживать не все поисковые системы. Но Яндекс и Google – поддерживают.

txt это именно запрещать индексацию, то чаще используются директивы Disallow. Директива Allow появилась позднее и её могут поддерживать не все поисковые системы. Но Яндекс и Google – поддерживают.

Директива Allow применяется если вам нужно разрешить к индексированию что-то, что было запрещено директивами Disallow. Например, если какая-то папка запрещена к индексированию, но определенный файл/страницу в ней нужно разрешить.

В каждой из директив указывается префикс URL (т. е. начало адреса страницы), для которого должно применяться это правило. Также есть специальные символы:

- * – любая последовательность символов (в том числе, пустая). В конце инструкций ставить этот символ не нужно, т. к. по умолчанию директивы интерпретируются так, что как будто он там уже есть.

- $ – конец строки. Отменяет подразумеваемый символ * на конце строки.

Если в файле используются одновременно директивы Allow и Disallow, то приоритет будет иметь та, префикс URL у которой длиннее. Правила применяются по возрастанию длины префикса.

Правила применяются по возрастанию длины префикса.

Пример:

# Секция для Яндекса, которая запрещает индексировать папку /secret/ # но разрешает индексировать страницу /secret/not-really/ # при этом не разрешает индексировать всё остальное в папке /secret/not-really/ User-agent: Yandex Disallow: /secret/ Allow: /secret/not-really/$ # Секция для всех роботов, которая запрещает индексировать весь сайт User-agent: * Disallow: / # Секция для Google, которому можно индексировать только страницы с параметрами в URL User-agent: Googlebot Disallow: / Allow: /*?*=

Clean-param

Директива, которую поддерживает Яндекс. Используется для указания параметров в URL, которые следует игнорировать (т. е. считать страницы с такими параметрами одной и той же страницей).

Синтаксис:

Clean-param: param1[¶m2¶m3&..¶mN] [path]

Где param1…paramN это список параметров, разделенных символом &, а [path] это опциональный префикс URL для которого нужно применять это правило (по аналогии с Allow/Disallow).

Директив может быть несколько. Длина правила – не более 500 символов.

Пример:

# Разрешить Яндексу индексировать всё # кроме страниц с параметром session_id в папке /catalog/ User-agent: Yandex Disallow: Clean-param: session_id /catalog/

Sitemap

Указывает на расположение XML-карт сайта. Таких директив может быть несколько.

Директива Sitemap является межсекционной – не важно в каком блоке User-agent или месте файла она будет указана. Все роботы будут учитывать все директивы Sitemap в вашем файле robots.txt.

Пример:

Sitemap: https://www.site.ru/sitemap_index.xml

Host

Межсекционная директива для указания основного хоста. Раньше поддерживалась Яндексом. Теперь поддерживается только роботом поиска Mail.ru. Ее наличие в файле не является какой-то ошибкой, но и пользы от нее немного, т. к. доля органического трафика с поиска Mail.ru обычно очень низкая (порядка 1%).

Пример:

Host: https://www.site.ru

Crawl-delay

Устаревшая директива, которая использовалась для указания задержки между обращениями робота к сайту. Теперь управлять нагрузкой робота на сайте можно в Яндекс Вебмастере и Google Search Console. Директиву Crawl-delay не поддерживает ни Яндекс, ни Google.

Что еще важно знать про robots.txt

- Регистр букв имеет значение.

- Кириллица – не поддерживается. Как она не поддерживается в URL и в названиях доменов. В файле robots.txt кириллические папки/файлы и названия доменов должны быть указаны в закодированном виде.

- Google считает, что файл robots.txt управляет сканированием, а не индексацией. На практике это значит, что если какие-то страницы сайта Google уже нашел и проиндексировал (например, на них были ссылки с других сайтов), то запрет их индексации в robots.

txt не поможет исключить их из индекса. Для этого нужно применять метатег robots на самой странице. При этом, чтобы Google это тег увидел и учёл – страница не должна быть закрыта в robots.txt. Звучит это довольно абсурдно, но работает именно так, к сожалению.

txt не поможет исключить их из индекса. Для этого нужно применять метатег robots на самой странице. При этом, чтобы Google это тег увидел и учёл – страница не должна быть закрыта в robots.txt. Звучит это довольно абсурдно, но работает именно так, к сожалению. - Прежде чем залить файл на «боевой» домен – проверьте его правильность с помощью соответствующих инструментов в Яндекс Вебмастере и Google Search Console.

Подробнее о файле robots.txt в справке поисковых систем:

- https://yandex.ru/support/webmaster/controlling-robot/robots-txt.html

- https://developers.google.com/search/docs/advanced/robots/intro?hl=ru

настройки сканирования без бубна — SEO на vc.ru

Как показывает практика, база технического SEO – файл robots.txt, – многими вебмастерами не только заполняется неправильно, но и без понимания, зачем этот файл и как он работает. Статей на эту тему – объективно, тонны, но есть смысл расставить некоторые акценты.

3376 просмотров

Для чего вообще нужен robots.txt

В интернете можно найти много глупых советов по настройкам robots.txt. Люди советуют управлять с его помощью доступами, предлагают какие-то типовые шаблонные списки инструкций, пытаются что-то удалять таким образом из индекса.

robots.txt предназначен для единственной цели: управлять сканированием сайта на базе «Стандарта исключений для роботов». Это не инструмент для управления индексацией, и если вы попытаетесь управлять с его помощью попаданием ваших страниц в индекс, неизбежно получите ошибки и проблемы. И чем больше и сложнее ваш сайт – тем больше будет ошибок. Для управления индексацией используйте предназначенные для этого инструменты:

С его помощью можно указать поисковым роботам, какие URL не должны сканироваться, а какие сканировать можно и нужно. Это не команды: поисковые роботы могут проигнорировать запрещающие и разрешающие директивы, если получат более весомые сигналы это сделать. Простой пример: если на страницу ведёт достаточное количество ссылок, она появится в выдаче – хотя саму страницу поисковик скачивать и не будет.

Простой пример: если на страницу ведёт достаточное количество ссылок, она появится в выдаче – хотя саму страницу поисковик скачивать и не будет.

Важно понимать: robots.txt – не закон для роботов, а просто список пожеланий с достаточно противоречивой историей. Несмотря на необязательность директив, например, гуглобот не станет сканировать ваш сайт, если сервер ответит технической ошибкой на запрос «роботс». И вместе с тем, легко проигнорирует запреты, если получит сигналы о важности какого-то URL в рамках сайта (наличие ссылок, настройка перенаправлений, постоянный пользовательский трафик и т.п.).

Что не нужно сканировать

Системные папки на сервере

Дубли: сортировки, UTM-метки, фильтры и прочие URL с параметрами

- Страницы пользовательских сессий, результаты поиска по сайту, динамические URL

- Служебные URL

- Административная часть сайта

К чему должен быть обязательный доступ

Посадочные страницы

- Служебные файлы, отвечающие за рендеринг страницы (js, css, шрифты, графика)

Особое внимание обращу на обязательное наличие разрешений на сканирование JS и CSS. Если поисковые системы не смогут отрисовать страницы сайта в том виде, в каком их получает посетитель-человек, это приведёт к следующим проблемам:

Если поисковые системы не смогут отрисовать страницы сайта в том виде, в каком их получает посетитель-человек, это приведёт к следующим проблемам:

Зачем нужны отдельные секции для поисковых роботов

Оставлять единый блок директив для всех поисковых роботов – плохая идея, и вот почему.

Поисковые роботы Яндекса и Гугла в ряде случаев совершенно по-разному воспринимают директивы, потому и что и правила сканирования у них разные. Вот лишь несколько главных отличий.

Яндекс плохо работает с метатегами robots и каноническими адресами. Директивы в robots.txt для него важнее. Если вы разрешите ему сканировать то, что не должно попасть в индекс, он с большой степенью вероятности проигнорирует всё остальное, и может начать ранжировать вовсе не то, что вам надо. Скажем, нецелевую страницу пагинации — просто потому, что ему что-то не понравилось на целевой странице.

- Яндекс использует директивы, которые не признаёт Google, например, Clean-param.

Есть и директивы, которые понимает только гуглобот.

Есть и директивы, которые понимает только гуглобот. - Хорошая идея — минимально блокировать сканирование для гуглобота, индексацией управляя только на уровне страницы. Таким образом Гугл будет лучше понимать ваш сайт, а алгоритмы там достаточно умные, чтобы и без вашего участия разобраться, что к чему. Если же по логам вы отмечаете ненормальную активность гуглобота там, где не надо – это повод подумать, что не так с сайтом.

- Если гуглобот зайдёт на сайт и не сможет скачать robots.txt, он уйдёт. Яндекс-бот в такой придирчивости не замечен.

Общий принцип: открывайте для Яндекса по необходимости. Для Гугл – по необходимости закрывайте.

Для Яндекса вы должны понимать, что у вас должно быть в индексе. Для Гугл – наоборот, чего в индексе быть не должно.

Активность Яндекс-бота в рунете кратно превышает активность гуглобота, которая в принципе лимитирована. Это ещё одно условие, которое надо учитывать при составлении директив для robots.txt.

Это ещё одно условие, которое надо учитывать при составлении директив для robots.txt.

Можно ли блокировать на уровне robots.txt зловредных ботов и парсеры

Каждый сайт посещает множество роботов, и не все они вам нужны. Это могут быть роботы-парсеры, которые используют ваши конкуренты для извлечения информации, многочисленные SEO-сервисы, которые могут предоставлять информацию о вашем сайте конкурентам и т.п. Пользы для сайта от них нет, а нагрузку на сервер они создают. Стоит ли пытаться запрещать им сканирование в robots.txt?

Нет. Набор инструкций на базе стандарта исключений имеет рекомендательный характер, и фактически ограничить ничего не может. Если вы хотите заблокировать посторонних роботов – делать это надо на уровне сервера. Чаще всего в robots.txt пытаются заблокировать самых известных официальных ботов типа AhrefsBot, MJ12bot, Slurp, SMTBot, SemrushBot, DotBot, BLEXBot и т.п. Смысла это не имеет, но вы можете попробовать.

Что будет, если robots. txt не заполнен или заполнен неправильно

txt не заполнен или заполнен неправильно

Недоступность файла с директивами по техническим причинам (ошибки 5**) может привести к тому, что гуглобот не станет сканировать сайт. Отсутствие же файла приведет к тому, что роботы будут обходить всё подряд и накидают в индекс тонны мусора. Чаще всего это не очень страшно. А вот ошибки в директивах могут привести к достаточно широкому спектру проблем. Вот типовые:

Поисковая система не сможет отрисовать адаптивную вёрстку вашего сайта, потому что не может получить доступ к файлам шаблона, и решит, что сайт не подходит для просмотра на смартфонах.

- Часть контента или оформления не будет просканирована или учтена, если выводится она средствами JS, а доступ к ним заблокирован.

- Если в robots.txt запрещено сканирование страниц, которые вы хотели бы удалить из индекса, деиндексированы они не будут – робот просто не увидит ваших указаний в рамках страницы, а в панели вебмастеров вы увидите соответствующее уведомление («Проиндексировано, несмотря на блокировку в файле robots.

txt»).

txt»). - Без запрета на сканирование определенных страниц (пользовательских, с параметрами) поисковая система будет вносить в индекс явный мусор, который через время будет выбрасывать. В случае Яндекса это может быть чревато переклейкой запросов на нецелевые страницы, рост страниц, рассматриваемых как некачественные, и как следствие – снижения доверия к сайту на уровне хоста.

Ошибки в настройках сканирования – и вот уже поисковому роботу недоступен целый блок, куда выводится портфолио веб-студии.

Простенькие сайты на той же «Тильде» чаще всего вообще не нуждаются в правках robots.txt – там разрешено всё, и нет никаких проблем ни с отрисовкой сайта, ни с попаданием в индекс поискового мусора. Интерпретаторы современных ПС довольно снисходительно относятся к возможным ошибкам, однако надеяться на это не стоит.

Основные правила

Заполнение файла директив должно соответствовать правилам, игнорирование которых может привести к критическим ошибкам сканирования и непредсказуемым багам обхода сайта. Перечислим основные.

Перечислим основные.

Файл может называться только «robots.txt» с названием в нижнем регистре, быть в кодировке UTF-8 без BOM, и находиться в корне сайта.

- Никакой кириллицы в robots.txt быть не должно! Если вы используете домен в зоне РФ или кириллические адреса – для настроек robots.txt используйте конвертацию таких URL в пуникод. Например, директива Sitemap в данном случае будет выглядеть примерно так:

Sitemap: http://xn--80aswg.xn--p1ai/sitemap.xml - Каждая новая директива начинается с новой строки.

- Блок директив для каждого User-agent отделяется от других блоков пустой строкой. Пустая строка между директивами обрывает список, после пустой строки начинается новый блок.

- Все запрещающие или разрешающие директивы относятся только к боту, указанному для заданного блока.

- Порядок размещения разрешающих и запрещающих директив особого значения не имеет.

В настоящий момент это свойственно и роботам Яндекса, и Google.

В настоящий момент это свойственно и роботам Яндекса, и Google.

Регулярные выражения и подстановочные знаки

Регулярные выражения и подстановочные знаки значительно упрощают процесс настройки сканирования. Официально они не поддерживаются стандартами, и тем не менее, понимают их все роботы. Ваша задача – составить регулярное выражение, блокирующее сканирование всего поискового мусора и разрешить необходимые URL, а не вносить туда десятки и даже сотни URL (как иногда пытаются делать). Отдельные URL, ненужные в выдаче по каким-то причинам, нужно просто запрещать индексировать метатегом.

Пример заполнения robots.txt в стиле «Знай наших» школы SEO-кунгфу «Раззудись плечо» — и это ещё не весь список

Для формирования регулярных выражений в рамках «роботс» используется всего два знака: * и $.

Знак * означает любую последовательность символов, «что угодно». Примеры.

User-agent: * Disallow: /*?

Это означает, что для любого робота (если для него нет отдельного набора директив) запрещено сканирование любых страниц фильтров.

User-agent: * Allow: */*.jpg*

Разрешено сканирование файлов JPG с любым названием в любой доступной папке сайта, включая кэшированные файлы.

Знак $ соответствует концу заданного URL. Те URL, что содержат какие-то знаки после знака $, могут быть просканированы. Пример:

User-agent: * Disallow: */*.pdf$

Эта директива запрещает сканировать любой файл в формате PDF в рамках сайта. Ещё один пример:

Disallow: */ofis$

Будет заблокирован URL https://сайт-ру/catalog/muzhchinam/ofis

Но URL https://сайт-ру/catalog/muzhchinam/ofis?sort=rate&page=1 будет доступен.

Как составить правильный robots.txt для своего сайта

Как уже было сказано выше, гуглобот не станет сканировать сайт, если не найдёт robots.txt, поэтому для начала можно использовать даже шаблонный «роботс» (как многие и поступают). Однако это явно не оптимальный вариант.

Чтобы составить правильный robots.txt для своего сайта, вы должны чётко понимать два момента:

На первый вопрос вам поможет ответить семантическое ядро и структура сайта, созданная на его основе. Мы не будем разбирать здесь вопросы структурирования.

Мы не будем разбирать здесь вопросы структурирования.

На второй же вопрос вам поможет ответить парсер сайта, способный эмулировать заданных поисковых роботов, показать наглядно, как поисковых робот отрисовывает страницу по актуальным правилам, справляется ли он с рендерингом адаптивной версии сайта и т.п. С этой целью я использую Screaming Frog SEO Spider. Думаю, эти возможности есть и у его конкурентов.

Полноценный рендеринг сайта позволит вам увидеть его глазами поискового робота

Можно начинать парсинг. По окончании запустите Crawl Analysis, и можно приступать к изучению результатов.

Поскольку нас в данном случае интересует список проблем с файлом robots.txt начнём с вкладки Rendered Page — там можно посмотреть, как видит робот выбранную страницу.

Если всё совсем плохо, вы увидите тлен и безнадёжность: отсутствие внятной вёрстки, пустые блоки, абсолютно нечитабельный контент.

Как вариант – контент может быть в основном доступен, просто без ожидаемого дизайна, дырками на месте картинок и т. п. Здесь же можно сразу посмотреть, что именно заблокировано и мешает роботу увидеть сайт так, как видите его вы. Если в списке заблокированных ресурсов вы видите js, css, файлы изображений, веб-шрифты – вносите их в список разрешающих директив.

п. Здесь же можно сразу посмотреть, что именно заблокировано и мешает роботу увидеть сайт так, как видите его вы. Если в списке заблокированных ресурсов вы видите js, css, файлы изображений, веб-шрифты – вносите их в список разрешающих директив.

В левом окне мы видим заблокированные папки, содержащие файлы шаблона. Их отсутствие приводит к тому, что робот видит сайт так, как показано в правом окне.

Внимательно изучите все страницы, которые так или иначе помечены как дубли – по тайтлам, по сходству контента и т.п. Вероятно, среди них действительно могут оказаться дубли и поисковый мусор. Дубли могут быть как чисто техническими (например, товары могут выводиться плиткой, а могут списком), а могут быть и качественными, когда полезного контента на странице недостаточно, и она похожа на другие страницы, такие же некачественные с точки зрения ПС. В данном случае вам предстоит решить, что делать: закрыть мусор от сканирования, запретить индексацию метатегом, или оперативно внести правки и отправить URL на переобход.

На следующем шаге вам предстоит изучить данные из панелей вебмастеров. Достаточно удобно и наглядно это реализовано в Яндекс-Вебмастере. Заходим в «Индексирование», «Страницы в поиске», вкладка «Исключенные» – и внимательно оцениваем URL, помеченные как неканонические, дубли, а также МПК. Среди них, как правило, большую часть представляют страницы сортировок, фильтров, пагинации и т.п. Их чаще всего можно смело вносить в список для запрета на сканирование.

Инструменты для тестирования

Любые внесенные правки должны проверяться с помощью соответствующих инструментов поисковых систем.

В Гугл – https://www.google.com/webmasters/tools/robots-testing-tool

В Яндексе – https://webmaster.yandex.ru/tools/robotstxt/

Принцип действия прост: вы видите актуальную кэшированную версию файла, анализатор, инструмент проверки заданных URL. Если URL заблокирован – вы увидите строку, которая его блокирует.

Заключение

Подытожим основные тезисы.

UPD. Для настроек индексирования сайта рекомендую использовать метатег Robots, HTTP-заголовок X-Robots-Tag, настройки тега Canonical, а также вполне традиционные средства – редиректы, sitemap.xml и т.п.

Файл robots.txt для сайта в 2022: пошаговая инструкция

Файл robots.txt — это текстовый файл, в котором содержаться инструкции для поисковых роботов, в частности каким роботам и какие страницы допускается сканировать, а какие нет. В данной статье рассмотрим, где можно найти robots.txt, как его редактировать и какие правила по его использовать в SEO-продвижении.

- Где найти;

- Как создать;

- Инструкция по работе;

- Синтаксис;

- Директивы;

- Как проверить.

Где можно найти файл robots.txt и как его создать или редактировать

Чтобы проверить файл robots.txt сайта, следует добавить к домену «/robots.txt», примеры:

https://seopulses.ru/robots.txt

https://serpstat..png) com/robots.txt

com/robots.txt

https://netpeak.net/robots.txt

Как создать и редактировать robots.txt

Вручную

Данный файл всегда можно найти, подключившись к FTP сайта или в файлом редакторе хостинг-провайдера в корневой папке сайта (как правило, public_html):

Далее открываем сам файл и можно его редактировать.

Если его нет, то достаточно создать новый файл.

После вводим название документа и сохраняем.

Через модули/дополнения/плагины

Чтобы управлять данный файлом прямо в административной панели сайта следует установить дополнительный модуль:

- Для 1С-Битрикс;

https://dev.1c-bitrix.ru/learning/course/?COURSE_ID=139&LESSON_ID=5814

- WordPress;

Virtual Robots.txt

- Для Opencart;

https://opencartforum.com/files/file/5141-edit-robotstxt/

- Webasyst.

https://support.webasyst.ru/shop-script/149/shop-script-robots-txt/

Инструкция по работе с robots.

txt

txtВ первую очередь записывается User-Agent, указывая на то, к какому роботу идет обращение, например:

- User-agent: Yandex — для обращения к поисковому роботу Яндекса;

- User-agent: Googlebot — в случае с краулером Google;

- User-agent: YandexImages — при работе с ботом Яндекс.Картинок.

Полный список роботов Яндекс:

https://yandex.ru/support/webmaster/robot-workings/check-yandex-robots.html#check-yandex-robots

И Google:

https://support.google.com/webmasters/answer/1061943?hl=ru

Синтаксис в robots.txt

- # — отвечает за комментирование;

- * — указывает на любую последовательность символов после этого знака. По умолчанию указывается при любого правила в файле;

- $ — отменяет действие *, указывая на то что на этом элементе необходимо остановиться.

Директивы в Robots.txt

Disallow

Disallow запрещает индексацию отдельной страницы или группы (в том числе всего сайта). Чаще всего используется для того, чтобы скрыть технические страницы, динамические или временные страницы.

Пример #1

# Полностью закрывает весь сайт от индексации

User-agent: *

Disallow: /

Пример #2

# Блокирует для скачивания все страницы раздела /category1/, например, /category1/page1/ или caterogy1/page2/

Disallow: /category1/

Пример #3

# Блокирует для скачивания страницу раздела /category2/

User-agent: *

Disallow: /category1/$

Пример #4

# Дает возможность сканировать весь сайт просто оставив поле пустым

User-agent: *

Disallow:

Важно! Следует понимать, что регистр при использовании правил имеет значение, например, Disallow: /Category1/ не запрещает посещение страницы /category1/.

Allow

Директива Allow указывает на то, что роботу можно сканировать содержимое страницы/раздела, как правило, используется, когда в полностью закрытом разделе, нужно дать доступ к определенному документу.

Пример #1

# Дает возможность роботу скачать файл site.ru//feed/turbo/ несмотря на то, что скрыт раздел site. ru/feed/.

ru/feed/.

Disallow: */feed/*

Allow: /feed/turbo/

Пример #2

# разрешает скачивание файла doc.xml

# разрешает скачивание файла doc.xml

Allow: /doc.xml

Sitemap

Директива Sitemap указывает на карту сайта, которая используется в SEO для вывода списка URL, которые нужно проиндексировать в первую очередь.

Важно понимать, что в отличие от стандартных директив у нее есть особенности в записи:

- Следует указывать полный URL, когда относительный адрес использовать запрещено;

- На нее не распространяются остальные правила в файле robots.txt;

- XML-карта сайта должна иметь в URL-адресе домен сайта.

Пример

# Указывает карту сайта

Sitemap: https://serpstat.com/sitemap.xml

Clean-param

Используется когда нужно указать Яндексу (в Google она не работает), что страница с GET-параметрами (например, site.ru?param1=2¶m2=3) и метками (в том числе utm) не влияющие на содержимое сайта, не должна быть проиндексирована.

Пример #1

#для адресов вида:

www.example1.com/forum/showthread.php?s=681498b9648949605&t=8243

www.example1.com/forum/showthread.php?s=1e71c4427317a117a&t=8243

#robots.txt будет содержать:

User-agent: Yandex

Disallow:

Clean-param: s /forum/showthread.php

Пример #2

#для адресов вида:

www.example2.com/index.php?page=1&sid=2564126ebdec301c607e5df

www.example2.com/index.php?page=1&sid=974017dcd170d6c4a5d76ae

#robots.txt будет содержать:

User-agent: Yandex

Disallow:

Clean-param: sid /index.php

Подробнее о данной директиве можно прочитать здесь:

https://serpstat.com/ru/blog/obrabotka-get-parametrov-v-robotstxt-s-pomoshhju-direktivy-clean-param/

Crawl-delay

Важно! Данная директива не поддерживается в Яндексе с 22 февраля 2019 года и в Google 1 сентября 2019 года, но работает с другими роботами. Настройки скорости скачивания можно найти в Яндекс. Вебмастер и Google Search Console.

Вебмастер и Google Search Console.

Crawl-delay указывает временной интервал в секундах, в течение которого роботу разрешается делать только 1 сканирование. Как правило, необходима лишь в случаях, когда у сайта наблюдается большая нагрузка из-за сканирования.

Пример

# Допускает скачивание страницы лишь раз в 3 секунды

Crawl-delay: 3

Как проверить работу файла robots.txt

В Яндекс.Вебмастер

В Яндекс.Вебмастер в разделе «Инструменты→ Анализ robots.txt» можно увидеть используемый поисковиком свод правил и наличие ошибок в нем.

Также можно скачать другие версии файла или просто ознакомиться с ними.

Чуть ниже имеется инструмент, который дает возможно проверить сразу до 100 URL на возможность сканирования.

В нашем случае мы проверяем эти правила.

Как видим из примера все работает нормально.

Также если воспользоваться сервисом «Проверка ответа сервера» от Яндекса также будет указано, запрещен ли для сканирования документ при попытке обратиться к нему.

В Google Search Console

В случае с Google можно воспользоваться инструментом проверки Robots.txt, где потребуется в первую очередь выбрать нужный сайт.

Важно! Ресурсы-домены в этом случае выбирать нельзя.

Теперь мы видим:

- Сам файл;

- Кнопку, открывающую его;

- Симулятор для проверки сканирования.

Если в симуляторе ввести заблокированный URL, то можно увидеть правило, запрещающее сделать это и уведомление «Недоступен».

Однако, если ввести заблокированный URL в страницу поиска в новой Google Search Console (или запросить ее индексирование), то можно увидеть, что страница заблокирована в файле robots.txt.

Зачем вам нужен robots.txt

Почти в каждом материале по разработке и продвижению мы упоминаем robots.txt. Сегодня не будем упоминать, а всю статью будем рассказывать про него, про правильный robots. txt в 2021 году.

txt в 2021 году.

Вот так выглядит robots.txt Google. Примерно так же выглядит и robots.txt вашего сайта. По сути, это текстовый файл со списком исключений для поисковых роботов. Исключения запрещают индексировать одни разделы сайта и разрешают другие. Это необходимо, чтобы защитить конфиденциальную информацию, административные файлы или страницы, которые в силу требований SEO не должны попасть в поиск.

Инструкции

Поисковые роботы законопослушны. Они четко следуют инструкциям robots.txt и сканируют только те ссылки, которые разрешены. Инструкции в файле называются директивами, и в дальнейшем мы будем употреблять именно этот термин.

Директива User-agent для разграничения команд

Все robots.txt начинаются с user-agent. Это своеобразный маршрутизатор, который определяет адресата последующих команд. К ботам Яндекса и Гугла user-agent обращается по-разному — User-agent:Yandex и User-agent:GoogleBot, соответственно. User-agent из файла Google начинается с символа * и это значит, что дальнейшие команды относятся ко всем поисковым ботам.

User-agent из файла Google начинается с символа * и это значит, что дальнейшие команды относятся ко всем поисковым ботам.

Сразу отвечаем на закономерно возникающий вопрос: «Зачем указывать отдельные директивы для Яндекса и Гугла, если можно сделать универсальный список?». Поисковых ботов несколько. У одного только Гугла их семь: анализатор рекламы на десктопах и мобильных, индексатор картинок и видео, новостной сканер, бот по оценке рекламы для приложений на Android. Подставляя в user-agent имя нужного бота, можно определить список директив именно для него. Например, запретить индексацию картинок. Плюс у поисковых ботов разный подход к сканированию. Так, команду clean-param воспринимает только Яндекс и бесполезно указывать ее в блоке указаний для Гугла — не поймет.

Для больших сайтов с разными стратегиями продвижения имеет смысл прописывать директивы под конкретных ботов. Маленьким несложным ресурсам мы обычно рекомендует обращаться сразу ко всем индексаторам и использовать User-agent с символом *.

Директива disallow

Disallow — команда запрета. Она запрещает индексировать отдельные файлы, страницы или целые разделы. Обычно, disallow закрывают страницу входа в панель администрирования, документы PDF, DOC, XLS, формы регистрации, корзины, страницы с персональными данными клиентов и пр.

В robots.txt для Bitrix, например, disallow выглядит так:

User-agent: *

Disallow: /wp-admin/

Это в случае, когда мы закрываем доступ к панели управления.

Или так:

User-agent: *

Disallow: /images/

Такая комбинация запретит боту индексировать иллюстрации.

В структуре команды символ / обозначает, что нужно закрыть от индексации, а знак * боты понимают как «любой текст».

Важно! Disallow закрывает доступ поисковым роботам, но не людям, поэтому конфиденциальную информацию на сайте рекомендуем обязательно защищать аутентификацией.

Директивы allow и sitemap

Allow разрешает все, что не запрещает disallow. Это может показаться странным, ведь бот и без того может индексировать все, что не закрыто от сканирования. На самом деле allow нужна для выборочной индексации файлов или документов в закрытом разделе. Допустим, у вас есть закрытый с помощью disallow раздел для дистрибьюторов:

User-agent: *

Disallow: /distributoram/

Он будет выглядеть так, когда вы полностью закрываете индексацию раздела. Но допустим, в закрытом каталоге есть страница или файл, который имеет смысл показать пользователям. Вот тут на сцену выходит allow. Получается так:

Получается так:

User-agent: *

Disallow: /distributoram/

Allow: /distributoram/usloviya.html

При такой расстановке боты поймут, что из всего раздела distributoram они могут сканировать только контент страницы usloviya.html.

Sitemap одновременно и карта сайта, и директива. Про карту сайта в другой раз, а в роли директивы sitemap используется во всех случаях, когда вы хотите направить роботов на определенные разделы сайта.

Директиву sitemap поисковые боты воспринимают как указатель на приоритетные разделы, но если Яндекс понимает ее как рекомендацию, то GoogleBot как обязательное требование. Само собой, используя в robots.txt команду sitemap, саму карту в корневом каталоге необходимо поддерживать в актуальном состоянии.

Создаем и проверяем robots.txt

Для создания файла подойдет любой текстовый редактор, тот же «Блокнот». На первое место ставим адресную директиву user-agent, потом блоками вносим disallow и allow. Примеры и руководства есть у обоих поисковиков. У Яндекса в разделе «Помощь вебмастеру». У Google в Центре Google Поиска.

На первое место ставим адресную директиву user-agent, потом блоками вносим disallow и allow. Примеры и руководства есть у обоих поисковиков. У Яндекса в разделе «Помощь вебмастеру». У Google в Центре Google Поиска.

Чтобы прописать robots.txt на сайте, файл сохраняем в текстовом формате и загружаем в корень. После загрузки проверьте правильность установки — robots.txt должен открываться по адресу вашсайт/robots.txt. Для проверки работоспособности вставьте ссылку на сайт и код файла в специальные поля сервиса https://webmaster.yandex.ru/tools/robotstxt/ Яндекса и выберите подтвержденный ресурс в https://www.google.com/webmasters/tools/robots-testing-tool в Google.

Зачем проверять robots.txt

В случае с robots ошибки проводят к выпадению из индекса одного раздела и попаданию в выдачу другого, совершенно лишнего и абсолютно ненужного. Кроме того, поисковые системы регулярно меняют правила индексации и добавляют/убирают отдельные директивы. Так, с 22 февраля 2018 года Яндекс перестал учитывать crawl-delay, но у многих сайтов в robots.txt она до сих пор есть и SEO-менеджеры до сих пор уверены, что управляют скоростью обхода.

Так, с 22 февраля 2018 года Яндекс перестал учитывать crawl-delay, но у многих сайтов в robots.txt она до сих пор есть и SEO-менеджеры до сих пор уверены, что управляют скоростью обхода.

Держите руку на пульсе и не пренебрегайте базовыми правилами защиты сайта. Тем более, что с маленьким фалом robots.txt это совсем несложно.

Дальше: Составляем CJM (Customer Journey Map)

Анализ robots txt yandex

Поисковые роботы — краулеры начинают знакомство с сайтом с чтения файла robots.txt. В нем содержится вся важная для них информация. Владельцы сайтов должны создавать и периодически просматривать файл robots.txt. От корректности его работы зависит скорость индексации страниц и место в результатах поиска.

Не является обязательным элементом сайта, но его наличие желательно, т.к. используется владельцами сайтов для управления поисковыми роботами. Установить разные уровни доступа к сайту, запрет на индексацию всего сайта, отдельных страниц, разделов или файлов. Для ресурсов с высокой посещаемостью ограничьте время индексации и запретите доступ роботам, не относящимся к основным поисковым системам. Это снизит нагрузку на сервер.

Для ресурсов с высокой посещаемостью ограничьте время индексации и запретите доступ роботам, не относящимся к основным поисковым системам. Это снизит нагрузку на сервер.

Создание. Создайте файл в текстовом редакторе, таком как Блокнот или аналогичный. Убедитесь, что размер файла не превышает 32 КБ. Выберите для файла кодировку ASCII или UTF-8. Обратите внимание, что файл должен быть уникальным. Если сайт создан на CMS, то он будет сгенерирован автоматически.

Поместите созданный файл в корневой каталог сайта рядом с основным файлом index.html. Для этого используйте FTP-доступ. Если сайт сделан на CMS, то файл обрабатывается через административную панель. Когда файл создан и работает правильно, он доступен в браузере.

При отсутствии файла robots.txt поисковые роботы собирают всю информацию, относящуюся к сайту. Не удивляйтесь, увидев в результатах поиска пустые страницы или служебную информацию. Определите, какие разделы сайта будут доступны пользователям, а остальные закройте от индексации.

Экспертиза. Периодически проверяйте, все ли работает правильно. Если краулер не получает ответа 200 OK, то он автоматически предполагает, что файл не существует, а сайт полностью открыт для индексации. Коды ошибок следующие:

3xx — перенаправить ответы. Робот перенаправляется на другую страницу или на главную. Создавайте до пяти редиректов на одной странице. Если их больше, робот пометит такую страницу как ошибку 404. То же самое относится и к редиректам, основанным на принципе бесконечного цикла;

4xx — ответы об ошибках сайта. Если сканер получает ошибку 400 из файла robots.txt, он делает вывод, что файл не существует и все содержимое доступно. Это также относится к ошибкам 401 и 403;

5xx — ответы об ошибках сервера. Искатель будет «стучать», пока не получит ответ, отличный от 500-го.

Правила создания

Начнем с приветствия. Каждый файл должен начинаться с приветствия агента пользователя. С его помощью поисковые системы будут определять уровень открытости.

| Код | Значение |

| Агент пользователя: * | Доступно всем |

| Агент пользователя: Яндекс | Доступен роботу Яндекса |

| Агент пользователя: Googlebot | Доступно роботу Googlebot |

| Агент пользователя: Mail.ru | Доступен роботу Mail.ru |

Добавьте отдельные директивы для роботов. При необходимости добавьте директивы для специализированных поисковых ботов Яндекса.

Однако в этом случае директивы * и Яндекс учитываться не будут.

У Google есть свои боты:

Сначала запрещаем, потом разрешаем. Действовать двумя директивами: Allow — разрешаю, Disallow — запрещаю. Обязательно включите директиву disallow, даже если доступ разрешен ко всему сайту. Эта директива является обязательной. Если он отсутствует, сканер может неправильно прочитать остальную информацию. Если на сайте нет контента с ограниченным доступом, оставьте директиву пустой.

Если на сайте нет контента с ограниченным доступом, оставьте директиву пустой.

Работа с разными уровнями. В файле можно указать настройки на четырех уровнях: сайт, страница, папка и тип контента. Допустим, вы хотите скрыть изображения от индексации. Это можно сделать на уровне:

- папки — запретить: /images/

- тип содержимого — запретить: /*.jpg

Группировать директивы в блоки и разделять их пустой строкой. Не записывайте все правила в одну строку. Используйте отдельное правило для каждой страницы, краулера, папки и т.д. Также не путайте инструкции: пишите бота в юзер-агенте, а не в директиве allow/disallow.

| Не | Да |

| Запретить: Яндекс | Агент пользователя: Яндекс disallow: / |

| Запретить: /css/ /images/ | Запретить: /css/ Запретить: /images/ |

С учетом регистра. Введите имя файла строчными буквами. Яндекс в пояснительной документации указывает, что регистр для его ботов не важен, но Google просит учитывать регистр. Также возможно, что имена файлов и папок чувствительны к регистру.

Введите имя файла строчными буквами. Яндекс в пояснительной документации указывает, что регистр для его ботов не важен, но Google просит учитывать регистр. Также возможно, что имена файлов и папок чувствительны к регистру.

Укажите редирект 301 на главное зеркало сайта . Раньше для этого использовалась директива Host, но с марта 2018 года она больше не нужна. Если он уже есть в файле robots.txt, удалите его или оставьте на свое усмотрение; роботы игнорируют эту директиву.

Чтобы указать главное зеркало, поставьте 301 редирект на каждую страницу сайта. Если редиректа нет, поисковик самостоятельно определит, какое зеркало считать основным. Чтобы исправить зеркало сайта, просто введите переадресацию 301 страницы и подождите несколько дней.

Написать директиву Sitemap (карта сайта). Файлы sitemap.xml и robots.txt дополняют друг друга. Проверить, чтобы:

- файлы не противоречили друг другу; Из обоих файлов исключена

- страница; В обоих файлах разрешена

- страница.

При анализе содержимого robots.txt обратите внимание, включена ли карта сайта в одноименную директиву. Пишется так: Карта сайта: www.yoursite.ru/sitemap.xml

Укажите комментарии с помощью символа #. Все, что пишется после этого, игнорируется сканером.

Проверка файлов

Анализ robots.txt с помощью инструментов разработчика: Яндекс.Вебмастер и Google Robots Testing Tool. Обратите внимание, что Яндекс и Google проверяют только соответствие файла их собственным требованиям. Если файл корректен для яндекса, это не значит, что он корректен для роботов гугла, так что проверяйте в обеих системах.

Если вы обнаружите ошибки и исправите файл robots.txt, поисковые роботы не смогут мгновенно прочитать изменения. Обычно повторное сканирование страницы происходит раз в день, но часто занимает гораздо больше времени. Через неделю проверьте файл, чтобы убедиться, что поисковые системы используют новую версию.

Регистрация в Яндекс.

Вебмастере

ВебмастереСначала подтвердите права на сайт. После этого он появится в панели Вебмастера. Введите название сайта в поле и нажмите проверить. Результат проверки будет доступен ниже.

Дополнительно проверьте отдельные страницы. Для этого введите адреса страниц и нажмите «проверить».

Тестирование в Google Robots Testing Tool

Позволяет проверить и отредактировать файл в административной панели. Выдает сообщение о логических и синтаксических ошибках. Исправьте текст файла прямо в редакторе Google. Но обратите внимание, что изменения не сохраняются автоматически. После исправления robots.txt скопируйте код из веб-редактора и создайте новый файл с помощью блокнота или другого текстового редактора. Затем загрузите его на сервер в корневой каталог.

Запомнить

Файл robots.txt помогает поисковым роботам индексировать сайт. Закрывайте сайт на время разработки, в остальное время — весь сайт или его часть должны быть открыты. Правильно работающий файл должен возвращать ответ 200.

Файл создан в обычном текстовом редакторе. Во многих CMS в административной панели предусмотрено создание файла. Убедитесь, что размер не превышает 32 КБ. Поместите его в корневой каталог сайта.

Заполнить файл по правилам. Начните с кода «User-agent:». Пишите правила блоками, разделяя их пустой строкой. Следуйте принятому синтаксису.

Разрешить или запретить индексирование для всех или выбранных поисковых роботов. Для этого укажите название поискового робота или поставьте значок *, что означает «для всех».

Работа с разными уровнями доступа: сайт, страница, папка или тип файла.

Включить в файл указание на главное зеркало с помощью постраничной переадресации 301 и карту сайта с помощью директивы sitemap.

Используйте инструменты разработчика для анализа файла robots.txt. Это Яндекс.Вебмастер и Google Robots Testing Tools. Сначала подтвердите права на сайт, потом проверяйте. В гугле сразу отредактируйте файл в веб-редакторе и уберите ошибки. Отредактированные файлы не сохраняются автоматически. Загрузите их на сервер вместо оригинального файла robots.txt. Через неделю проверьте, используют ли поисковые системы новую версию.

Отредактированные файлы не сохраняются автоматически. Загрузите их на сервер вместо оригинального файла robots.txt. Через неделю проверьте, используют ли поисковые системы новую версию.

Материал подготовила Светлана Сирвида-Льоренте.

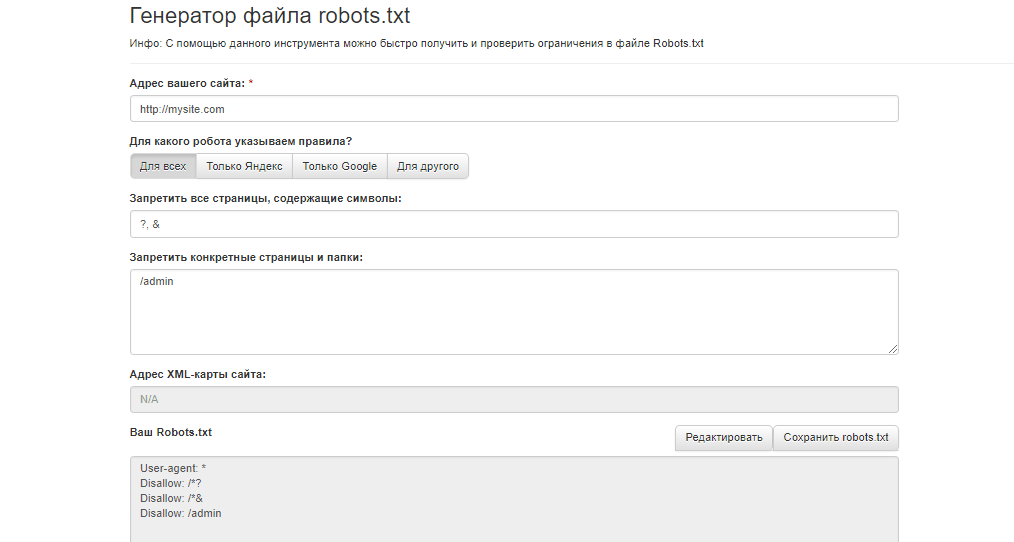

Каждый день в Интернете появляются решения той или иной проблемы. Нет денег на дизайнера? Используйте один из тысяч бесплатных шаблонов. Не хотите нанимать SEO-специалиста? Воспользуйтесь услугами какого-нибудь известного бесплатного сервиса, сами прочитайте пару статей.

Уже давно нет необходимости писать тот же robots.txt с нуля. Кстати, это специальный файл, который есть практически на любом сайте, и в нем содержатся инструкции для поисковых роботов. Синтаксис команды очень прост, но на создание собственного файла все равно потребуется время. Лучше посмотреть на другом сайте. Здесь есть несколько предостережений:

Сайт должен быть на том же движке, что и ваш. В принципе, сегодня в интернете очень много сервисов, где можно узнать название cms практически любого веб-ресурса.

Это должен быть более-менее успешный сайт, хорошо работающий с поисковым трафиком. Это означает, что файл robots.txt в порядке.

Итак, чтобы просмотреть этот файл, вам нужно набрать в адресной строке: domain-name.zone/robots.txt

Все невероятно просто, правда? Если адрес не найден, значит такого файла нет на сайте, либо доступ к нему закрыт. Но в большинстве случаев вы увидите перед собой содержимое файла:

В принципе, даже не особо разбирающийся в коде человек быстро поймет, что тут писать. Команда allow разрешает что-либо индексировать, а команда disallow запрещает это. User-agent — это указание поисковых роботов, которым адресованы инструкции. Это необходимо, когда вам нужно указать команды для конкретной поисковой системы.

Что делать дальше?

Скопируйте все и измените для своего сайта. Как изменить? Я уже говорил, что движки сайтов должны совпадать, иначе менять что-либо бессмысленно — нужно переписывать абсолютно все.

Итак, вам нужно будет пройтись по строкам и определить, какие из них присутствуют на вашем сайте, а какие нет. На скриншоте выше вы видите пример файла robots.txt для сайта wordpress, а в отдельной директории находится форум. Выход? Если у вас нет форума, все эти строчки надо удалить, так как таких разделов и страниц у вас просто нет, зачем тогда их закрывать?

На скриншоте выше вы видите пример файла robots.txt для сайта wordpress, а в отдельной директории находится форум. Выход? Если у вас нет форума, все эти строчки надо удалить, так как таких разделов и страниц у вас просто нет, зачем тогда их закрывать?

Простейший robots.txt может выглядеть так:

User-agent: * Disallow: /wp-admin Disallow: /wp-includes Disallow: /wp-content Разрешить: /wp-content/uploads/

Агент пользователя: * Запретить: /wp-admin Запретить: /wp-includes Запретить: /wp-content Разрешить: /wp-content/uploads/ |

Все вы, наверное, знаете стандартную структуру папок в wordpress, если хоть раз устанавливали этот движок. Это папки wp-admin, wp-content и wp-includes. Обычно все 3 закрыты от индексации, т.к. содержат чисто технические файлы, необходимые для работы движка, плагинов и шаблонов.

Открыт каталог загрузки, так как он содержит изображения, и они обычно индексируются.

В общем надо пройтись по скопированному robots.txt и посмотреть, что на самом деле написано у вас на сайте, а что нет. Самому, конечно, будет сложно определить. Могу только сказать, что если что-то не удалять, то ничего страшного, просто будет лишняя строка, что не навредит (потому что раздела нет).

Действительно ли настройка robots.txt так важна?

Конечно, вы должны иметь этот файл и хотя бы закрывать через него основные каталоги. Но так ли уж важно его составить? Как показывает практика, нет. Я лично вижу сайты на одних и тех же движках с совершенно разными robots.txt, которые одинаково успешно продвигаются в поисковых системах О.

Я не спорю, что можно сделать какую-то ошибку. Например, закройте изображения или оставьте ненужную директорию открытой, но ничего сверхстрашного не произойдет. Во-первых, потому что поисковые системы сегодня умнее и могут игнорировать некоторые инструкции из файла. Во-вторых, про настройку robots.txt написаны сотни статей, и из них можно кое-что понять.

Я видел файлы, в которых было 6-7 строк, запрещающих индексацию пары каталогов. Еще я видел файлы с сотней-двумя строками кода, где было закрыто все, что можно было. Оба сайта работали хорошо.

В wordpress есть так называемые дубликаты. Это плохо. Многие борются с этим, закрывая такие дубликаты, как это:

Disallow: /wp-feed Disallow: */trackback Disallow: */feed Disallow: /tag/ Disallow: /archive/

Disallow: /wp-feed Здесь надо бороться иначе. Например, с помощью редиректов или плагинов, которые уничтожат дубликаты. Впрочем, это тема для отдельной статьи. Где находится robots.txt?Этот файл всегда находится в корне сайта, поэтому мы можем получить к нему доступ, введя адрес сайта и имя файла через косую черту. На мой взгляд, здесь все максимально просто. В общем, сегодня мы рассмотрели вопрос, как посмотреть содержимое файла robots.txt, скопировать его и изменить под свои нужды. |

Правильно составленный файл robots.txt помогает корректно проиндексировать сайт и устраняет дублированный контент, обнаруженный в любой CMS. Я знаю, что многих авторов просто пугает необходимость лазить куда-то в корневые папки блога и что-то менять в «служебных» файлах. Но этот ложный страх необходимо преодолеть. Поверьте мне, ваш блог не рухнет, даже если вы поместите свой собственный портрет в robots.txt (т.е. испортите его!). Но, любые выгодные изменения повысят его статус в глазах поисковых систем.

Что такое файл robots.txt

Не буду претендовать на звание эксперта, мучая вас терминами. Просто поделюсь своим довольно простым пониманием функций этого файла:

robots.txt — это инструкция, дорожная карта для поисковых роботов, посещающих наш блог с проверкой. Нам просто нужно сказать им, какой контент является, так сказать, услугой, а какой является наиболее ценным контентом, к которому читатели стремятся (или должны стремиться) нам. И именно эта часть контента должна индексироваться и попадать в результаты поиска!

Нам просто нужно сказать им, какой контент является, так сказать, услугой, а какой является наиболее ценным контентом, к которому читатели стремятся (или должны стремиться) нам. И именно эта часть контента должна индексироваться и попадать в результаты поиска!

А что будет, если нам наплевать на такие инструкции? Все индексируется. А так как пути алгоритмов поисковых систем практически неисповедимы, анонс статьи, открывающейся по адресу архива, может показаться более актуальным для Яндекса или Google, чем полный текст статьи, находящейся по другому адресу. И посетитель, заглянув в блог, увидит совсем не то, что он хотел и что хотелось бы вам: не поста, а списки всех статей месяца… Итог ясен — скорее всего, он оставлять.

Хотя есть примеры сайтов, которые вообще не имеют робота, но занимают приличные позиции в поисковой выдаче, но это конечно исключение, а не правило.

Из чего состоит файл robots.txt

А вот переписыванием заниматься не хочу. Есть вполне понятные пояснения из первых рук — например, в разделе помощи Яндекса. Я настоятельно рекомендую прочитать их не один раз. Но я постараюсь помочь вам преодолеть первое оцепенение перед обилием терминов, описав общую структуру файла robots.txt.

Есть вполне понятные пояснения из первых рук — например, в разделе помощи Яндекса. Я настоятельно рекомендую прочитать их не один раз. Но я постараюсь помочь вам преодолеть первое оцепенение перед обилием терминов, описав общую структуру файла robots.txt.

В самом верху в начале robots.txt заявляем для кого пишем инструкцию:

User agent: Яндекс

Конечно у каждого уважающего себя поисковика есть куча роботов — именных и безымянный. Пока вы не освоите мастерство robots.txt, лучше всего делать вещи простыми и обобщаемыми. Поэтому предлагаю отдать должное Яндексу, а всех остальных объединить, прописав общее правило:

User-Agent: * — это все, любые, роботы

Также указываем основное зеркало сайта — адрес, который будет участвовать в поиске. Это особенно верно, если у вас есть несколько зеркал. Вы также можете указать некоторые другие параметры. Но самое главное для нас, все-таки, это возможность закрыть служебные части блога от индексации.

Вот примеры запрета индексации:

Запретить: /cgi-bin* — файлы скриптов;

Запретить: /wp-admin* — административная консоль;

Запретить: /wp-includes* — служебные папки;

Запретить: /wp-content/plugins* — служебные папки;

Запретить: /wp-content/cache* — служебные папки;

Запретить: /wp-content/themes* — служебные папки;

Запретить: */feed

Запретить: /comments* — комментарии;

Запретить: */comments

Запретить: /*/?replytocom=* — ответы на комментарии

Запретить: /tag/* — теги

Запретить: /archive/* — архивы

Запретить: /category/* — категории

Как создать свой файл robots.

txt

txtСамый простой и очевидный способ — найти пример готового файла robots.txt в каком-нибудь блоге и торжественно переписать его под себя. Хорошо, если при этом авторы не забудут заменить адрес блога примера на адрес своего детища.

Роботы любого сайта доступны по адресу:

https://website/robots.txt

Я сделал то же самое и не считаю себя вправе отговаривать вас. Единственное, что я прошу, это: разберись что написано в скопированном файле robots.txt! Воспользуйтесь помощью Яндекса, любых других источников информации — расшифруйте все строки. Тогда вы наверняка увидите, что какие-то правила не подходят для вашего блога, а каких-то правил, наоборот, не хватает.

Теперь посмотрим, как проверить правильность и эффективность нашего файла robots.txt.

Поскольку все, что связано с файлом robots.txt, поначалу может показаться слишком туманным и даже опасным, хочу показать вам простой и понятный инструмент для его проверки. Это очевидный способ помочь вам не только проверить, но и подтвердить ваш robots.txt, заполнить его всеми необходимыми инструкциями и убедиться, что роботы поисковых систем понимают, что вы от них хотите.

Это очевидный способ помочь вам не только проверить, но и подтвердить ваш robots.txt, заполнить его всеми необходимыми инструкциями и убедиться, что роботы поисковых систем понимают, что вы от них хотите.

Проверка файла robots.txt в Яндексе

Яндекс Вебмастер позволяет узнать отношение поискового робота этой системы к нашему творению. Для этого, очевидно, нужно открыть информацию, относящуюся к блогу и:

- перейти на вкладку Сервис->Анализ robots.txt

- нажать кнопку «загрузить» и будем надеяться, что вы разместили robots. txt куда нужно и робот его найдет 🙂 (если не найдет, проверьте, где находится ваш файл: он должен быть в корне блога, где папки wp -admin, wp- include и т.д., а ниже отдельные файлы — среди них должен быть robots.txt)

- нажмите «Проверить».

Но самая важная информация находится в соседней вкладке — «Используемые разделы»! Ведь на самом деле нам важно, чтобы робот понимал основную часть информации — а все остальное пропускал:

На примере мы видим, что Яндекс понимает все, что касается его робота (строки с 1 по 15 и 32) — это здорово!

Проверка файла robots.

txt в Google

txt в GoogleУ Google также есть инструмент проверки, который покажет нам, как эта поисковая система видит (или не видит) наш robots.txt:

- Инструменты Google для веб-мастеров (где ваш блог также должен быть зарегистрирован) имеют собственную службу для проверки файла robots.txt. Он находится на вкладке «Сканирование».

- Найдя файл, система анализирует его и выводит информацию об ошибках. Все просто.

На что следует обратить внимание при анализе файла robots.txt

Мы не зря рассмотрели инструменты анализа от двух важнейших поисковых систем — Яндекс и Google. Ведь нам нужно сделать так, чтобы каждый из них прочитал рекомендации, данные нами в robots.txt.

В приведенных здесь примерах видно, что Яндекс понимает инструкции, которые мы оставили его роботу, и игнорирует все остальные (хотя везде написано одно и то же, только директива User-agent: другая:)))

Важно понимать, что любые изменения в robots.txt необходимо вносить непосредственно в файл, находящийся в корневой папке вашего блога. То есть вам нужно открыть его в любом блокноте, чтобы переписать, удалить, добавить любые строки. Затем нужно сохранить его обратно в корень сайта и перепроверить реакцию на изменения в поисковых системах.

То есть вам нужно открыть его в любом блокноте, чтобы переписать, удалить, добавить любые строки. Затем нужно сохранить его обратно в корень сайта и перепроверить реакцию на изменения в поисковых системах.

Нетрудно понять, что в нем написано, что нужно добавить. А заниматься продвижением блога без правильной настройки файла robots.txt (так, как вам нужно!) — усложните себе задачу.

Карта сайта значительно упрощает индексацию вашего блога. Карта сайта должна быть обязательной для каждого сайта и блога. Но также на каждом сайте и блоге должен быть файл robots. текст . Файл robots.txt содержит набор инструкций для поисковых роботов. Можно сказать — правила поведения поисковых роботов на вашем блоге. А также этот файл содержит путь к карте сайта вашего блога. И, действительно, при правильно составленном файле robots.txt поисковый робот не тратит драгоценное время на поиск карты сайта и индексацию ненужных файлов.

Что такое файл robots.txt?

robots. txt — этот текстовый файл, может быть создан в обычном «блокноте» расположенном в корне вашего блога с инструкциями для поисковых роботов.