Парсинг ключевых слов для формирования СЯ

Парсинг или подбор ключевых слов для формирования Семантики сайта проводят при помощи сервисов или программ, наделенных такими функциями.

Наиболее популярными в Рунете являются сервисы Rash-Analytics и Just-Magic. Есть еще несколько сервисов и программ, которые хорошо справляются с этой задачей.

Можно назвать и программу Кей Коллектор или сервис ТопВизор.

У каждого сео специалиста есть свои рабочие инструменты для сбора поисковых запросов при работе над Семантическим Ядром.

Источники и инструменты сбора поисковых запросов

Для сбора ключевых слов существует много возможностей. У каждой есть свои плюсы и минусы. Ниже я привел наиболее популярные, на мой взгляд, инструменты.

- Поисковые системы

- Яндекс

- …….

- Парсеры

- Кей Коллектор – keycollector.ru

- Datacol

- A-Parser

- …….

- Облачные сервисы

- Rush-Analytics.ru

- Just-Magic.ru

- Topvisor.ru

- SemRush.ru

- ……

- Базы поисковых слов

- Pastuhov.com – базы Пастухова

- MOAB – moab.pro

- …….

- И еще достаточно много других достойных сервисов.

Как собирать ключевые слова

Для Рунета основным источником ключевых слов является сервис Wordstat от ПС Яндекс.

Запросов от Google, как правило, получается гораздо меньше и поэтому они чаще используются на этапе сбора базовых запросов. Как результат, в подавляющем большинстве случаев парсят Вордстат и этого бывает вполне достаточно.

Если же у Вас какая-то узкая ниша и надо обеспечивать максимальную полноту, тогда можно подключать сервисы Google и/или базы запросов.

Процедура парсинга запросов в облачных сервисах проходит довольно просто. Например, для Rush-Analytics необходимо задавать следующие параметры:

- Настроить проект в сервисе.

- Установить региональность.

- Выбрать пункт «Собрать ключевые слова».

- Загрузить список Базовых Запросов.

- Загрузить список минус-слов, если они у Вас уже есть.

- Инициировать работу парсера по сбору ключевых фраз.

Более наглядно этот процесс можно увидеть в этом небольшом видеоролике.

У меня первый прогон обычно используется для формирования списка минус слов. Выгружаю полученный результат и методом пристального взора составляю список таких слов.

Второй прогон, с учетом собранных минусов, уже будет более результативным и список ключей будет содержать гораздо меньше мусорных запросов. Тем не менее мы опять просматриваем полученные ключи, чистим мусор, пополняем список минус-слов и у нас все готово для следующего шага — сбора подсказок.

Плюсы и минусы работы с Кей Коллектором

Еще один вариант – сбор парсером KeyCollector (КК). Эта программа покупается один раз, причем по вполне сходной и доступной цене, а затем используем бесплатно.

При больших объемах КК очень сильно подгружает Ваш ПК, да и скорость сбора данных у него низкая. Поэтому мощность компьютера, на котором Вы хотите парсить большие объемы должна быть соответствующей.

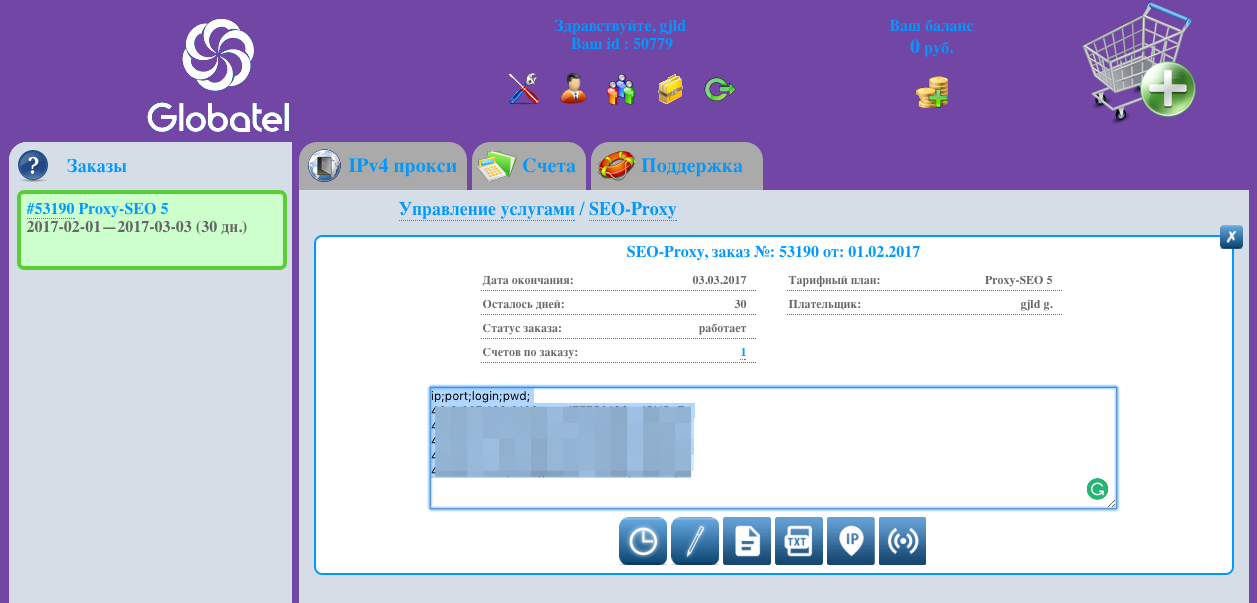

Для настройки многих операций сбора КК может потребовать определенных умственных усилий и хлопот при подключение разных аккаунтов, прокси-серверов, работе с капчей и т.п.

Но без этого получить данные без ощутимых материальных затрат не получится.

Я использую KeyCollector при работе над СЯ в основном на этапе чистки собранных ключей от мусора, дублей и т.п..

Дополнительные варианты подбора запросов

Можно собирать запросы и руками, используя для этого тот же Вордстат. Но при профессиональной работе это приведет к большим временным затратам, да и качество будет заметно хромать.

Такой способ подходит для подбора ключей на одну страницу, можно назвать экспресс методом для быстрой оценки ситуации.

Для сайта более целесообразно воспользоваться средствами автоматизации. Вы получите качественный результат гораздо быстрее и за сравнительно небольшие деньги.

Базы ключевых слов Пастухова, MOAB и другие используются реже, поскольку данные в этих базах не успевают обновляться так быстро как в Вордстат. Но в некоторых случаях, когда собранных запросов в облачных сервисах недостаточно, то подключают данные и из этих источников.

P.S. Облачные сервисы, к которым относятся Just-Magic, Rush-Analytics, TopVisor и другие собирают запросы быстро и не загружают Ваш компьютер. Но при больших объемах данных сумма за оказанные услуги будет довольно большой.

Поэтому, с точки зрения финансов и времени, Вам придется определяться самим. Если есть возможность переложить денежные затраты на Заказчика, то облачные сервисы будут гораздо уместнее. Если же Вы хотите заработать эти деньги, то тогда придется вложиться в покупку мощного ПК, программы КейКоллектор и освоить работу с этим парсером.

Полезные Материалы:

Парсер ключевых слов. Программа «Словоеб»

- Автор Parser

- Дата: 12 Май 2012

Парсер ключевых слов «Словоеб» — незаменимый бесплатный инструмент, особенно для начинающих при составлении и поиске ключевых слов для сайта. Позволяет значительно экономить время для работы с сайтом при составлении семантического ядра.

Функциональность программы сосредоточена на сборе и анализе статистики ключевых слов сервиса Яндекс.Вордстат, статистики LiveInternet, статистики сервиса Web Effector. Недавно вышла новая версия этой программы по сбору ключевых слов — Словоеб 2.0.

От своего предшествинника новый парсер отличается, как своим новым внешним видом, так и своей функциональностью. Впрочем это сильно урезанная версия известной программы для парсинга ключевых слов — Key Collektor. Наряду с основными функциями добавились и новые, что дает дополнительные возможности для качественного сбора ключевых слов.

Новые функции программы «Словоеб»:

- Поисковые подсказки

- Пакетный сбор Яндекс Wordstat

- Выдача конкуренции по Яндексу

- Выдача конкуренции по Гуглу

- Многопоточный режим парсинга

- Создание и работа с проектами

- Возможность обновления программы

Бесплатный парсер ключевых слов «Словоеб» обновился своими возможностями, внешним видом, но вместе с этим значительно выросло потребление ресурсов и размер программы. Тем не менее можно сказать, что на сегодняшний день, это лучшая бесплатная программа для сбора и анализа ключевых слов. Программа «Словоеб» съэкономит вам время и упростит сбор ключей для сайта, способствуя продвижению вашего ресурса в интернете. Скачать парсер ключевых слов «Словоеб» и посмотреть видео ролик о работе с программой можно на официальном сайте программы.

Рубрика: Парсеры ключевых словПарсер поисковых подсказок — бесплатная программа Словодëр

- Автор Parser

- Дата: 3 Июнь 2017

Большинство вебмастеров и блоггеров знают, что такое поисковые подсказки и их значение в поисковом продвижении сайта. Поисковые подсказки могут служить хорошим источником целевого трафика для вашего сайта. Грамотное использование ключевых слов и их варианты подсказок в ваших статьях, приносят дополнительный поисковый трафик. Поисковые подсказки в некоторых случаях, могут быть даже эффективнее ключевых слов.

Собирать подсказки лучше автоматически с помощью программ или сервисов. Очень удобно и главное быстро, можно провести парсинг подсказок с помощью бесплатной программы — парсер Словодер. Основное преимущество этого парсера перед другими программами, это возможность сбора большого количества подсказок за счет глубины парсинга. Парсер поисковых подсказок позволяет получить дополнительные ключевые фразы для семантического ядра сайта.

Парсер поисковых подсказок «Словодер» умеет:

- Парсинг подсказок яндекс, google, mail, rambler, yahoo, nigma

- Парсинг ключевых фраз по списку

- Фильтр стоп слов

- Глубина парсинга фраз

- Многопоточность

- Экспорт результатов парсинга в txt файл

- Поддержка прокси

Основные настройки Словодер

Настройка парсера Словодëр сводится к выбору поисковой системы, выбору региона и глубины парсинга. Сбор ключевых фраз проходит автоматически со всех выбранных систем сразу.

Для вебмастера, парсинг поисковых подсказок позволяет получать дешевый поисковый трафик в сети. По некоторым фразам из подсказок конкуренция оказывается намного меньше, чем по их ключевым запросам. Поэтому есть определенный смысл собирать поисковые подсказки google и яндекса для расширения семантического ядра сайта.

Парсер поисковых подсказок — Словодер, это отличный инструмент для поискового, статейного продвижения и создания рекламных кампаний контекстной рекламы.

Скачать

Рубрика: Парсеры ключевых словПарсинг ключевых слов в Key Collector

После прочтения статей вы научитесь: оптимизировать кампании в Excel методами, которые используются в оптимизаторах конверсий; автоматически собирать семантику, сегментировать и создавать объявления; прогнозировать конверсию на базе истории и многое другое.

Темы статей:

- Выгрузка данных из Google Analytics и Яндекс Метрики по API

- Парсинг ключевых слов в Key Collector

- Кластеризация запросов

- Агрегирование данных

- Прогнозирование конверсии для ключевых слов

- Расчет ставок

- Разработка заголовков

- Разработка рекламных кампаний

- Анализ эффективности

Материал сложный и раскрывает только базовые подходы к автоматизации, чтобы задать вам вектор развития.

В прошлой статье мы получили список запросов с конверсиями из Яндекс Метрики, которые теперь нам предстоит распарсить входящие запросы. Парсить будем входящие ключевые слова с частотностью менее 2000, но более 30 запросов в месяц по России.

Что мы делаем?

1) У нас есть запросы с конверсиями, которые нам нужно расширить

2) Мы берем запросы с конверсиями и парсим их входящие запросы, которыми мы их потом и расширим 3) То есть мы создаем базу входящих ключевых слов, из которой подтянем похожие слова к словам с конверсиями. Если слово будет входить в одну группу с фразой с конверсией, то мы его «подтягиваем». 4) На практике можно использовать не только входящие слова, но и любые другие, базу слов можно «расширять» бесконечно, вы ограничены только ресурсами кластеризации. В рамках статьи мы взяли только входящие запросы, чтобы не усложнять ее.

Парсим частотность запросов в Key Collector. Используем прокси с сайта primeproxy.net . Сайт проверенный, вы нам поверьте, мы парсим в промышленных масштабах!

Цены

Вставляем полученные прокси в настройки, как на скринах. К каждому IP нужно закрепить аккаунт в Яндекс Директе. В нашем случае мы купили 5 прокси и сможем парсить в 5 потоков. Вставляем адреса в соответствующие поля.

И сюда.

Ссылки

Если у вас много посадочных страниц >1000, то лучше импортировать фразы вместе с ссылками, по которым была конверсия, так как она может пригодиться.

Вставляем слова в Key Collector

Запускаем парсинг

Фильтруем список ключевых слов от 50 до 2000, чтобы распарсить их в вордстате.

Почему именно такие цифры? — Меньше 30 собирать слова нет смысла, их там очень мало — легче просто охватить их задав широкое соответствие, а свыше 2000 слишком много, потребуется много ресурсов на кластеризацию и немного другой подход, который усложнит статью.

Тут одна проблема, у нас 1500 ключевых слов, которые включают входящие запросы и получается так, что мы будем парсить один и тот же массив несколько раз, например, у нас есть слова «купить игрушку танк» и «купить игрушку». Нам не смысла парсить «купить игрушку танк», так как она находится внутри «купить игрушку».

Но как из массива 1500 удалить входящие слова? Готовых решений нет, поэтому пришлось написать свой код на Python.

#!/usr/bin/env python # -*- coding: UTF-8 -*- # импортируем библиотеки import pandas as pd import re # открываем таблицу df = pd.read_excel('Слова для парсинга в вордстате.xlsx', header=0) # в столбике delete пишем delete для входящих ключевых слов df.loc[:,'delete'] = 0 for i in range(len(df)): temp = df.loc[i,'delete'] t = df.copy() for word in df.loc[i,'Keyword'].split(' '): t = t[t['Keyword'].str.contains(word)] for idx in t.index: df.loc[idx,'delete'] = 'delete' df.loc[i,'delete'] = temp # сохраняем таблицу в файл df.to_excel('Слова для парсинга в вордстате.xlsx')

На выходе получаем новый столбик «delete», в котором значение «0» значит верхний запрос, а «delete» входящий — все входящие запросы мы удаляем, а верхние распарсиваем в wordstat’е

Фильтруем слова со значением «0» и копируем их в кей коллектор, получилось 1000 слов из 1500.

Вставляем в KeyCollector

Для парсинга используем настройки, которые на скрине — мы изменили кол-во потоков на 5, так как у нас 5 прокси и для каждого свой аккаунт в Яндекс Директе.

Все, парсинг запущен, в следующем этапе поговорим о прогнозировании.

Пишите вопросы в комментариях, какие темы было бы интересно раскрыть подробнее? Если у вас есть идеи или советы, то делитесь!

Slovoeb — подбор ключевых слов

👁3 730 просм.

В этой статье мы поговорим, как подбирать ключевые слова для размещения рекламы в Яндекс Директе и Google AdWords при помощи программы для парсинга СловоЁБ.

Что такое СловоЁБ

Это программный продукт, позволяющий эффективно парсить и обрабатывать заданные слова.

Парсинг, — процесс сопоставления линейной последовательности слов, естественного или формального языка с его формальной грамматикой (см. ВикипедиЯ). Другими словами, это подбор словосочетаний с заданными ключевыми словами в различных вариациях.

Скачать актуальную версию СловоЁБ вы всегда можете воспользовавшись поисковой системой Гугл или Яндекс 🙂

Как подобрать ключевые запросы для парсинга

Чтоб подобрать наиболее популярные ключевые слова для рекламируемого вами продукта можно воспользоваться сервисом «Яндекс подбор слов». Этот сервис позволяет выбрать регион, в котором вы намерены показывать поисковую рекламу и подобрать наиболее высокочастотные запросы по вашему продукту.

Например, я решил продавать массажеры в России. Выбрав регион Россия и вписав поисковый запрос «купить массажер», я могу увидеть наиболее популярные поисковые запросы по этой теме.

Для дальнейшего парсинга наиболее интересна колонка «Запросы похожие на…». Если этот запрос подходит под описание нашего товара, то мы можем использовать его для составления различных вариаций при помощи программы СловоЁБ.

Как парсить ключевые запросы в СловоЁБ

После того, как мы подобрали основные ключевые запросы, которые будем парсить (их можно сохранить для дальнейшей обработки в программе Excel, или подобной), переходим к работе с программой парсером.

После первого запуска необходимо провести минимальные настройки для дальнейшей работы с программой. Первое, это ввести логин и пароль от имеющегося аккаунта Яндекс в формате «мойлогин:мойпароль». Я рекомендую для работы с Словоёбом использовать отдельно созданную учетную запись, чтоб не потярять наработки. если вдруг аккаунт будет по каким то причинам заблокирован. Для ввода логина и пароля жмем значок шестеренки в верхней пали программы и в открывшемся окне выбираем вкладку «Yandex.Direct»:

Далее переходим на вкладку «Yandex.Wordstat», и выставляем значение «глубина парсинга» равное двум.

После чего сохраняем настройки. Все программа готова к работе. Теперь создаем новый проект, нажав кнопку «Создать новый проект» и сохраняем его в удобном для нас месте.

В открывшемся окне проекта переименовываем название Группы по умолчанию в ключевое слово, которое собираемся парсить и жмем кнопку «Пакетный сбор слов из левой колонки….», для начала процедуры парсинга.

В следующем окне вводим ключевое слово, которое мы хотим найти в разных сочетаниях и жмем кнопку «Начать сбор».

Если появится окно с капчей, то вводим соответствующие символы и запускаем поиск.

Вот и все. Сбор слов начался. Вы можете ждать, пока программа соберет все вариации и остановится сама, или остановить поиск вручную, если данные в колонке «Частотность[WS]» напротив найденных слов будут составлять менее цифры 7.

Затем можно скопировать найденные слова кликнув правой кнопкой мышки по колонке «Фраза» и выбрав в выпадающем меню пункт «Скопировать колонку в буфер обмена».

Далее найденные слова можно вставить в Excel файл и продолжить там работу по сортировке этих слов, очистки от не нужных приложений и не подходящих ключевых фраз.

Применение спарсенных предложений

После обработки спарсенных предложений и очистки от мусора, их можно использовать в рекламных кампаниях Яндекс Директа и Google AdWords для более релевантных (соответствующих поисковому запросу пользователей) объявлений.

Как размещать рекламные кампании в Яндекс Директ и Google AdWords мы будем рассматривать в отдельных статьях.

Благодарю за внимание 🙂

Оставляйте свои комментарии, задавайте вопросы, подписывайтесь на обновления моего блога. Буду рад общению с вами.

P.S. Так же вас может заинтересовать статья о первичной настройке Google AdWords.

Новый! Уникальный способ сбора Яндекс.Вордстат

Команда проекта запустила новый экспертный инструмент: «Получение данных из Яндекс.Вордстат». Логика его работы — достаточно простая, доступно множество настроек, что позволяет

-

Регион сбора частот / фраз.

-

Глубину парсинга Wordstat в страницах.

-

Получение точной и общей частоты по запросам.

-

Сбор правой колонки (запросы, похожие на «фраза»).

-

Получение частот на мобильных устройствах.

-

Список стоп-слов (для исключения нецелевых запросов по маске).

-

Удаление НЧ-фраз (если требуется, отсечка — по частоте).

-

Дополнительная обработка: спецсимволы, запросы с нулевой точной или общей частотой, очень длинные/короткие фразы, условные дубли.

![]()

Итоговый файл будет сформирован в облаке (никаких КАПЧ (!) и банов по IP) за несколько минут, а скаченный CSV будет содержать и дополнительные колонки, удобные для дальнейшей работы с семантикой:

-

Отношение частот (Точная / Общая).

-

Доля мобильного спроса.

-

Колонка Wordstat: Левая / Правая.

-

Число слов в запросе.

-

Тип фразы (кириллическая, на латинице, с числами, смешанная и т.д.).

Один лимит «Пиксель Тулс» расходуется на парсинг двух страниц с запросами и/или двух точных частот. Истории проверок (парсинга) хранятся в облаке.

Данный инструмент очень хорошо гармонирует с другими источниками семантики:

![]()

![]()

Удачи в быстром сборе семантического ядра для проектов!