Посмотреть сайт глазами робота

Посмотреть Код HTML страницы сайта глазами поискового робота онлайн.

В некоторых случаях бывает интересно посмотреть HTML код понравившейся станицы. Например узнать какой .js библиотекой достигнут тот или иной функционал, а может заинтересовали CSS стили оформления и.т.д. Но откравая страницу правой кнопкой мыши мы можем иногда наблюдать сжатый код написанный в одну строчку, ну и разумеется без подсветки кода. Что согласитесь затрудняет поиск заинтересовавшего куска кода. Наш онлайн сервис поможет открыть HTML в удобочитаемом виде с подсветкой и форматированием кода.

* В некоторых случаях ресурс закрыт от просмотра кода сторонними сайтами и тогда мы не сможем Вам показать исходный код.

Это связано с тем, что некоторые сайты могут отдавать различный контент в зависимости от пользователя или робота.

Например интернет магазин для пользователя может отдаваться различый контент в зависимости от региона проживания.

Метод черной поисковой оптимизации — называется «клоакинг» Термин произошел от английского слова to cloak – маскировать, прятать, скрывать — Сайты, отдающие разный контент пользователям и роботам поисковых систем.

Такие сайты Яндекс и Google относят к некачественным сайтам и объявили за клоакинг жесткие штрафные санкции, от пессимизации до бана.

Ярким примером клоакинга могут служить каталоги ссылок скрывающие прямые ссылки от роботов , но показывающие их простому пользователю, который никак не может понять почему же его сылка не видна в поисковых системах.

Обратите внимание, что к клоакингу не относится показ различного содержание веб-ресурса если пользователь просматривает его как авторизованный (через логин и пароль). Также не имеет отношение к клоакингу просмотр динамических страниц с разными URL переменными например URL = user и URL = bot.

Наш онлайн инструмент для веб-мастера позволяет просмотреть код HTML глазами поискового робота Googlebot и робота Яндекса.

Список HTTP USER AGENT:

Пользователь — Я Mozilla/5.0 (X11; Linux x86_64; rv:33.0) Gecko/20100101 Firefox/33.0

Основной робот Яндекса — Mozilla/5.0 (compatible; YandexBot/3.0; +http://yandex.com/bots)

Зеркальщик — робот Яндекса — Mozilla/5.0 (compatible; YandexBot/3.0; MirrorDetector; +http://yandex.com/bots)

Картинки — робот Яндекса — Mozilla/5.0 (compatible; YandexImages/3.0; +http://yandex.com/bots)

Видео — робот Яндекса Mozilla/5.0 (compatible; YandexVideo/3.0; +http://yandex.com/bots)

Вебмастер — робот Яндекса Mozilla/5.0 (compatible; YandexWebmaster/2.0; +http://yandex.com/bots)

Индексатор мультимедийных данных — робот Яндекса Mozilla/5.0 (compatible; YandexMedia/3.0; +http://yandex.com/bots)

Поиск по блогам — робот Яндекса Mozilla/5.0 (compatible; YandexBlogs/0.99; robot; +http://yandex.com/bots)

APIs-Google — робот Google PIs-Google (+https://developers.google.com/webmasters/APIs-Google.html)

AdSense — робот Google Mediapartners-Google

AdsBot Mobile Web Android — робот Google Mozilla/5. 0 (Linux; Android 5.0; SM-G920A) AppleWebKit (KHTML, like Gecko) Chrome Mobile Safari (compatible; AdsBot-Google-Mobile; +http://www.google.com/mobile/adsbot.html)

0 (Linux; Android 5.0; SM-G920A) AppleWebKit (KHTML, like Gecko) Chrome Mobile Safari (compatible; AdsBot-Google-Mobile; +http://www.google.com/mobile/adsbot.html)

AdsBot Mobile Web — робот Google Mozilla/5.0 (iPhone; CPU iPhone OS 9_1 like Mac OS X) AppleWebKit/601.1.46 (KHTML, like Gecko) Version/9.0 Mobile/13B143 Safari/601.1 (compatible; AdsBot-Google-Mobile; +http://www.google.com/mobile/adsbot.html)

AdsBot-Google (+http://www.google.com/adsbot.html) AdsBot — робот Google)

Googlebot Images — робот Google Googlebot-Image/1.0

Googlebot News — робот Google Googlebot-News

Googlebot Video — робот Google Googlebot-Video/1.0

Googlebot — робот Google Mozilla/5.0 (compatible; Googlebot/2.1; +http://www.google.com/bot.html)

Mobile AdSense — робот Google (compatible; Mediapartners-Google/2.1; +http://www.google.com/bot.html)

Mobile Apps Android — робот Google AdsBot-Google-Mobile-Apps

Просмотр html станицы сайта

Данный инструмент покажет html код страницы с подсветкой синтаксиса кода. Просмотр документов html теперь будет визуально удобочитаемым.

Просмотр документов html теперь будет визуально удобочитаемым.

Программа просмотра html документов основана на получении данных с помощью PHP скрипта.

Просмотр html страницы сайта — это первый шаг в изучении программирования веб-документов используя HTML разметки , CSS и JS.

«Поделиться»

Комментарии — 0

Взгляните на свою страницу глазами робота Googlebot / Хабр

HabrAndreyВремя на прочтение 2 мин

Количество просмотров 89KБлог компании Google Developers Поисковые технологии *

Перевод

Автор оригинала: Автор: Джон Мюллер (John Mueller), аналитик Google

Уровень подготовки веб-мастера: любой

Функция «Просмотреть как Googlebot» в Инструментах для веб-мастеров позволяет понять, как ваша страница выглядит для роботов Googlebot. Заголовки серверов и код HTML помогают выявить ошибки и последствия взлома, но иногда разобраться в них бывает затруднительно. Веб-мастера обычно хватаются за голову, когда им приходится заниматься решением таких проблем. Чтобы помочь вам в подобных ситуациях, мы усовершенствовали эту функцию, и теперь она может показывать страницу с помощью того же алгоритма, который использует робот Googlebot.

Заголовки серверов и код HTML помогают выявить ошибки и последствия взлома, но иногда разобраться в них бывает затруднительно. Веб-мастера обычно хватаются за голову, когда им приходится заниматься решением таких проблем. Чтобы помочь вам в подобных ситуациях, мы усовершенствовали эту функцию, и теперь она может показывать страницу с помощью того же алгоритма, который использует робот Googlebot.Как отображается просканированная страница

При обработке страницы робот Googlebot ищет и импортирует из внешних источников все связанные с ней файлы. Обычно это изображения, таблицы стилей, элементы JavaScript и другие файлы, встраиваемые с помощью CSS или JavaScript. Система использует их для отображения страницы так, как ее видит робот Googlebot.

Функция Просмотреть как Googlebot доступна в разделе «Сканирование» вашего аккаунта Инструментов для веб-мастеров. Обратите внимание, что обработка страницы с ее последующим показом может занять достаточно продолжительное время.

После ее завершения наведите указатель мыши на строку, в которой указан нужный URL, чтобы просмотреть результат.

После ее завершения наведите указатель мыши на строку, в которой указан нужный URL, чтобы просмотреть результат.для обычного робота Googlebot

для робота Googlebot для смартфонов

Обработка ресурсов, заблокированных в файле robots.txt

При обработке кода робот Googlebot учитывает инструкции, указанные в файле robots.txt. Если они запрещают доступ к тем или иным элементам, система не будет использовать такие материалы для предварительного просмотра. Это произойдет и в том случае, если сервер не отвечает или возвращает ошибку. Соответствующие данные можно найти в разделе Ошибки сканирования вашего аккаунта Инструментов для веб-мастеров. Кроме того, полный перечень таких сбоев отобразится после того, как будет создано изображение страницы для предварительного просмотра.

Мы рекомендуем обеспечить Googlebot доступ ко всем встроенным ресурсам, которые есть на сайте или в макете. Это упростит работу с функцией «Просмотреть как Googlebot», позволит роботу обнаружить и правильно проиндексировать контент вашего сайта, а также поможет вам понять, как выполняется сканирование ваших страниц.

Надеемся, что наше нововведение поможет вам решить проблемы с оформлением сайта и обнаружить ресурсы, которые Google по тем или иным причинам не может просканировать. Если у вас есть вопросы, свяжитесь с нами в сообществе для веб-мастеров на Google Plus или поищите ответ на справочном форуме Google для веб-мастеров. Теги:

- googlebot

- crawling

- сканирование

- robots.txt

- Блог компании Google Developers

- Поисковые технологии

Всего голосов 29: ↑21 и ↓8 +13

Комментарии 1

Facebook Twitter Medium

Андрей Липатцев @HabrAndrey

Пользователь

Как создать «видящего» робота с помощью 100 долларов и TensorFlow — O’Reilly

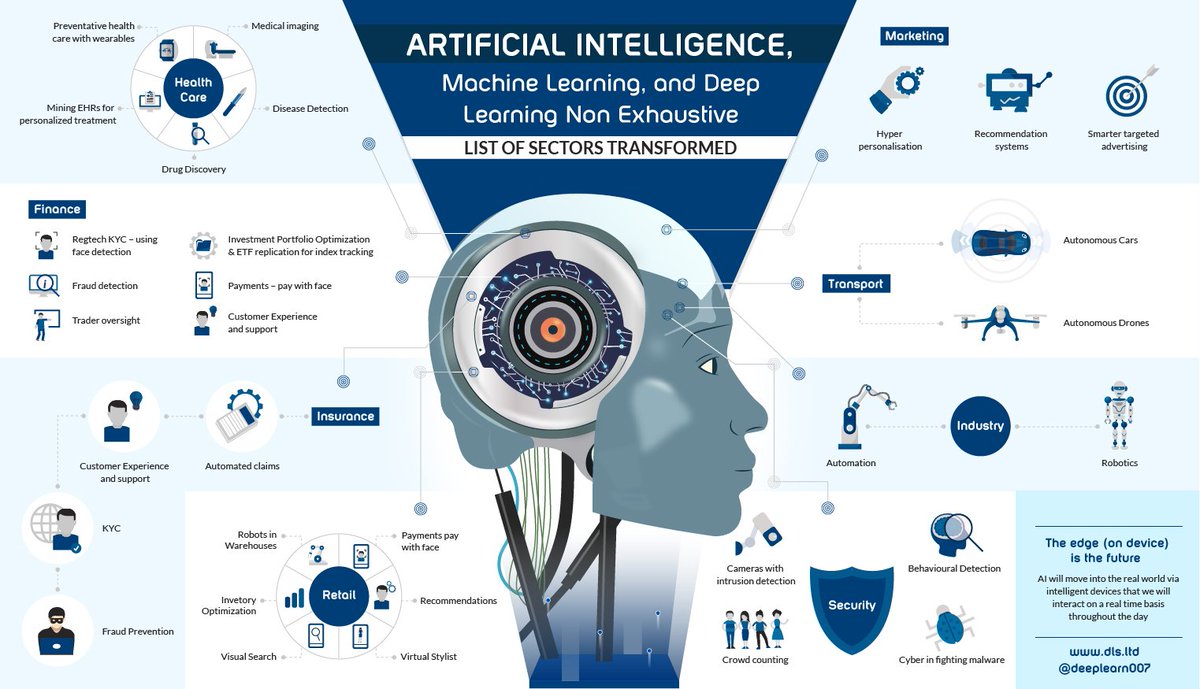

Распознавание объектов — одна из самых захватывающих областей машинного обучения прямо сейчас. Компьютеры уже давно способны надежно распознавать такие объекты, как лица или кошек, но распознавание произвольных объектов на более крупном изображении стало Святым Граалем искусственного интеллекта. Возможно, настоящий сюрприз заключается в том, что человеческий мозг так хорошо распознает объекты. Мы без особых усилий преобразовываем фотоны, отражающиеся от объектов с немного отличающимися частотами, в невероятно богатый набор информации об окружающем нас мире. Машинное обучение все еще борется с этими простыми задачами, но за последние несколько лет оно стало намного лучше.

Компьютеры уже давно способны надежно распознавать такие объекты, как лица или кошек, но распознавание произвольных объектов на более крупном изображении стало Святым Граалем искусственного интеллекта. Возможно, настоящий сюрприз заключается в том, что человеческий мозг так хорошо распознает объекты. Мы без особых усилий преобразовываем фотоны, отражающиеся от объектов с немного отличающимися частотами, в невероятно богатый набор информации об окружающем нас мире. Машинное обучение все еще борется с этими простыми задачами, но за последние несколько лет оно стало намного лучше.

Глубокое обучение и большой общедоступный набор обучающих данных под названием ImageNet добились впечатляющего прогресса в распознавании объектов. TensorFlow — это хорошо известная платформа, которая упрощает реализацию алгоритмов глубокого обучения на различных архитектурах. TensorFlow особенно хорош в использовании преимуществ графических процессоров, которые, в свою очередь, также очень хороши в выполнении алгоритмов глубокого обучения.

Учитесь быстрее. Копай глубже. Смотрите дальше.

Присоединяйтесь к платформе онлайн-обучения O’Reilly. Получите бесплатную пробную версию сегодня и находите ответы на лету или осваивайте что-то новое и полезное.

Узнать большеСоздание моего робота

Я хотел построить робота, который мог бы распознавать объекты. Многолетний опыт создания компьютерных программ и разработки через тестирование превратили меня в угрозу, связанную с физическими проектами. В реальном мире тестирование вашего глючного устройства может сжечь ваш дом или, по крайней мере, сжечь ваш двигатель и заставить вас ждать пару дней, пока прибудут запасные части.

Рис. 1. Архитектура робота, распознающего объекты. Изображение предоставлено Лукасом Бивальдом. Новый Raspberry Pi третьего поколения идеально подходит для такого рода проектов. Он стоит 36 долларов на Amazon.com и имеет Wi-Fi, четырехъядерный процессор и гигабайт оперативной памяти. Карта microSD за 6 долларов может загрузить Raspberian, который по сути является Debian. См. Рисунок 1 для обзора того, как все компоненты работают вместе, и см. Рисунок 2 для фотографии Pi.

Карта microSD за 6 долларов может загрузить Raspberian, который по сути является Debian. См. Рисунок 1 для обзора того, как все компоненты работают вместе, и см. Рисунок 2 для фотографии Pi.

Мне нравится дешевое шасси робота, которое Sain Smart делает примерно за 11 долларов. Шасси поворачивается за счет вращения колес с разной скоростью, что работает на удивление хорошо (см. рис. 3).

Единственное место, на которое я тратил больше денег, когда были доступны более дешевые варианты, — это моторная шляпа Adafruit (см. рис. 4). Двигатели постоянного тока работают с более высоким током, чем может обеспечить Raspberry Pi, поэтому необходим отдельный контроллер, а шляпа двигателя Adafruit очень удобна. Использование шлема двигателя потребовало небольшого количества пайки, но аппаратное обеспечение чрезвычайно щадящее, и Adafruit предоставляет хорошую библиотеку и руководство для управления двигателями через i2C. Изначально я использовал более дешевые контроллеры моторов, но случайно поджарил свой Pi, поэтому решил заказать более качественную замену.

Изначально я использовал более дешевые контроллеры моторов, но случайно поджарил свой Pi, поэтому решил заказать более качественную замену.

Камера за 15 долларов подключается прямо к Raspberry Pi и обеспечивает видеопоток в реальном времени, который я могу использовать для распознавания объектов. Доступны тонны потрясающих камер. Мне нравятся инфракрасные камеры с ночным видением.

Raspberry Pi требуется около 2 ампер тока, но 3 ампера безопаснее с динамиком, который мы собираемся подключить к нему. Зарядные устройства для iPhone отлично справляются с этой задачей. Небольшие зарядные устройства на самом деле не выдают достаточного количества ампер и могут вызвать проблемы, но внешний аккумулятор Lumsing отлично работает и стоит 18 долларов.

Пара гидроакустических датчиков HC-SR04 помогает роботу избежать столкновения с вещами — вы можете купить пять за 11 долларов.

Я добавил самые дешевые USB-динамики, которые смог найти, и использовал несколько стяжек, горячий клей и пенопласт, чтобы скрепить все вместе.

Когда робот собран, пришло время сделать его умным. В Интернете есть миллион руководств по началу работы с Raspberry Pi. Если вы использовали Linux, все должно быть очень знакомо.

Для потоковой передачи с камеры прекрасно работает веб-интерфейс RPi Cam. Его можно легко настроить, и по умолчанию последнее изображение с камеры помещается на RAM-диск по адресу /dev/shm/mjpeg/cam.jpg .

Если вы хотите передавать данные с камеры на веб-страницу (очень полезно для отладки), вы можете установить Nginx, чрезвычайно быстрый веб-сервер/прокси с открытым исходным кодом. Я настроил Nginx для передачи запросов на изображение с камеры непосредственно в расположение файла, а все остальное — на мой веб-сервер.

Я настроил Nginx для передачи запросов на изображение с камеры непосредственно в расположение файла, а все остальное — на мой веб-сервер.

http {

сервер {

расположение / {

proxy_pass http://unix:/home/pi/drive.sock;

}

местоположение /cam.jpg {

корень /dev/shm/mjpeg;

}

}

}

Затем я создал простой веб-сервер Python, чтобы крутить колеса робота на основе команд с клавиатуры, что позволило создать изящную машину с дистанционным управлением.

Кстати, с сонаром и системой вождения весело играть, чтобы построить машину, которая может объезжать препятствия.

Программирование моего робота

Наконец, пришло время установить TensorFlow. Есть несколько способов выполнить установку, но на самом деле TensorFlow поставляется с make-файлом, который позволяет вам собрать его прямо в системе. Шаги занимают несколько часов и имеют довольно много зависимостей, но они отлично сработали для меня.

TensorFlow поставляется с предварительно созданной моделью, называемой «начало», которая выполняет распознавание объектов. Вы можете следовать руководству, чтобы запустить его.

Вы можете следовать руководству, чтобы запустить его.

Запуск tensorflow/contrib/pi_examples/label_image/gen/bin/label_image на изображении с камеры выведет пять лучших предположений. Модель на удивление хорошо работает с широким диапазоном входных данных, но ей явно не хватает точного «априорного» или представления о том, что она может увидеть, и в обучающих данных отсутствует довольно много объектов. Например, он стабильно распознает мой ноутбук, даже под забавными углами, но если я наведу его на свою корзину с оторванными проводами, он неизменно решит, что смотрит на тостер. Если камера заблокирована и она получает темное или размытое изображение, она обычно решает, что смотрит на нематод — явно артефакт данных, на которых она обучалась.

Наконец, я подключил выход к пакету программного обеспечения с открытым исходным кодом Flite, который преобразует текст в речь, чтобы робот мог рассказать всем, что он видит (см. рис. 6).

рис. 6).

Тестирование моего робота

Вот два моих самодельных робота, использующих глубокое обучение для распознавания объектов.

Заключительные мысли

С 2003 по 2005 год я работал в Стэнфордской лаборатории робототехники, где роботы стоили сотни тысяч долларов и не могли распознавать объекты почти так же хорошо, как мои роботы. Я очень рад установить это программное обеспечение на свой дрон, и мне больше никогда не придется искать ключи.

Я также хотел бы поблагодарить всех людей, которые помогли с этим забавным проектом. Мои соседи, Крис Ван Дайк и Шрути Ганди, помогли придать роботу дружелюбный характер. Мой друг Эд Маккалоу значительно улучшил конструкцию оборудования и научил меня ценить горячий клей и пенопласт. Пит Уорден, работающий в Google, помог правильно скомпилировать TensorFlow на Raspberry Pi и обеспечил прекрасную поддержку клиентов.

Пит Уорден, работающий в Google, помог правильно скомпилировать TensorFlow на Raspberry Pi и обеспечил прекрасную поддержку клиентов.

Темы сообщений: Искусственный интеллект

Делиться:- Твит

Поделиться

Получить информационный бюллетень O’Reilly Radar Trends to Watch

Отслеживание важных тенденций на стыке бизнеса и технологий.

Ваш адрес электронной почты

Страна — Выберите страну -Соединенные ШтатыАфганистанАлбанияАлжирАндорраАнголаАнголаАнтигуа и БарбудаАргентинаАрменияАрубаАвстралияАвстрияАзербайджанБагамские островаБахрейнБангладешБарбадосБеларусьБельгияБелизБенинБермудыБутанБоливияБосния и ГерцеговинаБотсванаБразилияБрунейБолгарияБуркина-ФасоБурундиКамбоджаКамерунКанада Кабо-ВердеЦентральноафриканская РеспубликаЧадЧилиКитайская Народная РеспубликаКолумбияКоморские островаКонго, Республика Конго, Демократическая Республика Острова КукаКоста-РикаКот-д’Ивуар (Берег Слоновой Кости)ХорватияКубаКипрЧехияДанияДжибутиДоминикаДоминиканская РеспубликаЭквадорЕгипетСальвадорЭкваториальная ГвинеяЭритреяЭстонияЭсватини (ранее Свазиленд) земля)ЭфиопияФедеративные Штаты МикронезияФиджиФинляндияФранцияГабонГамбияГрузияГерманияГанаГрецияГренадаГватемалаГвинеяГвинея-БиссауГайанаГаитиГондурасВенгрияИсландияИндияИндонезияИранИракИрландияИзраильИталияЯмайкаЯпонияИорданияКазахстанКенияКирибатиКорея, Народно-Демократическая РеспубликаК орея, Республика КувейтКыргызстанЛаосЛатвияЛиванЛесотоЛиберияЛивияЛихтенштейнЛитваЛюксембургМакедония, Республика МадагаскарМалавиМалайзияМальдивыМалиМальтаМавританияМаврикийМексикаМолдоваМонакоМонголияЧерногорияМароккоМозамбикМьянмаНамибияНауруНепалНидерландыНовая ЗеландияНикарагуа НигерНигерияНиуэНорвегияОманПакистанПалестина, Государство ПанамаПапуа-Новая ГвинеяПарагвайПеруФилиппиныПольшаПортугалияКатарРумынияРоссияРуандаСент-Китс и НевисСент-ЛюсияСент-Винсент и ГренадиныСамоаСан-МариноСан-Томе и ПринсипиСаудовская АравияСенегалСербияСейшельские островаСьерра-ЛеонеСингапур СловакияСловенияСоломоновы островаСомалиЮжная АфрикаЮжный СуданИспанияШри-ЛанкаСуданСуринамШвецияШвейцарияСирияТайваньТаджикистанТанзанияТаиландТимор-Лешти (Восточный Тимор)ТогоТонгаТринидад и ТобагоТунисТурцияТуркменистанТувалуУгандаУкраинаОбъединенные Арабские ЭмиратыВеликобританияСоединенные ШтатыУругвайУзбекистанВануату городВенесуэлаВьетнамЙеменЗамбияЗимбабве

Спасибо за подписку.

Робот научился пользоваться инструментами

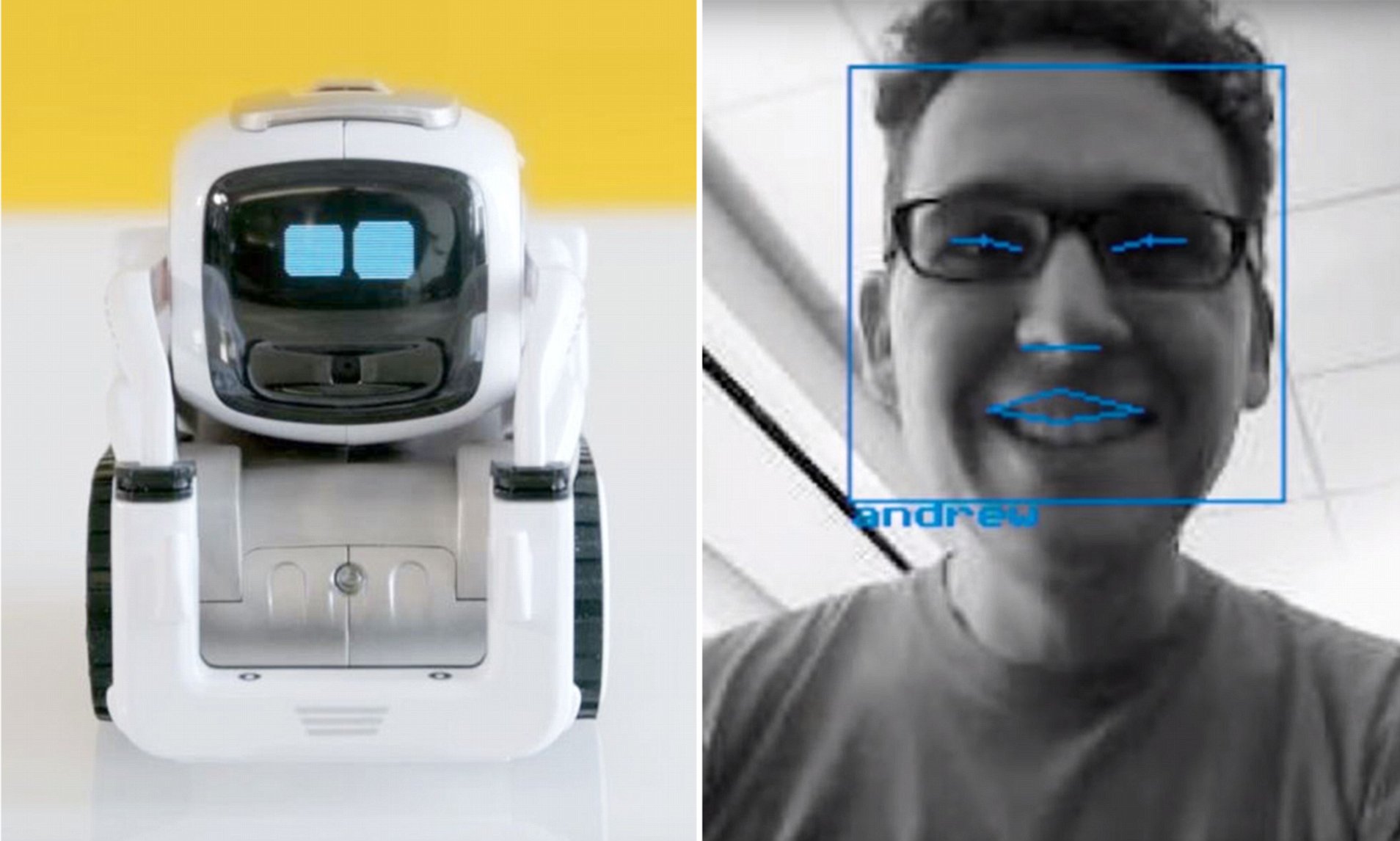

Перейти к содержимомуВ поразительной демонстрации машина использовала эксперименты, данные и наблюдения за людьми, чтобы узнать, как простые инструменты могут помочь ей выполнить задачу. 11 апреля 2019 г. Это может оказаться жизненно важным для появления более умных и способных роботов.

Новое исследование показывает, что роботы могут понять, по крайней мере, основы использования инструментов, путем сочетания экспериментов и наблюдения за людьми.

Челси Финн, исследователь Google Brain, и Сергей Левин, доцент Калифорнийского университета в Беркли, разработали роботизированную систему вместе с несколькими учениками Левина. (Финн и Левин были названы новаторами до 35 лет по версии MIT Technology Review в 2018 и 2016 годах соответственно.)

Установка состоит из готовой роботизированной руки, которой может управлять человек или компьютер. Он также включает в себя камеру, которая видит окружающую среду в пределах досягаемости руки, и, что наиболее важно, компьютер с очень большой нейронной сетью, которая позволяет роботу учиться.

Робот научился использовать простые приспособления, включая совок, метлу и тряпку, для перемещения других предметов. Работа намекает на то, как роботы могут когда-нибудь научиться выполнять сложные манипуляции и решать абстрактные задачи для себя. «Это интересно, потому что это означает, что робот может понять, что делать с инструментом в ситуациях, с которыми он раньше не сталкивался», — говорит Финн. «Мы действительно хотим изучить такого рода общность, а не робота, который учится использовать один инструмент».

Ранее исследователи показали, как робот может научиться перемещать объекты без явных инструкций. Наблюдая и экспериментируя, робот выстраивает простую причинно-следственную модель («Толкните объект сюда, и он окажется там»). Новый робот обучается аналогичным образом, но строит более сложную модель физического мира («Перемещение этого предмета может привести к перемещению других предметов туда»).

Роботизированная система обучается несколькими способами. Чтобы получить общее представление о причине и следствии, он самостоятельно экспериментирует с объектами, подталкивая их, чтобы увидеть результаты. Он также получает данные из множества предыдущих исследований роботов. Повсюду рекуррентная нейронная сеть учится предсказывать, что произойдет в сцене, если робот выполнит определенное действие.

Чтобы получить общее представление о причине и следствии, он самостоятельно экспериментирует с объектами, подталкивая их, чтобы увидеть результаты. Он также получает данные из множества предыдущих исследований роботов. Повсюду рекуррентная нейронная сеть учится предсказывать, что произойдет в сцене, если робот выполнит определенное действие.

Чтобы освоить использование инструментов, робот также наблюдает за поведением человека. Объединение уроков двух типов обучения позволяет роботу определить, как использовать объект в новой ситуации.

Энни Се, студентка бакалавриата Калифорнийского университета в Беркли, участвующая в проекте, пишет о работе в соответствующем сообщении в блоге: «Сочетая демонстрационные данные и неконтролируемый опыт, робот может использовать новые объекты в качестве инструментов и даже импровизировать инструмента при отсутствии традиционных».

Левин, ведущий исследователь роботизированного обучения, говорит, что был удивлен способностью робота импровизировать. В одном случае, например, робот решил, что бутылка с водой из-за ее формы и размера может использоваться для перемещения предметов по поверхности.

В одном случае, например, робот решил, что бутылка с водой из-за ее формы и размера может использоваться для перемещения предметов по поверхности.

«Когда вы показываете ему вещи, которые на самом деле не являются инструментами, он может придумать несколько неожиданные способы их использования», — говорит Левин.

Уилл Найт

Продолжайте читать

Самые популярные

Оставайтесь на связи

Иллюстрация Роуз Вонг

Узнайте о специальных предложениях, главных новостях, предстоящие события и многое другое.

Введите адрес электронной почты

Политика конфиденциальностиСпасибо за отправку вашего электронного письма!

Ознакомьтесь с другими информационными бюллетенямиПохоже, что-то пошло не так.

У нас возникли проблемы с сохранением ваших настроек.

Попробуйте обновить эту страницу и обновить их один раз

больше времени. Если вы продолжаете получать это сообщение,

свяжитесь с нами по адресу

customer-service@technologyreview.