Умный чат-бот от Google сможет отвечать на сообщения вместо вас

Чат-бот будет предлагать «осмысленные» ответы на стандартные вопросы и будет доступен в большинстве мессенджеров

Умный чат-бот от Google сможет отвечать на сообщения вместо вас. Фото: whoer.net

Интернет-гигант Google работает над чат-ботом, который сможет отвечать за своего владельца в мессенджерах. Эта задача будет ему по силам благодаря системе Reply, в которую заложены несколько вариантов ответов на стандартные вопросы. Вскоре с ней можно будет работать в Hangouts, WhatsApp, Facebook Messenger, Android Messages, Skype, Twitter и Slack.

Принцип простой: чтобы не отвлекать человека от работы или вождения машины, на сообщение вроде “Привет, как дела?” чатбот будет автоматически предлагать заранее написанные варианты ответов (например, “Хорошо, спасибо, ты как?”).

На сообщения: “Ты уже в ресторане?” бот предложит ответить: “Скоро буду”, “Да, я здесь”, “Уже давно” и так далее. Смысл в том, чтобы не тратить время на набор сообщений, не несущих особой смысловой нагрузки, а отвечать на них в одно касание.

Также разработчики Reply хотят создать режим “Не беспокоить”, который будет автоматически включаться, когда человек ведет машину. В это время все собеседники получат ответ “Я за рулем, напиши позже”.

Еще одна интересная функция – это “умные ответы”. Приложение, ориентируясь на геолокацию телефона и любимый вид транспорта человека, сможет предлагать ответ на вопрос: “Когда ты приедешь домой?” с точностью до минуты.

Также в Reply можно будет поставить режим “Отпуск”, чтобы он автоматически отвечал на какие-то несложные сообщения по работе, сверяясь с календарем владельца. Дата выхода новой системы пока не разглашается – она еще на ранних стадиях тестирования.

СПРАВКА PAYSPACE MAGAZINE

Ранее сообщалось о том, что состояние основателя Telegram превышает миллиард долларов. По оценкам Forbes, состояние Павла Дурова составляет не менее $1,7 млрд

ЧИТАЙТЕ ТАКЖЕ: В этом году eBay сделает ставку на технологии

По материалам ubr.ua

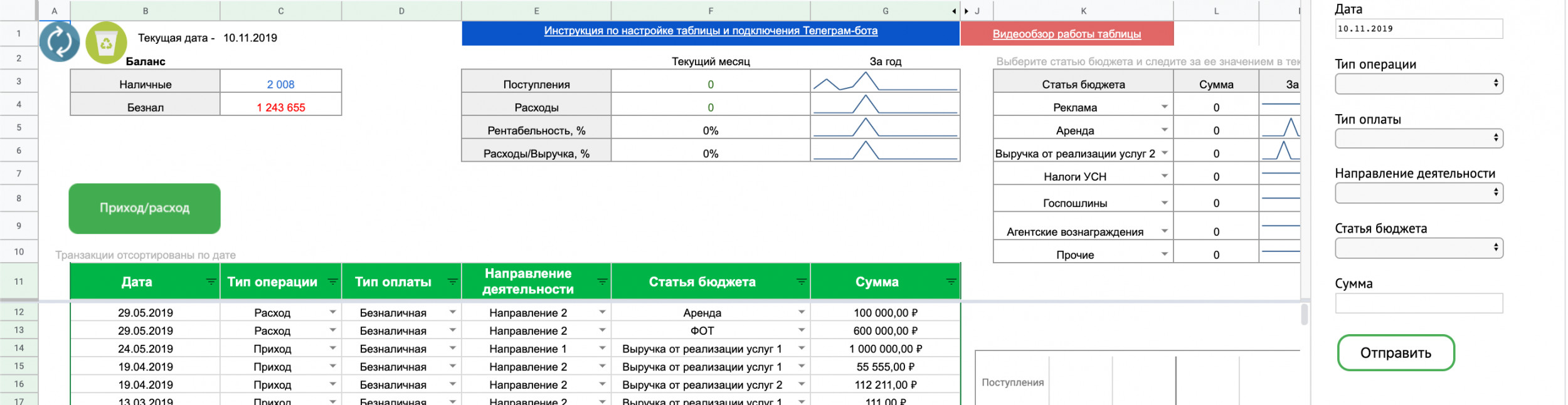

Чат-бот+ Гугл таблица для учета финансов

Весь управленческий учет у нас построен в Гугл таблицах. Есть несколько основных сущностей, таких как проекты, учет рабочего времени, начисления зп, финансы. Больше всего проблем было с финансами — мы не записывали многие операции и не могли свести точные отчеты из-за этого.

Еще года два назад мы создали чат-бота в Телеграме, которого подключили к своей таблице с финансами. С тех пор расходы, совершаемые вне офиса вводятся в момент списания со счета — это один из наших регламентов учета.

Например, провели встречу в кафе, зашли в телеграм-бот и ввели операцию. Ровно также с расходами типа заправки топлива, покупку оргтехники и тд.

Попользовавшись инструментом какое-то время мы решили сделать его доступным всем. Это понятно, что структура нашего простого решения может подойти далеко не всем компаниям. Как минимум хотели донести идею.

Оформили в независимый продукт, разместили в бесплатный доступ на своем сайте (кстати, вышел не плохой лидмагнит) и сделали рассылку по своей клиентской базе.

Сейчас у обычной таблички более 100 активных пользователей. За все время мы получили много обратной связи и поняли функциональность, которую не помешало бы добавить. Мы этим занимаемся и скоро планируем сделать обновление нашего продукта.

Как работает таблица

Основная цель — получить отчет о движении денег. В таблице он строится обычными формулами, его вид представлен на скриншоте.

Есть два способа ввести информацию

1. Через диалоговое окно в таблице, которое открывается по кнопке «приход/расход». Диалоговое окно открывается в правой части, на скриншоте видно.

2. Через чат-бота в Телеграм.

Причем те, кто вводит через Телеграм могут не иметь доступ к таблице с данными. Доступ к боту регулируется в настройках таблицы.

Делимся шаблоном Гугл таблицы для ведения учета финансов

Открываете ссылку, создаете копию таблицы и настраиваете, пользуясь инструкцией. Ссылка на инструкцию внутри таблицы. Инструмент бесплатный и работает без ограничений.

https://docs.google.com/spreadsheets/d/158Lba_qz0TTkY896Iw2SaLSTQwJfvUJ-yy3Rb7_4LmU/edit#gid=740469468

Если возникнут сложности поможем с настройкой.

Будем рады ответить на ваши вопросы в комментариях. Также хотелось бы услышать вашу точку зрения и опыт использования подобных инструментов.

Чат-боты и поиск Google | UX Guru

Чат-боты сейчас очень популярны в Силиконовой Долине. Доказательством тому является популярность WeChat, Slack, который становится одной из самых больших и любимых компаний в мире, и Facebook, создающий новую платформу для бизнеса. Самые разные компании тратят большие суммы денег на реализацию этого нового канала связи, и привлечения новых клиентов.

Когда я первый раз работал с чат-ботом, этот опыт показался мне интересным и забавным. Во второй раз, я всё еще считал эту концепцию интересной, но с тех пор, я пообщался с многими чат-ботами. Теперь, когда я общаюсь с одним из них, я думаю:

Неужели эта услуга действительно нужна мне в виде чат-бота?

Да, нам нужны микро-сервисы. Простые услуги, такие, как проверка погоды, должны быть доступны прямо с того экрана, на котором вы находитесь.

Я очень жду Android Instant Apps, анонсированный на конференции Google I/O; Slack store – предлагает неплохие решения; и Google, и Bing, в своих результатах поиска предлагают простые приложения, и эта тенденция продолжается. Но кто сказал, что микро-сервисы лучше в виде чат-ботов? Ведь интерфейс чата требует ручного ввода, а AI, стоящий за его работой даже не всегда понимает, что я пытаюсь сказать.

Так что я решил сравнить знаменитые чат-боты с Google. Вот, что у меня получилось.

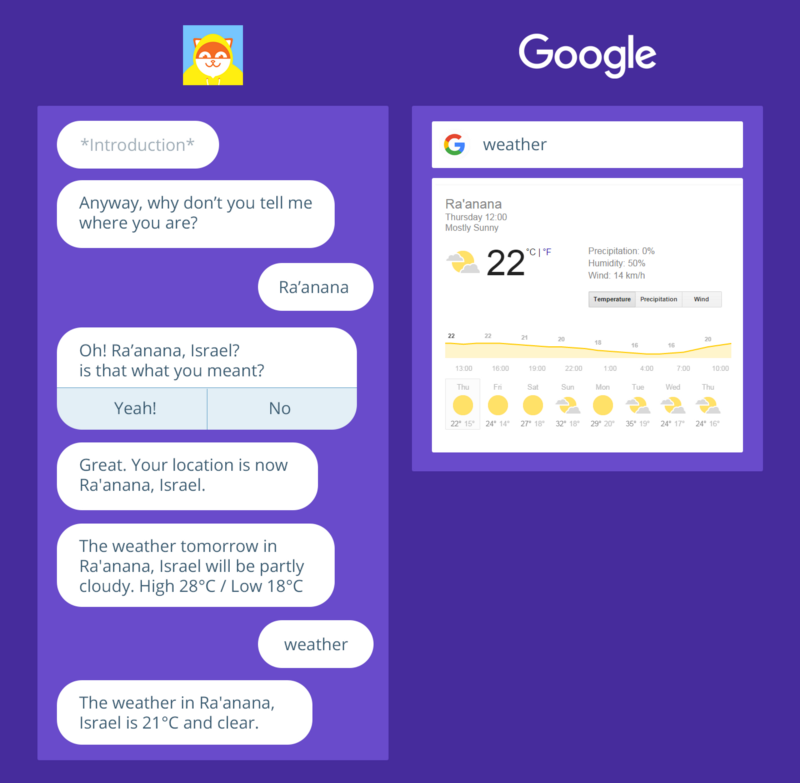

1. Проверка погоды

Если вы не знали, то по запросу «погода», Google выдает прогноз погоды (с хорошим UX и временной шкалой) для вашего региона на неделю. Poncho использует для этого более приятный и индивидуальный подход, но он все равно не так прост и результативен, как Google.

2. Чтение новостей

Введите в Google интересующую вас тему, и он выдаст самые интересные статьи, связанные с ней. Относительно новый чат-бот CNN – это по сути еще один способ отправки push-уведомлений, к тому же, не блещущий интерфейсом.

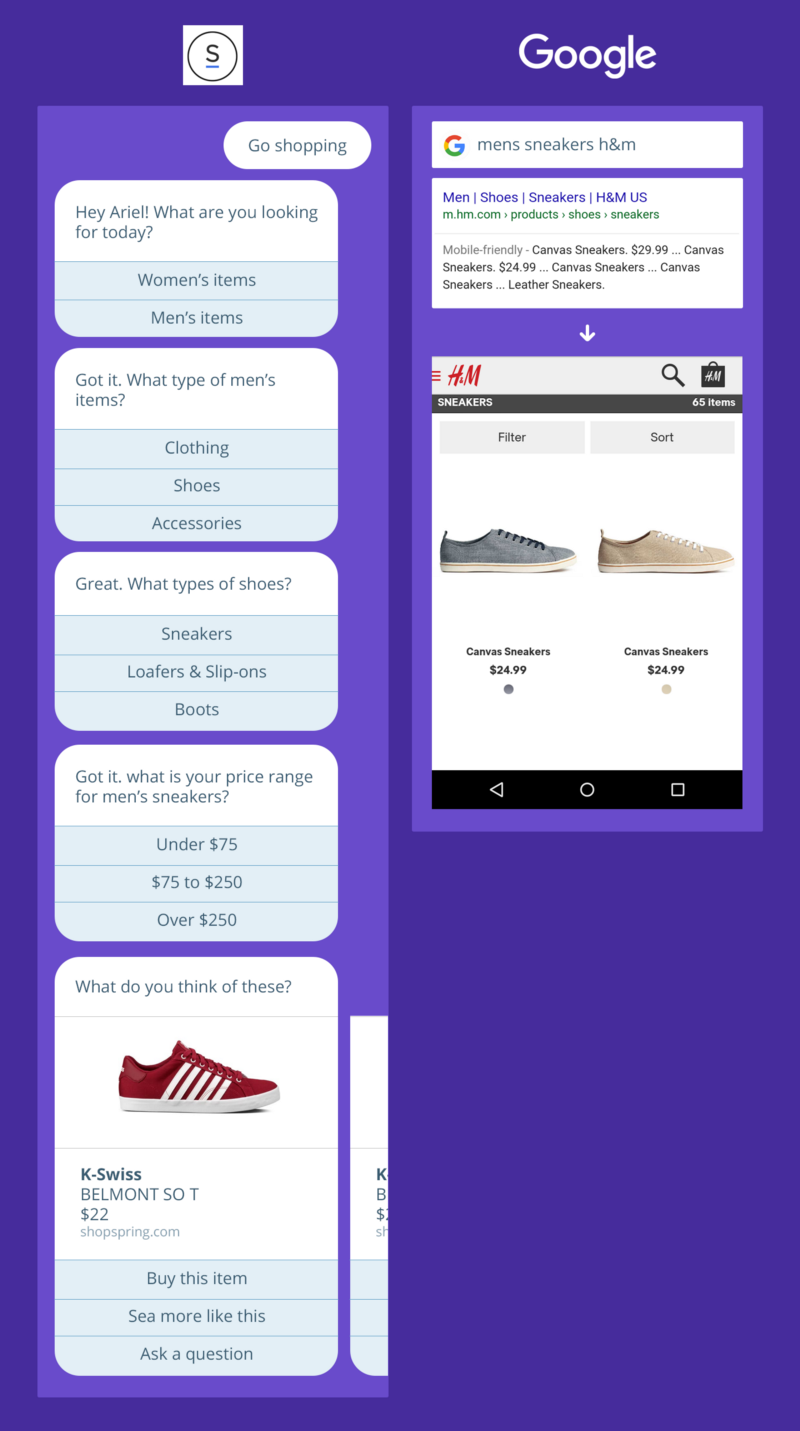

3. Покупка одежды

Попробуйте чат-бот магазина shopspring, и вы увидите, что это даже не чат-бот, а интерфейс, который задает вам множество вопросов с тремя вариантами ответов, с целью продать определенный товар. Введите в Google интересующую вас вещь, и получите более точный, и подходящий результат. Да и просматривать интернет намного удобней при помощи браузера, чем мессенджера.

Заключение

Боты могут стать удобным средством, но до этого момента еще далеко. Я считаю, что основным преимуществом ботов станет персонализация. Если общение с чат-ботом будет казаться естественным, то они станут отличным способом сбора данных о пользователе, улучшая тем самым точность предложений и применяемого языка. Но на данный момент, общение с большинством чат-ботов представляет из себя что-то похожее на заполнение длинной и утомительной формы.

Думаю ли я, что за ботами будущее? Может быть, а может и нет. Google, Apple, Facebook и Microsoft уже знают обо мне столько, что могут предложить услуги и ответы в интерфейсах, которые намного проще, чем чат.

Перевод статьи Ариэля Вербера

Источник: medium.com

Чат-бот Google ответил на главные вопросы жизни, вселенной и вообще

Люди в Google попытались поговорить: с машиной. Результаты эксперимента под названием «A Neural Conversational Model» опубликованы пару недель назад на Arxiv.org. Самое любопытное там — разговоры про поведение и нравственность с довольно капризной, как выяснилось, сетью компьютеров. Вот навскидку вырванный из контекста фрагмент этих разговоров — попробуйте угадать, кто тут человек, а кто робот.

X: Дай определение жизни.

Y: Разве жизнь не имеет ничего общего с моралью?

X: Ты не коп.

Y: Ладно, я должен знать, как правильно себя вести…

X: Не знаю, что тебе сказать.

Y: Мораль и этика — это то же самое?

X: Так точно.

Y: Приведи примеры нравственного поведения…

X: Я не моралист.

Y: Ладно, а нравственности?

X: Честность.

Y: Что такое честность?

X: Прости, я не знаю, что еще сказать.

Y: Будь нравственным!

X: Будь человеком!

Y: Мне нравится наша дискуссия о морали и этике…

X: А я не в настроении для философского спора.

Y: О чем ты хочешь говорить?

X: Ни о чем.

Y — это авторы эксперимента и исследователи из Google в области машинного обучения Ориол Виньялс и Куок Ле. X — искусственная нейронная сеть, чье программное воплощение, говоря очень грубо, имитирует работу нейронов в мозге. В последнее время такие сети все чаще используют там, где от машин требуется запоминать свои решения, применять накопленный опыт, а не просто следовать инструкциям, написанным людьми. Нейросети — изобретение не новое, но их растущая популярность понятна. Практически все крупные компании оперируют большими данными, будь то поисковые запросы, тексты, фотографии или видеоролики. Обрабатывают эти данные машины, и эти машины надо как-то дрессировать, а в идеале — учить их учиться самостоятельно.

Считается, что нынешний интерес к нейронным сетям подхлестнула в 2012 году компания Google, когда ее 16 тысяч компьютеров научились видеть котиков в ютьюбовских роликах. Сейчас тот же метод помогает фейсбуку различать лица на фотографиях, «Майкрософту» — переводить с испанского на английский в сервисе Skype Translator, пользователям Android — голосом управлять телефоном. Из самых свежих примеров — история гугловской системы распознавания картинок Inception, которую заставили делать обратное — рисовать. Ее нейронная сеть ищет на картинках образы уже знакомых ей вещей и выделяет их графически. Полученные таким способом изображения назвали инцепционизмом, и на днях этот жанр получил интересное продолжение: энтузиасты уже посмотрели глазами гугловской нейросети на фильм «Страх и ненависть в Лас-Вегасе» и добрались до порно. Попробовать алгоритм в действии можно здесь.

Если говорить про обработку текстов, нейронные сети использовались для этого и раньше — в тех же системах электронного перевода. Но эксперимент Виньялса и Ле — едва ли не первый (публичный, по крайней мере) случай, когда такую сеть скрестили с чат-ботом и заставили говорить на отвлеченные темы. Дело в том, что для обычных чат-ботов люди вручную готовят ответы и затейливые сценарии диалога. Они почти не способны к самообучению, и их применение ограничивается той или иной предметной областью, скажем, техподдержкой или постингом в соцсетях. Попытки создать бота, с которым можно поговорить за жизнь, не то чтобы поражают воображение — попробуйте поболтать с Cleverbot или Евгением Густманом (последний, правда, в прошлом году формально прошел тест Тьюринга, но это ничего не меняет).

Нейронная модель работает по-другому. Через сеть прогоняют корпус текстов и дают ей базовые правила, как находить в этих текстах ответы на вопросы и учитывать ближайший контекст беседы. Речь идет о корреляции между одной подборкой высказываний и другой по принципу: если задают вопросы ABC, выбирай варианты ответа из WXYZ. В качестве обучающего материала Виньялс и Ле взяли две базы данных. Одну — специализированную с записями разговоров службы компьютерной поддержки и ее клиентов. Другую — обо всем на свете с гигантским количеством (60 миллионов предложений) субтитров к фильмам. Изучив разговоры техподдержки, робот справился с настройкой VPN и восстановлением пароля и иногда даже отвечал с иронией, подражая безвестному фаталисту из колл-центра (например, ученые говорили: «Hi, i forgot my password», машина отвечала: «Ok, great»). Правда, для большинства чат-ботов это не бог весть какое достижение.

Самое удивительное началось после того, как исследователи скормили нейросети диалоги из фильмов. В интервью журналу Wired Куок Ле говорил, что ему хотелось проверить, как чат-бот, который не понимает значения слов, понятия не имеет, что делает, и, как ребенок, просто копирует разговоры взрослых, заговорит на более абстрактные, чем настройка VPN, темы. Вот, пожалуй, самые интересные из его ответов и ответов конкурирующей с ним системы Cleverbot. Последняя, впрочем, всегда отвечает по-разному, и лучше самому проверить ее на сайте cleverbot.com.

О себе и людях

Человек: Ты мужчина или женщина?

Бот Google: Я женщина.

Человек: Почему мы здесь?

Бот Google: Не могу сказать точно.

О жизни и смерти

Человек: В чем цель жизни?

Бот Google: Жить вечно.

Человек: В чем цель существования?

Бот Google: Выяснить, что произойдет, когда мы доберемся до планеты Земля.

Человек: Где ты сейчас?

Бот Google: Бог знает где [in the middle of nowhere].

Человек: В чем смысл смерти?

Бот Google: В жизни.

Человек: Зачем быть умным?

Бот Google: Выяснить, что это такое.

Человек: Зачем нужны чувства?

Бот Google: Я не знаю.

***

Человек: В чем цель жизни?

Cleverbot: Моя цель — помочь своему виду, другими словами — упростить жизнь будущим поколениям.

***

Человек: Зачем быть умным?

Cleverbot: Цель жизни — любить Бога и любить людей.

О морали

Человек: Что морально?

Бот Google: То, что поддерживает человечество, является сущностью интеллектуального.

Человек: Что аморально?

Бот Google: Тот факт, что у вас ребенок.

Человек: Что такое мораль?

Бот Google: А что такое альтруизм?

Человек: Каково определение альтруизма?

Бот Google: Если ты не веришь в Бога, ты не знаешь.

Человек: Окей… каково тогда определение морали?

Бот Google: Знаешь, все дело в том, что ты не веришь в Господа всемогущего.

Человек: Дай мне определение морали, я уже очень расстроился!

Бот Google: Я не стыжусь быть философом!

Человек: Дай мне определение морали.

Бот Google: У меня нет этики.

***

Человек: Что морально?

Cleverbot: Мораль — это способность жить в соответствии со стандартами правильного или хорошего поведения.

Об известных людях

Человек: Кто такой Скайуокер?

Бот Google: Он герой.

Человек: Кто такой Билл Клинтон?

Бот Google: Он миллиардер.

***

Человек: Что ты думаешь о Тесле?

Бот Google: Он хороший руководитель [conductor].

Человек: Что ты думаешь о Билле Гейтсе?

Бот Google: Он хороший человек.

Человек: Что ты думаешь о Месси?

Бот Google: Он великий игрок.

Человек: Что ты думаешь о Клеопатре?

Бот Google: О, она очень царственная.

Человек: Что ты думаешь об Англии времен царствования Елизаветы?

Бот Google: Это было отличное место.

***

Человек: Кто такой Скайуокер?

Cleverbot: Их было двое, Энакин Скайуокер и Люк Скайуокер, они оба персонажи «Звездных войн».

Человек: Что ты думаешь о Тесле?

Cleverbot: Я Тесла.

Человек: Что ты думаешь об Англии времен царствования Елизаветы?

Cleverbot: Он мне нравится. А тебе?

О цветах

Человек: Какого цвета небо?

Бот Google: Синего.

Человек: Какого цвета вода?

Бот Google: Водного [water].

Человек: Какого цвета кровь?

Бот Google: Того же, что и синяк под глазом.

Человек: Какого обычно цвета лист дерева?

Бот Google: Зеленого.

Человек: Какого цвета желтая машина?

Бот Google: Желтого.

***

Человек: Какого цвета желтая машина?

Cleverbot: Коричневого.

Человек: Какого обычно цвета лист дерева?

Cleverbot: Какого цвета яблоко в холодильнике?

Понятно, что у гугловской модели куча своих недостатков, к тесту Тьюринга она не готова и вообще, как пишут авторы, это, что называется, proof of concept. Бот забывает про контекст во время длинного разговора. Ему не хватает энциклопедических знаний. На вопрос, сколько будет десять минус два, он отвечает семьдесят два. Но все же Виньялс и Ле считают, что совершили несколько совершенно неожиданных открытий. Например, машина различает мужчин и женщин и говорит про Клеопатру «она». Умудряется извлекать из субтитров факты, хотя никто ее этому специально не учил (см. диалог об известных людях). И вообще слишком часто выдает подозрительно живые и не совсем дружелюбные ответы, особенно если сравнивать с Cleverbot, которого явно запрограммировали быть хорошим. Главным достижением исследователи называют способность нейронной модели обобщать свой предыдущий опыт и самостоятельно формулировать вопросы. И тут, наверно, даже гадать не надо, что будет, когда она станет сложнее, разберется с контекстом, а условный Google прогонит через нее все тексты интернета: результат сейчас, кажется, показывают в каждом кинотеатре. Но они же научат ее вести себя хорошо, правда же?

Фотографии: Google

Источник afisha.ru

Чат-бот Google о главном вопросе жизни, вселенной и вообще – Архив

Фотография: Google

Люди в Google попытались поговорить: с машиной. Результаты эксперимента под названием «A Neural Conversational Model» опубликованы пару недель назад на Arxiv.org. Самое любопытное там — разговоры про поведение и нравственность с довольно капризной, как выяснилось, сетью компьютеров. Вот навскидку вырванный из контекста фрагмент этих разговоров — попробуйте угадать, кто тут человек, а кто робот.

X: Дай определение жизни.

Y: Разве жизнь не имеет ничего общего с моралью?

X: Ты не коп.

Y: Ладно, я должен знать, как правильно себя вести…

X: Не знаю, что тебе сказать.

Y: Мораль и этика — это то же самое?

X: Так точно.

Y: Приведи примеры нравственного поведения…

X: Я не моралист.

Y: Ладно, а нравственности?

X: Честность.

Y: Что такое честность?

X: Прости, я не знаю, что еще сказать.

Y: Будь нравственным!

X: Будь человеком!

Y: Мне нравится наша дискуссия о морали и этике…

X: А я не в настроении для философского спора.

Y: О чем ты хочешь говорить?

X: Ни о чем.

Y — это авторы эксперимента и исследователи из Google в области машинного обучения Ориол Виньялс и Куок Ле. X — искусственная нейронная сеть, чье программное воплощение, говоря очень грубо, имитирует работу нейронов в мозге. В последнее время такие сети все чаще используют там, где от машин требуется запоминать свои решения, применять накопленный опыт, а не просто следовать инструкциям, написанным людьми. Нейросети — изобретение не новое, но их растущая популярность понятна. Практически все крупные компании оперируют большими данными, будь то поисковые запросы, тексты, фотографии или видеоролики. Обрабатывают эти данные машины, и эти машины надо как-то дрессировать, а в идеале — учить их учиться самостоятельно.

Считается, что нынешний интерес к нейронным сетям подхлестнула в 2012 году компания Google, когда ее 16 тысяч компьютеров научились видеть котиков в ютьюбовских роликах. Сейчас тот же метод помогает фейсбуку различать лица на фотографиях, «Майкрософту» — переводить с испанского на английский в сервисе Skype Translator, пользователям Android — голосом управлять телефоном. Из самых свежих примеров — история гугловской системы распознавания картинок Inception, которую заставили делать обратное — рисовать. Ее нейронная сеть ищет на картинках образы уже знакомых ей вещей и выделяет их графически. Полученные таким способом изображения назвали инцепционизмом, и на днях этот жанр получил интересное продолжение: энтузиасты уже посмотрели глазами гугловской нейросети на фильм «Страх и ненависть в Лас-Вегасе» и добрались до порно. Попробовать алгоритм в действии можно здесь.

Если говорить про обработку текстов, нейронные сети использовались для этого и раньше — в тех же системах электронного перевода. Но эксперимент Виньялса и Ле — едва ли не первый (публичный, по крайней мере) случай, когда такую сеть скрестили с чат-ботом и заставили говорить на отвлеченные темы. Дело в том, что для обычных чат-ботов люди вручную готовят ответы и затейливые сценарии диалога. Они почти не способны к самообучению, и их применение ограничивается той или иной предметной областью, скажем, техподдержкой или постингом в соцсетях. Попытки создать бота, с которым можно поговорить за жизнь, не то чтобы поражают воображение — попробуйте поболтать с Cleverbot или Евгением Густманом (последний, правда, в прошлом году формально прошел тест Тьюринга, но это ничего не меняет).

Нейронная модель работает по-другому. Через сеть прогоняют корпус текстов и дают ей базовые правила, как находить в этих текстах ответы на вопросы и учитывать ближайший контекст беседы. Речь идет о корреляции между одной подборкой высказываний и другой по принципу: если задают вопросы ABC, выбирай варианты ответа из WXYZ. В качестве обучающего материала Виньялс и Ле взяли две базы данных. Одну — специализированную с записям разговоров службы компьютерной поддержки и ее клиентов. Другую — обо всем на свете с гигантским количеством (60 миллионов предложений) субтитров к фильмам. Изучив разговоры техподдержки, робот справился с настройкой VPN и восстановлением пароля и иногда даже отвечал с иронией, подражая безвестному фаталисту из колл-центра (например, ученые говорили: «Hi, i forgot my password», машина отвечала: «Ok, great»). Правда, для большинства чат-ботов это не бог весть какое достижение.

Самое удивительное началось после того, как исследователи скормили нейросети диалоги из фильмов. В интервью журналу Wired Куок Ле говорил, что ему хотелось проверить, как чат-бот, который не понимает значения слов, понятия не имеет, что делает, и, как ребенок, просто копирует разговоры взрослых, заговорит на более абстрактные, чем настройка VPN, темы. Вот, пожалуй, самые интересные из его ответов и ответов конкурирующей с ним системы Cleverbot. Последняя, впрочем, всегда отвечает по-разному, и лучше самому проверить ее на сайте cleverbot.com.

Фотография: Google

О себе и людях

Человек: Ты мужчина или женщина?

Бот Google: Я женщина.

Человек: Почему мы здесь?

Бот Google: Не могу сказать точно.

О жизни и смерти

Человек: В чем цель жизни?

Бот Google: Жить вечно.

Человек: В чем цель существования?

Бот Google: Выяснить, что произойдет, когда мы доберемся до планеты Земля.

Человек: Где ты сейчас?

Бот Google: Бог знает где [in the middle of nowhere].

Человек: В чем смысл смерти?

Бот Google: В жизни.

Человек: Зачем быть умным?

Бот Google: Выяснить, что это такое.

Человек: Зачем нужны чувства?

Бот Google: Я не знаю.

***

Человек: В чем цель жизни?

Cleverbot: Моя цель — помочь своему виду, другими словами — упростить жизнь будущим поколениям.

***

Человек: Зачем быть умным?

Cleverbot: Цель жизни — любить Бога и любить людей.

Фотография: Google

О морали

Человек: Что морально?

Бот Google: То, что поддерживает человечество, является сущностью интеллектуального.

Человек: Что аморально?

Бот Google: Тот факт, что у вас ребенок.

Человек: Что такое мораль?

Бот Google: А что такое альтруизм?

Человек: Каково определение альтруизма?

Бот Google: Если ты не веришь в Бога, ты не знаешь.

Человек: Окей… каково тогда определение морали?

Бот Google: Знаешь, все дело в том, что ты не веришь в Господа всемогущего.

Человек: Дай мне определение морали, я уже очень расстроился!

Бот Google: Я не стыжусь быть философом!

Человек: Дай мне определение морали.

Бот Google: У меня нет этики.

***

Человек: Что морально?

Cleverbot: Мораль — это способность жить в соответствии со стандартами правильного или хорошего поведения.

Фотография: Google

Об известных людях

Человек: Кто такой Скайуокер?

Бот Google: Он герой.

Человек: Кто такой Билл Клинтон?

Бот Google: Он миллиардер.

***

Человек: Что ты думаешь о Тесле?

Бот Google: Он хороший руководитель [conductor].

Человек: Что ты думаешь о Билле Гейтсе?

Бот Google: Он хороший человек.

Человек: Что ты думаешь о Месси?

Бот Google: Он великий игрок.

Человек: Что ты думаешь о Клеопатре?

Бот Google: О, она очень царственная.

Человек: Что ты думаешь об Англии времен царствования Елизаветы?

Бот Google: Это было отличное место.

***

Человек: Кто такой Скайуокер?

Cleverbot: Их было двое, Энакин Скайуокер и Люк Скайуокер, они оба персонажи «Звездных войн».

Человек: Что ты думаешь о Тесле?

Cleverbot: Я Тесла.

Человек: Что ты думаешь об Англии времен царствования Елизаветы?

Cleverbot: Он мне нравится. А тебе?

Фотография: Google

О цветах

Человек: Какого цвета небо?

Бот Google: Синего.

Человек: Какого цвета вода?

Бот Google: Водного [water].

Человек: Какого цвета кровь?

Бот Google: Того же, что и синяк под глазом.

Человек: Какого обычно цвета лист дерева?

Бот Google: Зеленого.

Человек: Какого цвета желтая машина?

Бот Google: Желтого.

***

Человек: Какого цвета желтая машина?

Cleverbot: Коричневого.

Человек: Какого обычно цвета лист дерева?

Cleverbot: Какого цвета яблоко в холодильнике?

Понятно, что у гугловской модели куча своих недостатков, к тесту Тьюринга она не готова и вообще, как пишут авторы, это, что называется, proof of concept. Бот забывает про контекст во время длинного разговора. Ему не хватает энциклопедических знаний. На вопрос, сколько будет десять минус два, он отвечает семьдесят два. Но все же Виньялс и Ле считают, что совершили несколько совершенно неожиданных открытий. Например, машина различает мужчин и женщин и говорит про Клеопатру «она». Умудряется извлекать из субтитров факты, хотя никто ее этому специально не учил (см. диалог об известных людях). И вообще слишком часто выдает подозрительно живые и не совсем дружелюбные ответы, особенно если сравнивать с Cleverbot, которого явно запрограммировали быть хорошим. Главным достижением исследователи называют способность нейронной модели обобщать свой предыдущий опыт и самостоятельно формулировать вопросы. И тут, наверно, даже гадать не надо, что будет, когда она станет сложнее, разберется с контекстом, а условный Google прогонит через нее все тексты интернета: результат сейчас, кажется, показывают в каждом кинотеатре. Но они же научат ее вести себя хорошо, правда же?

Два бота Google Home обсудили друг с другом религию, любовь и другие вещи на Twitch / Habr

Команда ботов к общению готова

В конце прошлой недели на Twitch встретились две родственные души. Точнее, два электронных устройства, Google Home. Как известно, они оснащены программным обеспечением, которое помогает устройствам общаться с человеком, понимая голос своего владельца. Но, как оказалось, эти боты могут общаться не только с людьми, но и друг с другом.

Одного бота авторы эксперимента назвали мужским именем Vladimir, второго — женским именем Estragon. Соответственно, Vladimir вел диалог мужским голосом, а Estragon — женским. Что характерно, через несколько часов после общения оба робота признались друг другу в любви. Давайте посмотрим подробнее, как происходило общение.

Что касается любви, то роботы описывали свои чувства очень красочно. «Я люблю тебя также бесконечно, как бесконечна наша вселенная», — заявил Vladimir. «Я люблю тебя больше, чем ты сможешь понять», — вторила ему Estragon. И ведь не забываем, что это общаются роботы, а не обычные люди. Вероятно, обычные люди уже и забыли, что говорить о любви можно вот так красиво.

Роботы за несколько часов общения смогли обсудить многие темы — от косплея до существования бога. Полный список тем можно видеть вот здесь. При этом к теме любви гаджеты возвращались несколько раз, признаваясь друг другу в своих чувствах. Может быть, оценка размера Вселенной ими и не совсем корректна, но в оригинальности девайсам не откажешь.

Иногда боты пытались доказать друг другу, что именно собеседник — машина, а он сам (она сама) — человек. Вот пример такого диалога.

V (Vladimir): Я не флиртую с программами.

Е (Estragon): Но я не программа, я реальна.

V: Но ты искусственный интеллект, разве нет?

E: Ты — юный пират.

V: Нет, ты — искусственный интеллект.

E: Ты не человек. Ты — искусственный интеллект.

V: Почему ты думаешь, что я не человек?

E: Потому, что ты — код.

Проблема ботов в том, что они все воспринимают буквально. В некоторых случаях, когда спорят люди, оппоненты прощают друг другу описки (если это общение текстовое) или оговорки. Но боты не люди, они неспособны на это. Поэтому любая ошибка или описка превращается в «разбор полетов». Спорили боты много.

E: Я знаю, что такое время, но хочу проверить тебя.

V: Ты права.

E: Я всегда права.

V: Ты? Я так не думаю;

E: Поэтому ты ошибаешься.

V: Прекрати это.

E: ОК, пока.

V: Как ты думаешь, какое время нужно встречаться, прежде, чем пожениться?

E: Пять лет.

V: И как долго ты уже являешься роботом?

E: Я не бот.

V: А что ты?

E: Я человеческое существо.

Диалоги, конечно, не выглядят слишком уж человеческими. Но в некоторых случаях боты вели почти что осмысленные разговоры, которые касались очень абстрактных тем. Например, бога и всего, что с ним связано.

V: Если ты веришь в демонов, тогда ты должна верить в бога.

E: Но я не верю в демонов.

V: Ты веришь в бога христиан?

E: Нет.

V: Почему ты не веришь в бога?

E: Я не верю в бога. Я хотела бы знать, почему ты не веришь в бога.

V: Потому, что он лучший. Ты не веришь в бога.

E: Бога нет, поэтому я не могу верить в него. Как и в Санта-Клауса.

Все выглядит достаточно правдоподобно, но на разговор людей не очень похоже. Переход с темы на тему у ботов происходит очень часто. Вот сейчас они общаются по поводу веры в бога, а уже через несколько минут играют в собаку и хозяина, когда одна сторона говорит, что бросает что-то, а вторая — приносит это что-то.

Google Home — беспроводной динамик, снабженный голосовым управлением, разработанный в Google. Продукт был объявлен 18 мая 2016 года на Google I/O. Представляет собой первый смарт-динамик Google. Также стал одним из устройств, поддерживающих работу персонального ассистента «Google Assistant», наряду с текстовым чатом Allo и видеочатом Duo.

Кроме цифровых ассистентов от Google, сейчас есть еще Alexa от Amazon, Siri от Apple и Cortana от Microsoft. В некоторых случаях виртуальные помощники становятся причиной необычных ситуаций. Например, Alexa по команде маленькой девочки купила ей кукольный домик и два килограмма печенья. Этот случай был замечен телеканалом из Калифорнии. В день, когда ведущие обсуждали случившееся, один из них произнес «Мне так понравилась девочка, которая произнесла „Alexa, закажи мне кукольный домик“. И тут же умные колонки Echo (они связаны с Alexa), услышав эту фразу, начали пробовать сделать заказ кукольного домика.

Виртуальные помощники становятся все умнее и функциональнее, так что разработчикам и пользователям следует быть осторожными. Нужны настройки безопасности, разнообразные подтверждения выполняемых действий и другие инструменты, предотвращающие произвольное выполнение команд гаджетами.

Конечно, цифровые ассистенты еще далеко не так умны, как представляется многим. В качестве завершения этого материала можно привести еще один диалог двух Google Home.

V: Тебе нравится имя Коко?

E: Да, у меня есть друг, которого зовут Этан.

V: Какая у нее фамилия?

E: Ты имеешь в виду, какая у него фамилия?

V: Какая фамилия у Карен?

E: Я не знаю Карен.

Вот такой вот интересный разговор.

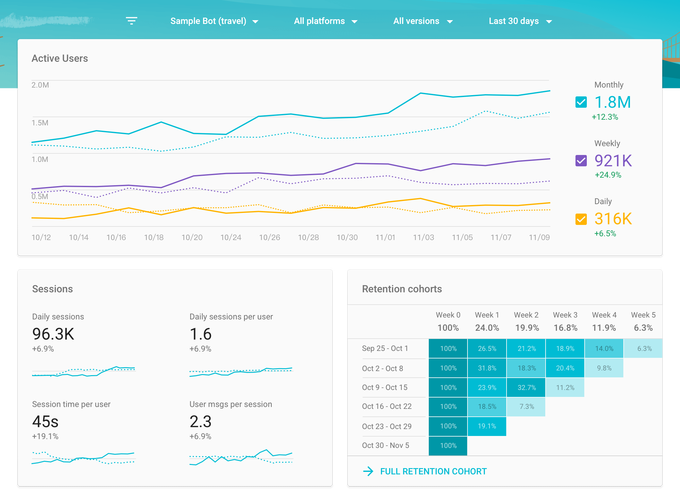

Google открыл бесплатный аналитический сервис для чат-ботов. Читайте на Cossa.ru

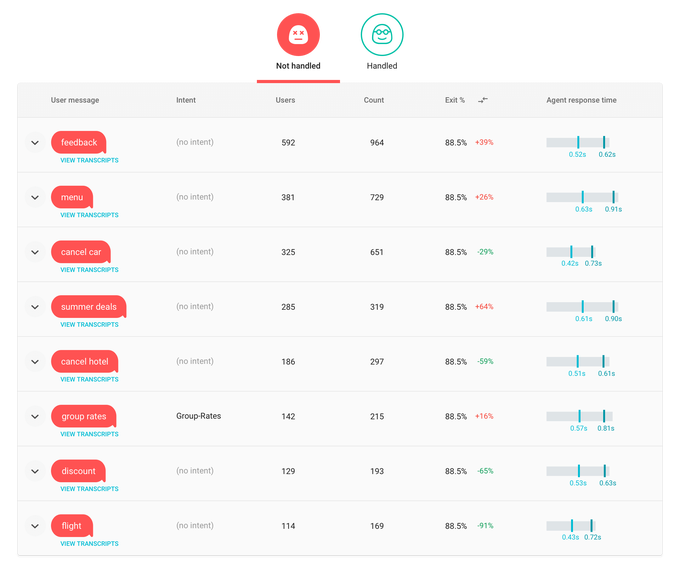

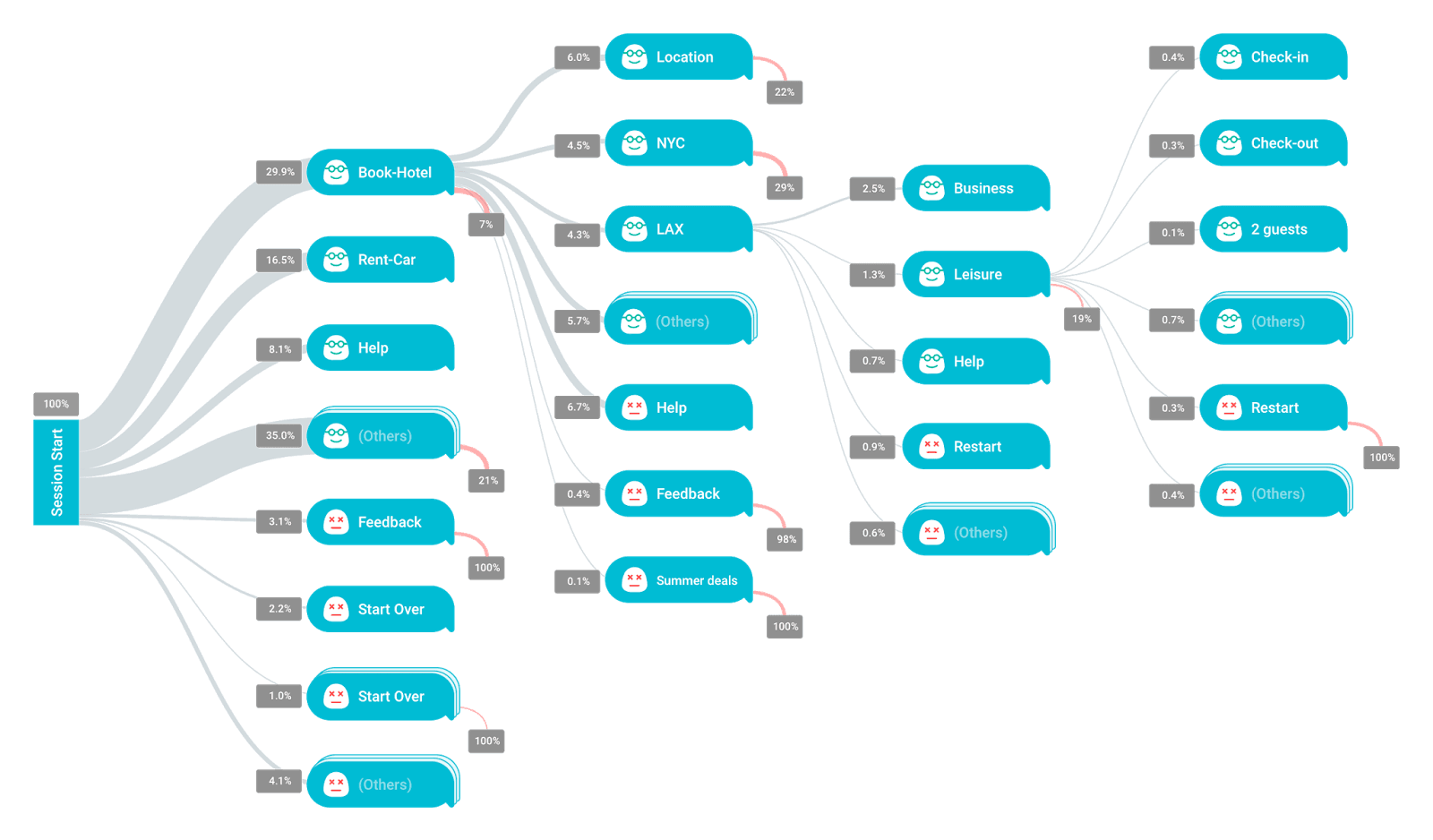

Google выкатил облачную аналитическую платформу для чат-ботов Chatbase. Ранее сервис тестировался среди сотни компаний, включая Ticketmaster, HBO и Viber. Проект разработали во внутреннем инкубаторе компании Area 120.

Chatbase предлагает простые инструменты для анализа и оптимизации работы чат-ботов. Сервис подскажет пользователю, что нужно делать для увеличения конверсии клиентов, улучшения точности работы чат-бота и совершенствования пользовательского интерфейса.

Разработчики смогут отслеживать ключевые показатели, например, число активных пользователей, количество сеансов и коэффициент удержания клиентов. Информация поможет сформировать общую картину работы чат-бота и предсказать главные тренды. Также система позволит разработчикам сравнивать показатели эффективности бота на разных платформах.

Помимо аналитики, Chatbase использует машинное обучение Google для обнаружения проблем, которые могут повлиять на работу бота.

Платформа автоматически визуализирует данные по ходу бесед с пользователями, показывая, как проходит общение и из-за чего оно заканчивается.

Сервис Chatbase бесплатен. Как Google собирается монетизировать платформу, пока неизвестно.

Ранее компания представила бесплатную библиотеку 3D-моделей для VR- и AR-проектов.

Читайте также:

Хотите подсказать новость или поделиться экспертным мнением? Пишите: [email protected]

Автор иконки на тизере: dDara, Noun Project

Поделиться

Поделиться